【2026年版】ローカル生成AIの始め方|PCスペック判定表とおすすめソフト徹底解説

社内データの取り扱いに不安を感じ、生成AIの業務利用を躊躇していませんか?この記事を読み終える頃には、あなたのPC内にあなた専用の「AIアシスタント」が構築され、外部へのデータ流出リスクを気にせず業務効率化を始められる状態になります。本記事では、PCスペックの確認から推奨ツールの導入まで、専門知識ゼロでも最短で環境を整える方法を解説します。

目次

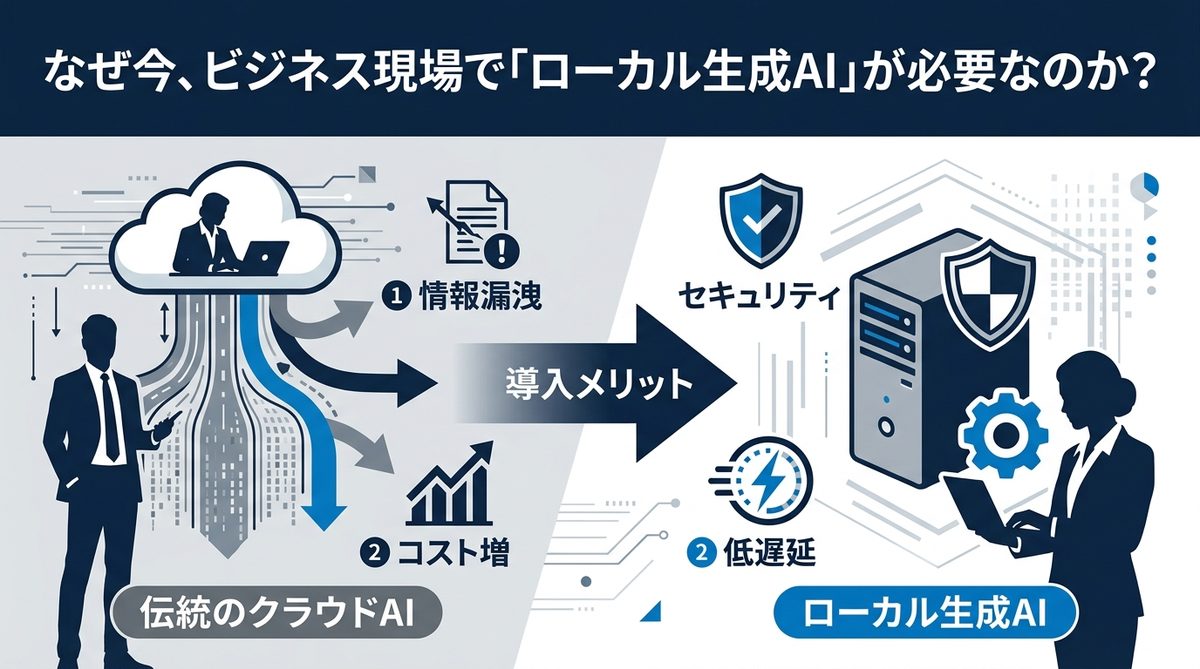

なぜ今、ビジネス現場で「ローカル生成AI」が必要なのか?

AIを自社PCで動かす(ローカル環境で実行する)ことで、クラウド型AIにはないビジネス上の強みが手に入ります。

クラウド型AIと比較した3つのメリット

- セキュリティ(情報漏洩対策): AIへの入力データがインターネット上に送信されないため、機密情報や社内規定を安心して読み込ませられます。

- コスト(月額固定費ゼロ): 一度PCを用意すれば、どれだけ回答を生成してもサブスクリプション料金は発生しません。

- カスタマイズ性: 自社の業界特有の用語や社内ルールを学習させる(RAG:検索拡張生成)環境を自由に構築できます。

PCの中に「優秀な個人アシスタント」が住み着く感覚とは

ローカルAIを導入することは、例えるなら「インターネットに繋がっていない閉ざされた書斎に、非常に博識な秘書を雇う」ような状態です。外部への漏洩を気にせず、膨大な社内資料を即座に要約させたり、複雑なメール文面を推敲させたりと、PCを開けばいつでも即座に応答してくれる頼もしい相棒が手に入ります。

関連記事:【2026年版・診断チャート付】目的別AIエージェントおすすめ10選|課題解決のための選び方と導入ステップを完全網羅

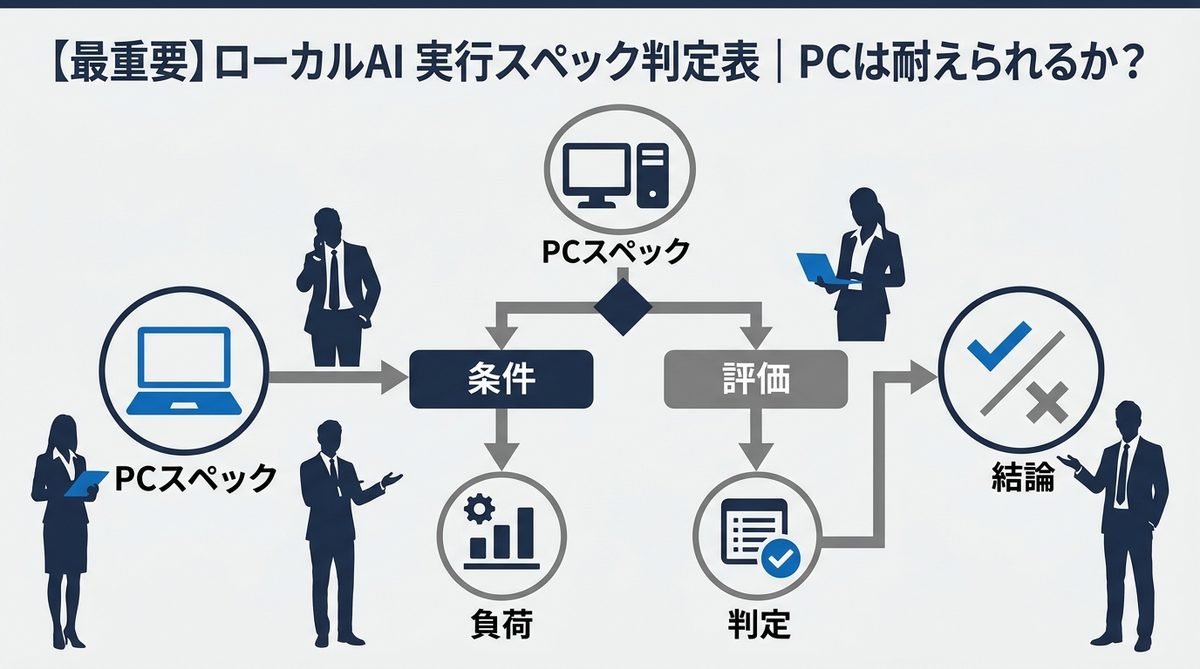

【最重要】ローカルAI 実行スペック判定表|PCは耐えられるか?

AIをローカルで動かす際、最も重要なパーツは「VRAM(ビデオメモリ)」です。これが不足するとAIの動作が極端に遅くなり、実用性を損ないます。

VRAMがローカルAIの「脳の広さ」を決める理由

VRAMとは、AIが思考(推論)を行うための「作業机の広さ」です。机が狭すぎると、AIは情報を小分けにして処理しなければならず、極端に動作が遅くなります。AIモデルの規模に応じた、十分な広さの机を用意することが成功の鍵です。

【目的別】モデル規模と推奨PCスペック早見表

| モデル規模 | VRAM(ビデオメモリ)推奨 | 主な用途 |

|---|---|---|

| 7B(軽量) | 8GB以上 | メール作成、要約、翻訳 |

| 14B(中規模) | 12GB以上 | 論理的思考、複雑なプログラミング |

| 70B(大規模) | 24GB以上 | 高度な分析、長文作成 |

Mac(M2/M3チップ)ユーザー必見!統合メモリの活用術

Appleシリコン(M2/M3/M4チップ)を搭載したMacでは、メインメモリがGPUメモリを兼ねる「統合メモリ」という仕組みを採用しています。例えばメモリ32GBのMacであれば、システム領域を除いた大部分をAIの推論に割り当てられるため、Windowsのビデオカードと同等以上の快適な環境を比較的安価に構築できます。

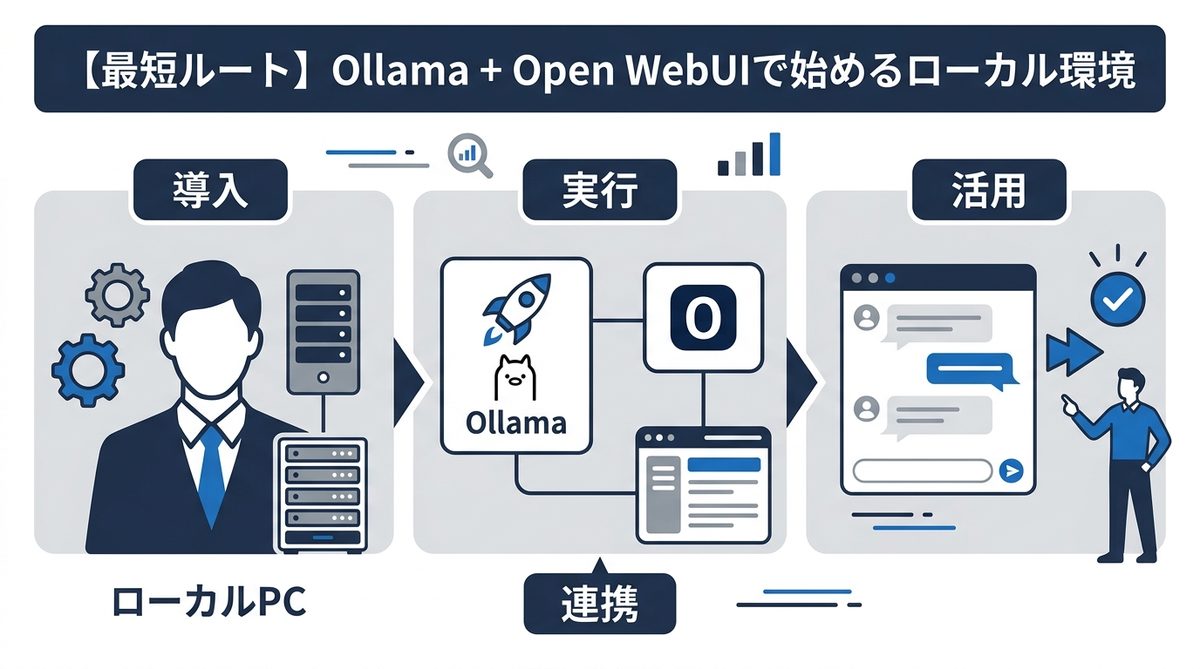

【最短ルート】Ollama + Open WebUIで始めるローカル環境

現在、最も導入が簡単で、かつChatGPTのような操作感を実現できる「Ollama + Open WebUI」の組み合わせがデファクトスタンダード(事実上の標準)です。

なぜ「Ollama + Open WebUI」が選ばれるのか

OllamaはAIモデルを管理・実行するための基盤であり、Open WebUIはそれを「ChatGPTのような画面」で使えるようにするフロントエンド(操作画面)です。コマンドを打ち込む必要はなく、ブラウザ上で直感的にAIと対話できます。

画像でわかる!インストールから最初の回答までの3ステップ

- Ollama公式サイトからインストール: OSに合わせてインストーラーをダウンロードし、クリックして完了させます。

- Open WebUIの導入: Docker(仮想環境構築ソフト)経由で、一行のコマンドを貼り付けるだけで起動します。

- モデルを選択: 管理画面から「Qwen2.5」や「Llama 3.2」などをクリックすれば、すぐにチャットを開始できます。

日本語モデル(Qwen2.5等)の選び方と導入設定

最新のQwen2.5シリーズは日本語能力が極めて高く、ビジネスメールの作成や報告書の整理にも十分耐えうる性能を持っています。設定画面で「qwen2.5」と入力するだけで、高品質な日本語での回答が得られます。

【目的別】ローカルAIのおすすめツール比較|どれを選ぶべき?

自身のスキルと目的に合わせて、最適なツールを選択しましょう。

操作性と管理重視の「LM Studio」

設定メニューがすべてマウス操作で完結します。「どのモデルが自分のPCで動くか」を自動判定してくれる機能があるため、初めての方には最も安心な選択肢です。

開発・実験重視の「Oobabooga」

詳細なパラメータ調整や、特定のAIアーキテクチャの実験を行いたいエンジニア向けです。拡張機能が豊富で、AIの回答プロセスを細かく制御したい場合に適しています。

【比較表】スキルレベル別の推奨ツール

| ツール名 | おすすめ対象 | 特徴 |

|---|---|---|

| Ollama+Open WebUI | 全ビジネスパーソン | 最もバランスが良く、ChatGPTのような使用感 |

| LM Studio | 初心者 | GUI操作で完結。モデル管理が圧倒的に楽 |

| Oobabooga | 上級者・エンジニア | 高度な設定と実験が可能 |

関連記事:【2026年版】AIエージェント比較表付き!おすすめツールと選び方を徹底解説

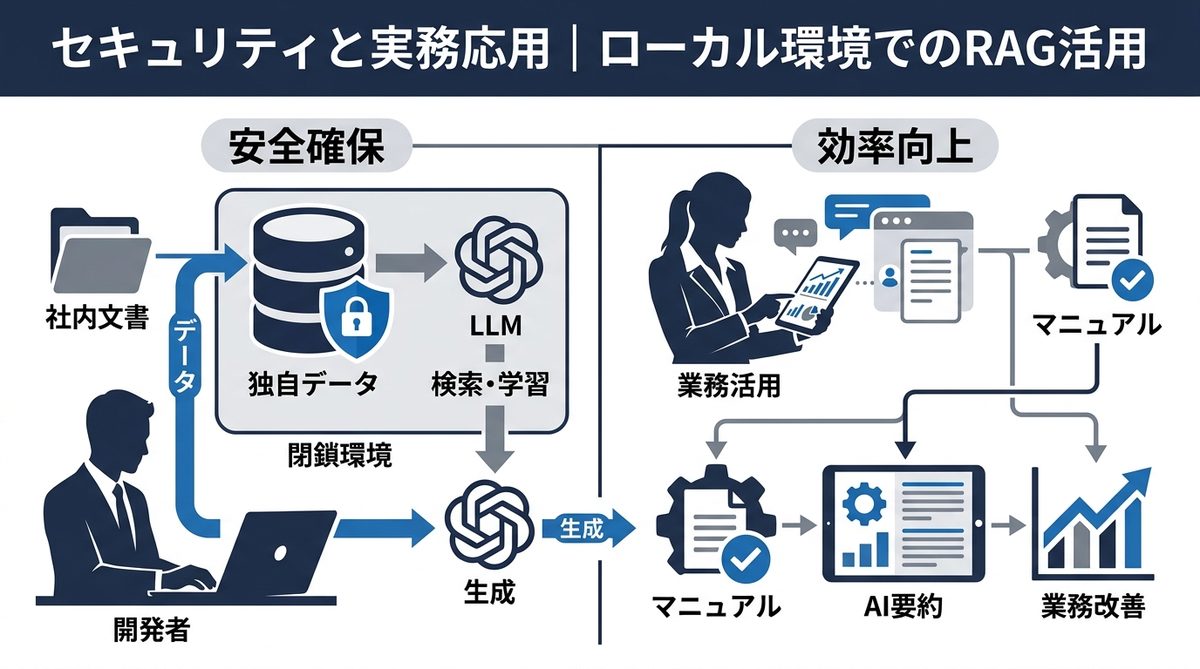

セキュリティと実務応用|ローカル環境でのRAG活用

ローカルAIの最大の武器は、社内データを読み込ませることです。

社内文書を読み込ませる「RAG(検索拡張生成)」の仕組み

RAGとは、AIに対して「回答の根拠となる参考書(自社ドキュメント)」を与える技術です。AIが知識として持っていない社内規定や過去のプロジェクト資料を、AIがその場で読み込んで回答するため、誤情報の発生(ハルシネーション)を大幅に抑えられます。

情報流出リスクゼロ!ローカルRAGの活用シーン

- 社内規定検索: 「この場合の休暇申請の手順は?」と聞けば、規定PDFを参照して即答。

- 議事録の要約: 数十件の会議録を読み込ませ、「直近のタスクをリスト化して」と指示。

- 契約書のチェック: 自社のフォーマットに基づき、相手方契約書の条項漏れを警告。

関連記事:【2026年最新】生成AI料金比較!目的別おすすめツールとROIを最大化する選び方

ローカル実行の注意点と次の一歩

AIを稼働させると、PCのファンが勢いよく回り、熱を持つことがありますが、これはPCが全力で計算を行っている証拠です。長時間稼働させる場合は、ノートPCであれば冷却台を使うなどの工夫が寿命を延ばすコツです。また、今後はローカル環境で動画生成モデルを動かすなど、テキスト以外のマルチモーダル(複数の情報の型を扱える)への拡張も楽しみの一つです。

まとめ

ローカル生成AIの構築は、適切なスペック確認とツール選択を行えば、誰でもその日のうちに実現可能です。

- スペック確認: VRAMがAIの作業領域となる。最低8GB、快適性を求めるなら12GB以上が目安。

- ツール選択: 初心者は「Ollama + Open WebUI」か「LM Studio」から始めるのが最短ルート。

- 実務活用: RAGを活用し、自社データを取り込むことで、セキュリティを担保したAI活用が実現する。

まずは公式サイトへアクセスし、Ollamaをインストールするところから始めてみましょう。PCの中に住む自分専用の秘書を、ぜひ今日から活用してください。