【完全ガイド】Qwen 3.5の選び方・動かし方|高性能AIをローカル環境で最大限活用する方法

AIを導入したいが、機密データの流出リスクが懸念でクラウドサービスを使えない、あるいはAIの利用コストを抑えたいと考えていませんか?

本記事では、世界最高峰の性能を誇りながら、個人のノートPCでも動作する「Qwen 3.5」シリーズの選び方から導入手順までを徹底解説します。この記事を読むことで、あなたのPC環境に最適なモデルを選定し、今すぐローカル環境でAIアシスタントを稼働させることができるようになります。

目次

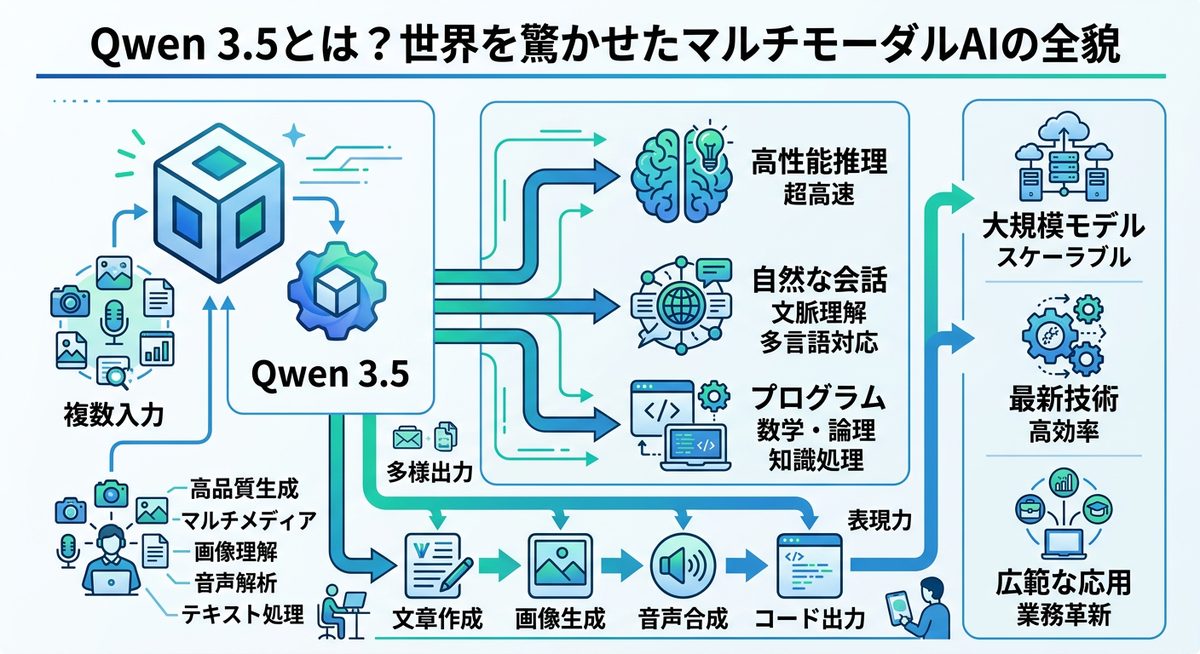

Qwen 3.5とは?世界を驚かせたマルチモーダルAIの全貌

Qwen 3.5は、Alibaba Cloudが開発したオープンソースの最新AIモデル群です。非常に高い言語理解能力と推論能力を兼ね備えており、開発者コミュニティで急速に普及しています。

AIがPCに住み着く?ローカルLLMとして注目される理由を解説

ローカルLLM(自分のコンピューター上で動く大規模言語モデル)の最大のメリットは、インターネット接続が不要である点です。まるでPCの中に極めて優秀な秘書が住み着き、外の世界とは切り離された状態で作業をこなしてくれるような安心感があります。クラウド型のAIのように、送信したデータが学習に利用される心配もありません。

マルチモーダル対応で画像・テキスト解析がこれ一つで完結

Qwen 3.5は単なるチャットボットではありません。テキストだけでなく、画像などの視覚情報を理解する「マルチモーダル(多様な形式を扱える)」性能を有しています。ドキュメントの読み取り、画像内の情報抽出、コードのレビューまでを一つのモデルで完結させることが可能です。

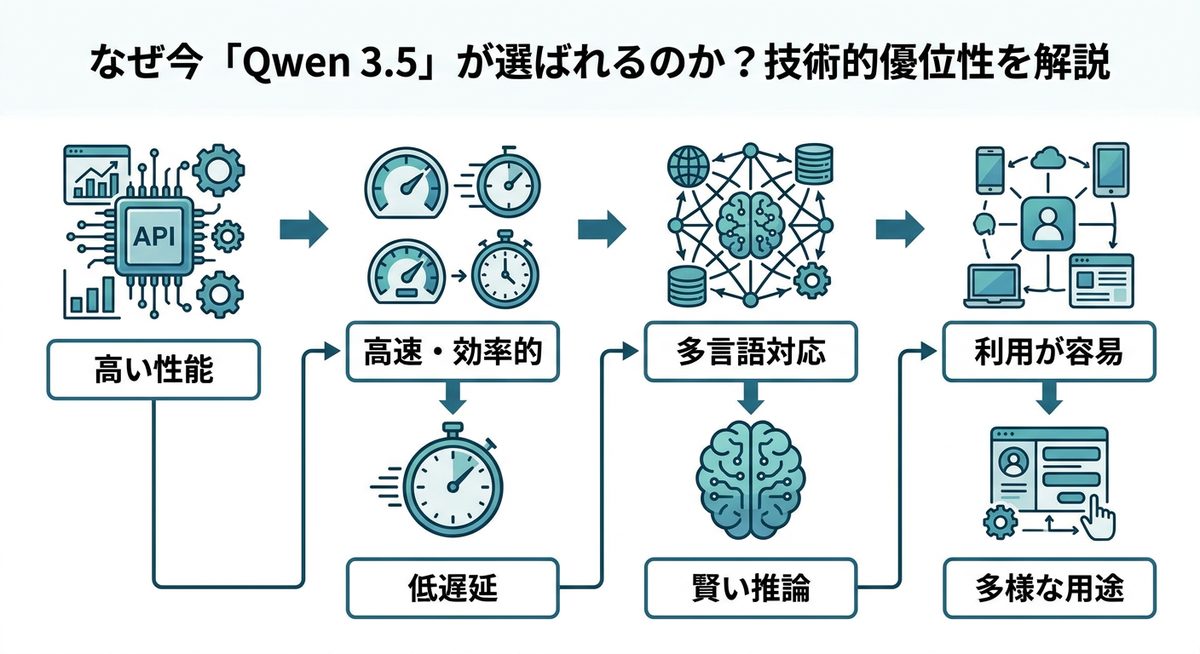

なぜ今「Qwen 3.5」が選ばれるのか?技術的優位性を解説

Qwen 3.5がこれほどまでに注目される背景には、長文処理能力と効率的な推論を実現する独自技術の存在があります。

長文処理(262Kトークン)を支える「Gated DeltaNet」の仕組み

Qwen 3.5は「Gated DeltaNet(モデルの推論効率と記憶効率を最適化する仕組み)」という最新のアーキテクチャを採用しています。これにより、最大262Kトークンという、本一冊分にも相当する膨大な情報を一度に処理できます。これは、会議の全議事録や数万行のプロジェクトコードを丸ごと飲み込んで分析するような、高度なタスクを可能にするのです。

ビジネス現場で実感できる、高い推論能力と日本語処理精度

Qwen 3.5は、特有の日本語チューニングが施されており、従来のモデルに比べても「自然で論理的な日本語」を生成します。ビジネスメールの作成から、複雑な契約書の要約、データ分析の補助まで、実務に即した高い精度を発揮します。

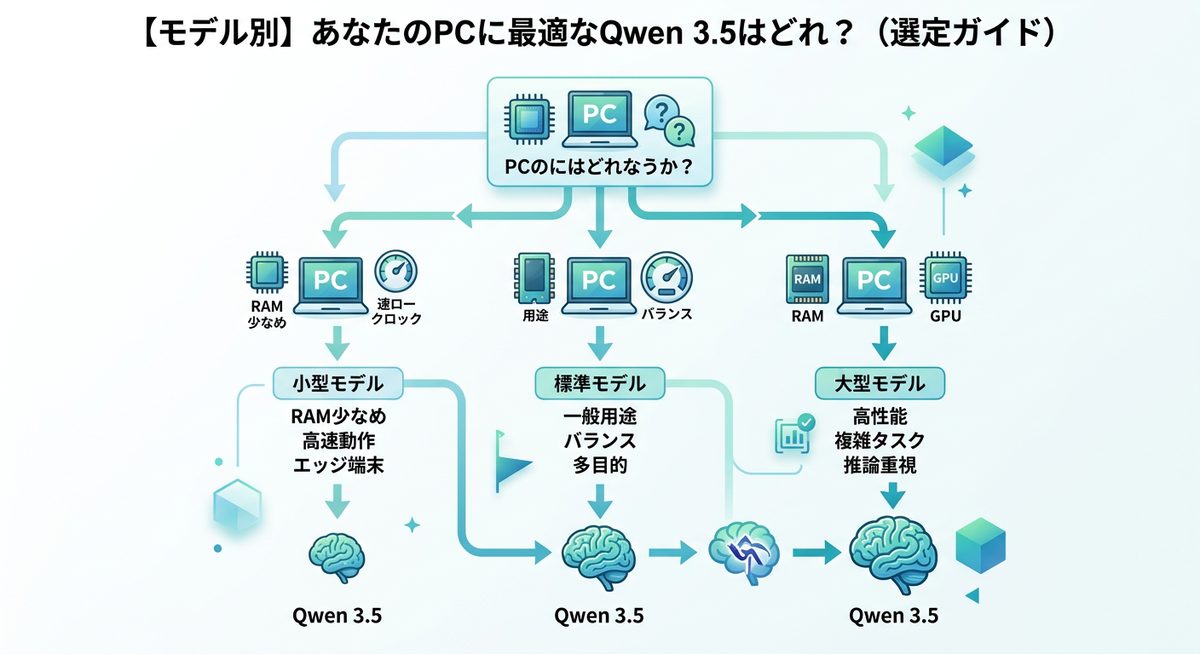

【モデル別】あなたのPCに最適なQwen 3.5はどれ?(選定ガイド)

Qwen 3.5には多様なサイズが用意されており、お使いのPCスペック(特にVRAM:ビデオメモリ)に合わせて選択可能です。

VRAM容量で決める!推奨モデル選定比較表

お使いのGPUのVRAM容量を目安に、最適なモデルを選んでください。

| モデル名 | 推奨VRAM | 特徴・用途 |

|---|---|---|

| Qwen3.5-0.8B | 2GB以下 | 超軽量、低スペックPCやスマホ向け |

| Qwen3.5-2B | 4GB | 高速応答、単純なタスク自動化に最適 |

| Qwen3.5-4B | 8GB | バランス型、日常的な文書作成やコード記述 |

| Qwen3.5-9B | 16GB以上 | 高性能、複雑な論理思考や長文分析が必要な現場 |

用途別チャート(軽量モデル vs フラッグシップモデルの使い分け)

- 日常的なメモ取り・簡易要約: 2B / 4Bモデルで十分です。応答速度が速いため、ストレスなく作業が進みます。

- 専門的なコーディング・長文レポート作成: 9Bモデルを選択してください。論理的な整合性が高まり、修正の手間が大幅に減ります。

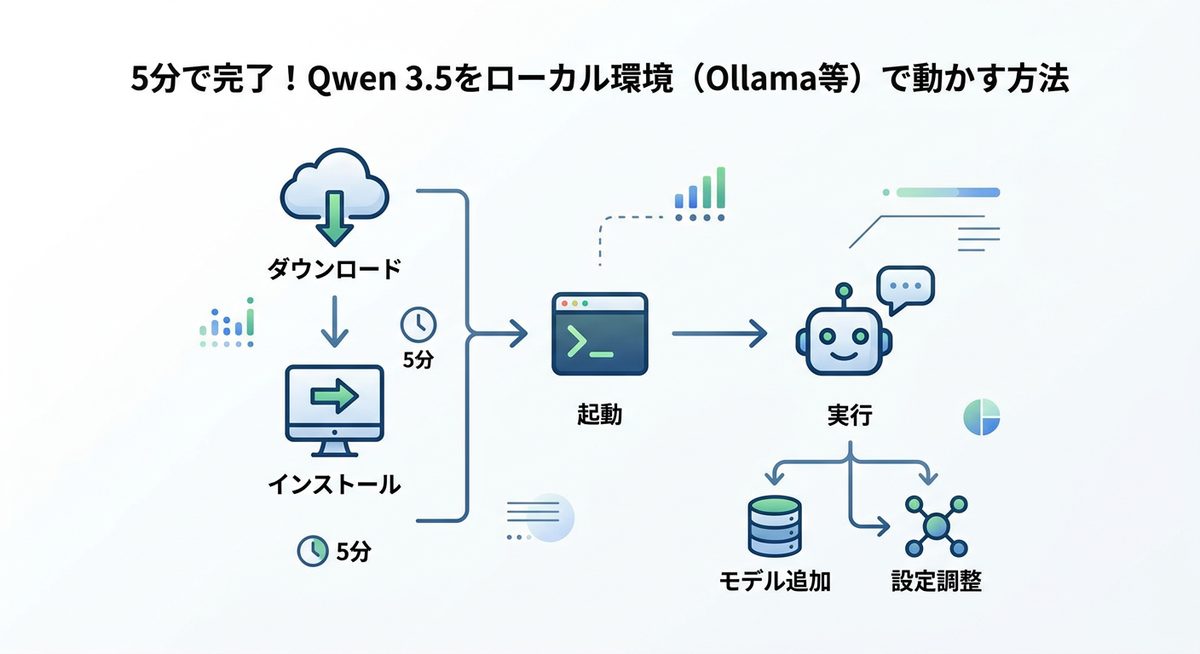

5分で完了!Qwen 3.5をローカル環境(Ollama等)で動かす方法

難しいプログラミングの知識は不要です。Ollamaというツールを使えば、数コマンドでセットアップが完了します。

環境構築のステップ:Ollama/LM Studioの導入から推論まで

- Ollamaのインストール: 公式サイト(ollama.com)からソフトをダウンロードして実行します。

- モデルの取得: ターミナル(またはコマンドプロンプト)を開き、以下のコマンドを入力します。

ollama run qwen3.5:9b - チャット開始: ダウンロード完了後、ターミナル上でそのまま日本語で質問を投げかけることができます。

コマンド一つで呼び出す!実行用プロンプトと設定のコツ

初めての方は、まず「あなたはプロの編集者です。以下の文章をビジネスメール向けに要約してください」といった指示出しから始めてみてください。ローカル環境なら何度試しても無料です。

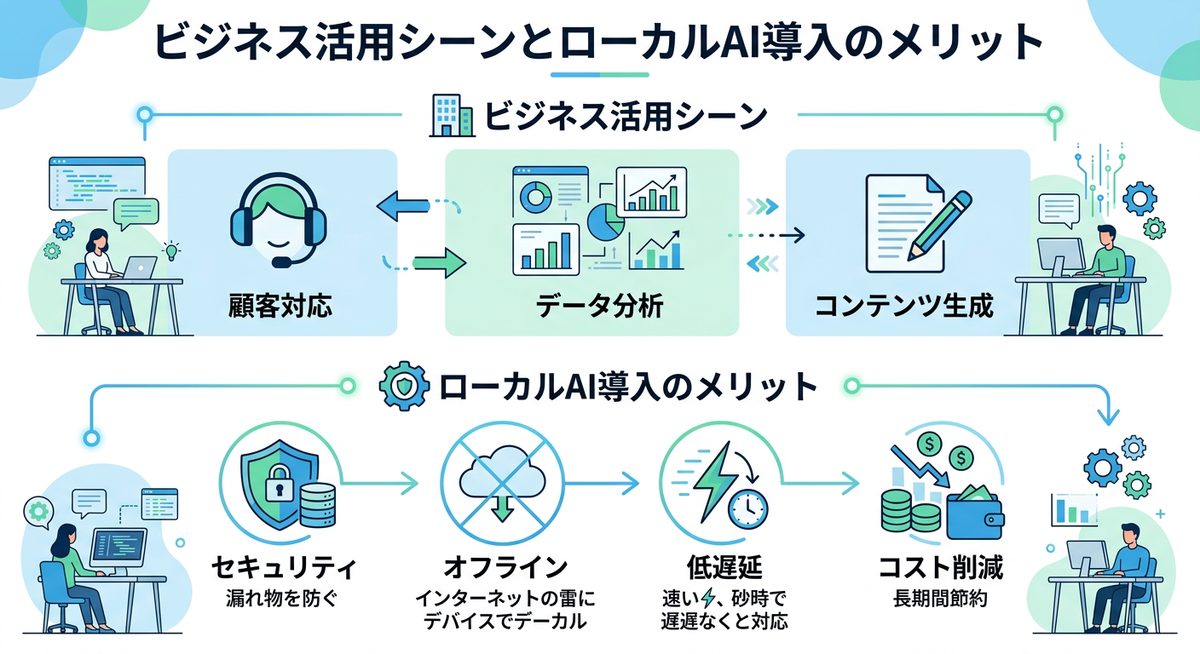

ビジネス活用シーンとローカルAI導入のメリット

ローカルLLMは、セキュリティが最優先されるビジネス現場において最強の武器となります。

機密情報を外部に漏らさない!社内データを扱うための安全策

顧客情報や未発表の企画書など、絶対に外部サーバーへ送信できないデータも、ローカル環境であれば一切外部へ漏洩しません。「ローカルで処理して、結果だけを報告する」という運用スタイルを構築することで、コンプライアンス(法令順守)と効率化を両立できます。

オフライン稼働でコスト削減とセキュリティ担保を両立させる方法

ネットワーク環境がない場所でもAIが稼働するため、出張中のオフライン作業や、災害時などのインフラ制限下でも業務を止めません。また、API利用料を気にする必要がないため、月額数万円かかっていたAIコストをほぼゼロに抑えることが可能です。

Qwen 3.5導入でよくある質問(FAQ)

スペック不足でも動く?「量子化」による軽量化の効果

Qwen 3.5は「量子化(モデルの精度を保ったままデータサイズを圧縮する技術)」という手法に対応しており、推奨VRAMより少し低いスペックでも、モデルを圧縮することで快適に動作させることが可能です。

ChatGPT(API利用)と何が違う?ローカル運用の判断基準

ChatGPTは「汎用的な知識」と「Web検索能力」に長けていますが、ローカルLLMは「機密性」「カスタマイズ性」「完全オフライン稼働」に特化しています。社内専用ツールとして育てるならローカル運用のQwen 3.5が圧倒的に優位です。

関連記事:【2026年最新・総まとめ】AIエージェントとは?仕組み・種類・主要ツール・活用事例を徹底解説

まとめ

Qwen 3.5は、個人のPC環境で高度な知能を実現するための最も強力な選択肢の一つです。本記事の要点は以下の通りです。

- 環境に合わせる: VRAMに応じて0.8Bから9Bまでのモデルを使い分ける。

- 導入は簡単: Ollamaを使えば、数分で自分専用のAI環境が完成する。

- ビジネスに特化: セキュリティとオフライン性能を活かし、機密データ分析の主軸にする。

今すぐOllamaをインストールして、あなた専用のローカルAI環境を構築し、業務効率を劇的に向上させましょう。