【エンジニア必見】Nemotron 3 Superの使い方|100万トークン対応モデルで自律型エージェントを内製化する

AIエージェントの開発において、既存の汎用クラウドLLM(大規模言語モデル)のAPIコスト高騰や、機密データを外部に送信することへのセキュリティリスクに頭を抱えていないでしょうか。

2026年3月にリリースされた「Nemotron 3 Super」は、自社インフラでの運用を前提とした最高峰のオープンウェイトモデルであり、これまでの課題を根本から解決する可能性を秘めています。本記事では、NVIDIA NIM(NVIDIA推論マイクロサービス)を活用した導入手順から、推論精度を飛躍的に高める「enable_thinking」機能の活用術まで、自律型エージェントの内製化に向けた具体的な実装手法を解説します。

目次

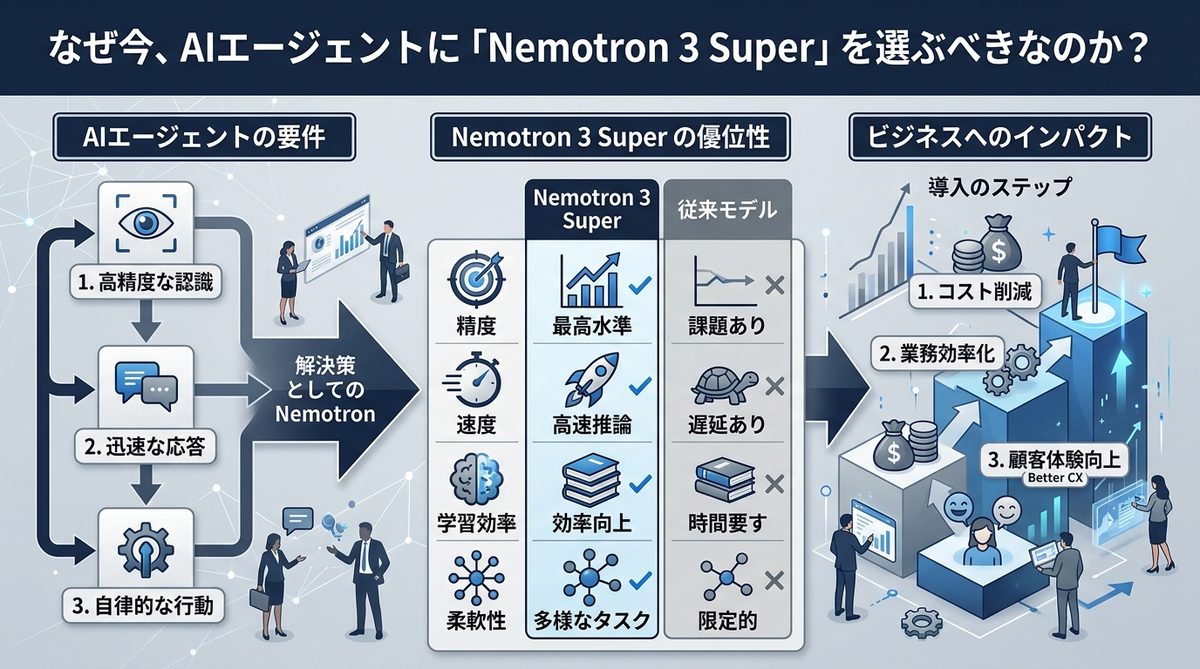

なぜ今、AIエージェントに「Nemotron 3 Super」を選ぶべきなのか?

AIエージェントの自律的なタスク遂行において、Nemotron 3 Superが従来のモデルと一線を画す理由を技術的な側面から紐解きます。

汎用LLMの限界を突破する「ハイブリッドMamba-Transformer MoE」の仕組み

Nemotron 3 Superは、Transformer(トランスフォーマー)の強力な表現力と、Mamba(マンバ)の高速な推論性能を組み合わせた「ハイブリッドMamba-Transformer MoE(混合エキスパート)」アーキテクチャを採用しています。これにより、広範な知識を保持しながらも、エージェントが複雑な推論を行う際の計算効率が劇的に向上しました。

100万トークンコンテキストがもたらす「大規模コードベース理解」の実効価値

100万トークンという広大なコンテキスト(記憶容量)は、単なる長文対応ではありません。例えば、数万行に及ぶ社内のレガシーコードベースや、数年分の蓄積された業務マニュアルを「一度のプロンプト」で読み込ませることが可能です。これにより、文脈の断絶によるハルシネーション(もっともらしい嘘)を大幅に抑制し、エージェントが自律的に正確なコード修正を行うための土台が完成します。

Claude vs Nemotron 3 Super|実務で使い分けるべき適材適所のマトリクス

汎用LLMと自社専用モデルには、それぞれの強みがあります。以下に使い分けの指標をまとめました。

| 特徴 | Claude (SaaS) | Nemotron 3 Super (Private) |

|---|---|---|

| 導入形態 | クラウドAPI | 自社オンプレ/VPC |

| セキュリティ | 外部送信リスクあり | 完全閉域化可能 |

| コスト構造 | 従量課金(変動) | 固定化(インフラ維持費) |

| 主な用途 | 高度な対話・要約 | 自律エージェントの常時稼働 |

対話などの高度なニュアンス理解はClaudeに任せ、大量のログ解析や自動実行処理はNemotronにオフロードする「ハイブリッド構成」が、2026年現在の最適解と言えます。

関連記事:【開発者向け】AIエージェント開発フレームワーク比較と選び方のコツ

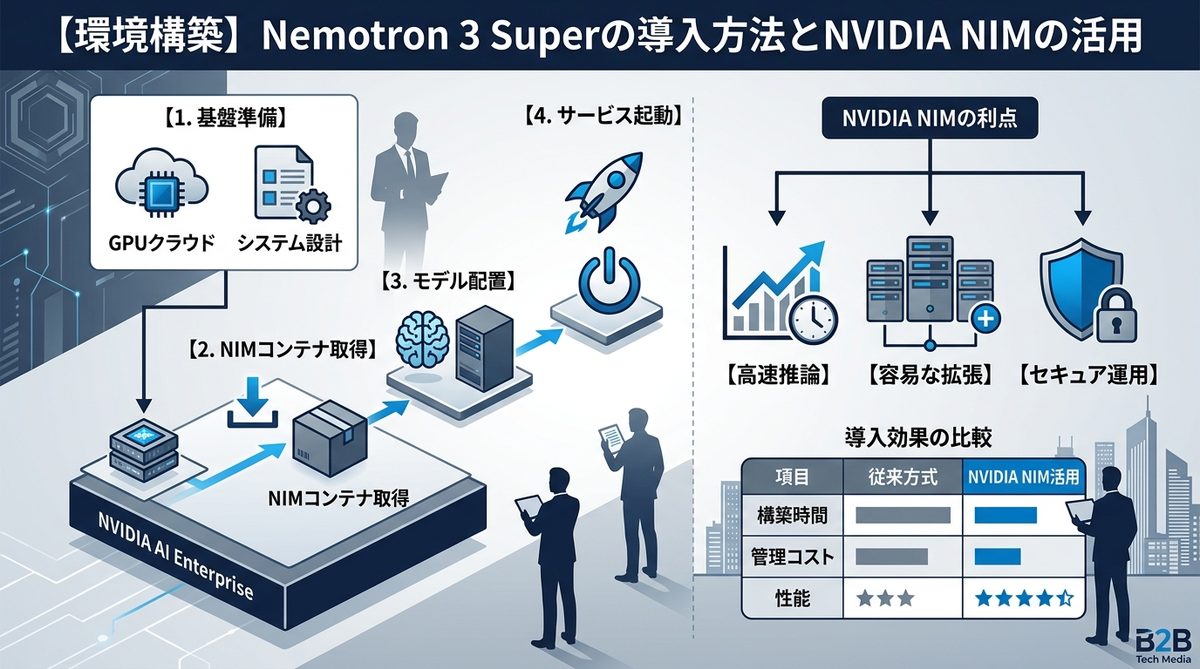

【環境構築】Nemotron 3 Superの導入方法とNVIDIA NIMの活用

Nemotron 3 Superは、NVIDIA NIMを通じてコンテナ化された状態で提供されるため、エンジニアにとって非常にデプロイが容易な設計となっています。

NVIDIA NIM経由でデプロイする際の手順とハードウェア要件

NIMを利用することで、推論エンジンが最適化されたDockerコンテナを即座に立ち上げられます。

- 環境準備: NVIDIA GPU(A100/H100推奨)を搭載したホストを用意

- NIM CLIの取得: NVIDIA NGCからアクセスキーを発行し、コンテナイメージをプル

- 起動コマンド:

docker run --gpus all -p 8000:8000 nvcr.io/nim/nemotron-3-super:latestを実行

これだけで、自社内にOpenAI API互換のローカルエンドポイントが構築されます。APIのエンドポイントを書き換えるだけで、既存のAIエージェントアプリケーションを即座にNemotronへと切り替え可能です。

Hugging Faceを用いたモデルの選定とプライベート環境への展開

VPC環境でインターネット接続を制限している場合は、Hugging Face経由で重みをダウンロードし、自社管理のレジストリへ展開します。これにより、外部への通信を一切遮断した「エアギャップ環境」での運用が実現します。

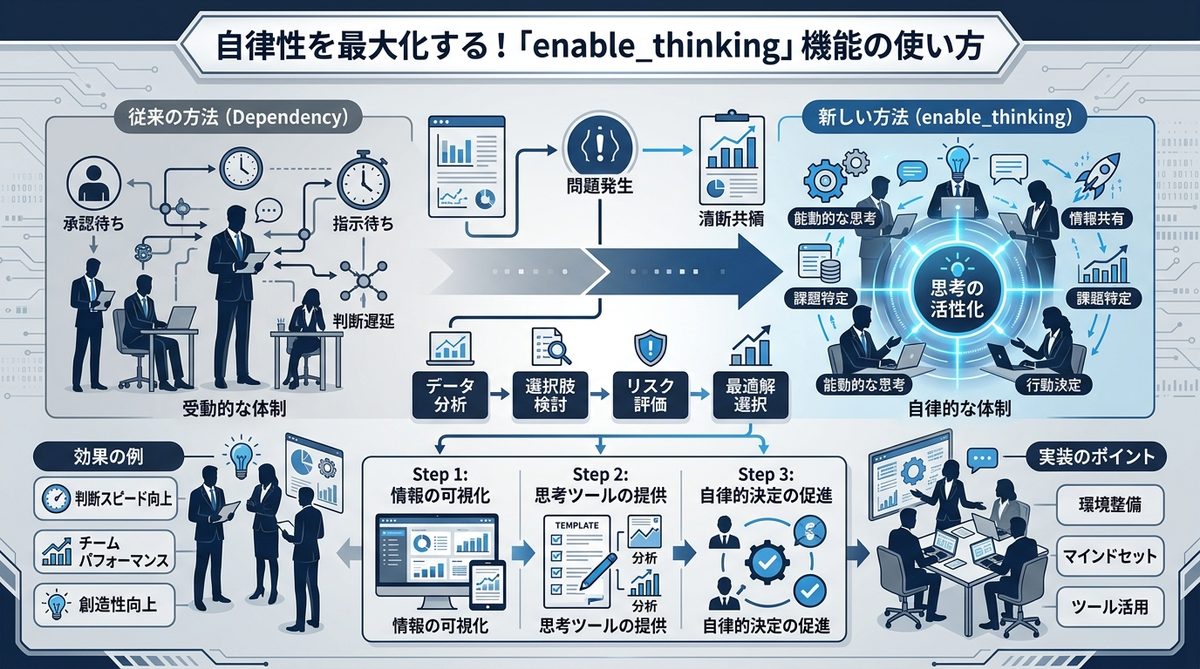

自律性を最大化する!「enable_thinking」機能の使い方

Nemotron 3 Superの真骨頂は、推論プロセスを自律的に生成する「enable_thinking」機能にあります。

推論過程を可視化する「enable_thinking」の基本設定と実装コード

API呼び出し時に enable_thinking: true を付与することで、モデルは回答を出力する前に「思考プロセス」を展開します。これは、複雑なタスクを分解し、自己検証を行う機能です。

{

"model": "nemotron-3-super",

"messages": [...],

"enable_thinking": true,

"thinking_budget": 8192

}

エージェントが迷走した際のデバッグ手法と推論精度の引き上げ術

エージェントが意図した結果を出さない場合、Thinkingログを分析することで、「どの推論ステップで誤った判断をしたか」を特定できます。これにより、単なるプロンプトエンジニアリングの試行錯誤から脱却し、ロジックに基づく修正が可能になります。

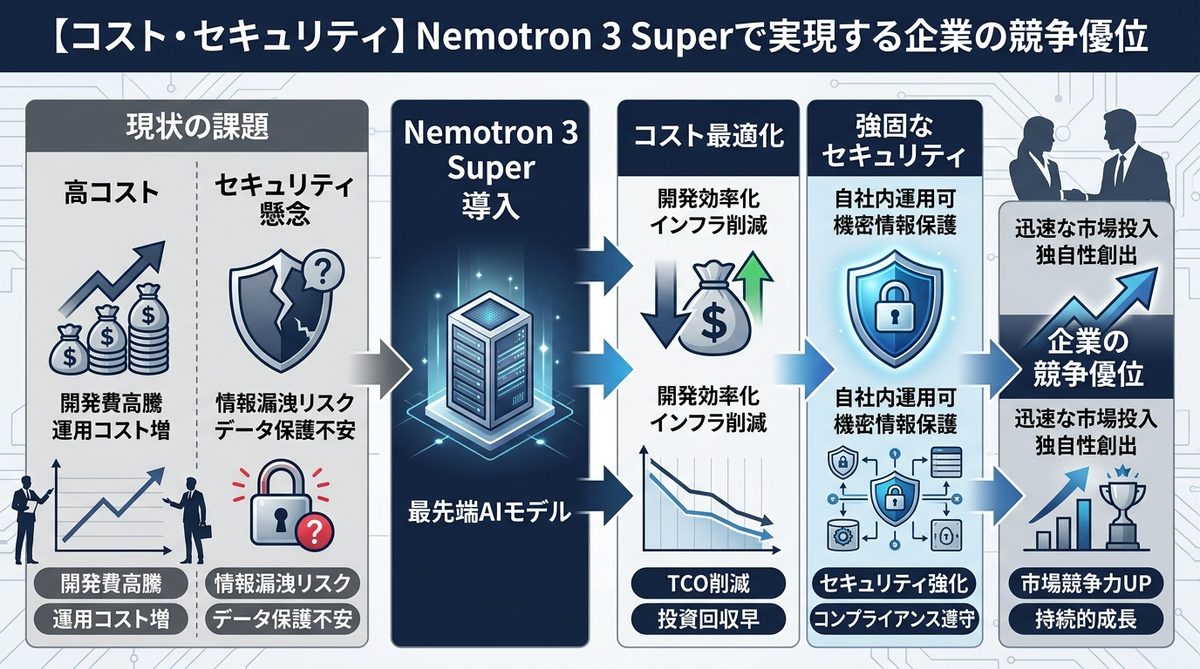

【コスト・セキュリティ】Nemotron 3 Superで実現する企業の競争優位

APIコストを「固定費」化するプライベート運用の経済的メリット

SaaSの従量課金は、エージェントの稼働頻度が上がれば上がるほど予測不能なコストを招きます。一方で、自社インフラでの運用は、初期のGPU調達やコンテナ運用費を「固定費」として予算化できるため、高頻度なバックグラウンド処理を行うエージェントにおいて圧倒的なコスト優位性を発揮します。

機密データを外部に出さない!オンプレミスLLMで守る情報資産

顧客の個人情報や社外秘のソースコードを外部のAIに投げることは、企業にとって大きなリスクです。Nemotron 3 Superを社内専有モデルとして配置すれば、情報漏洩の懸念を払拭し、全社的なAI導入を加速させることが可能です。

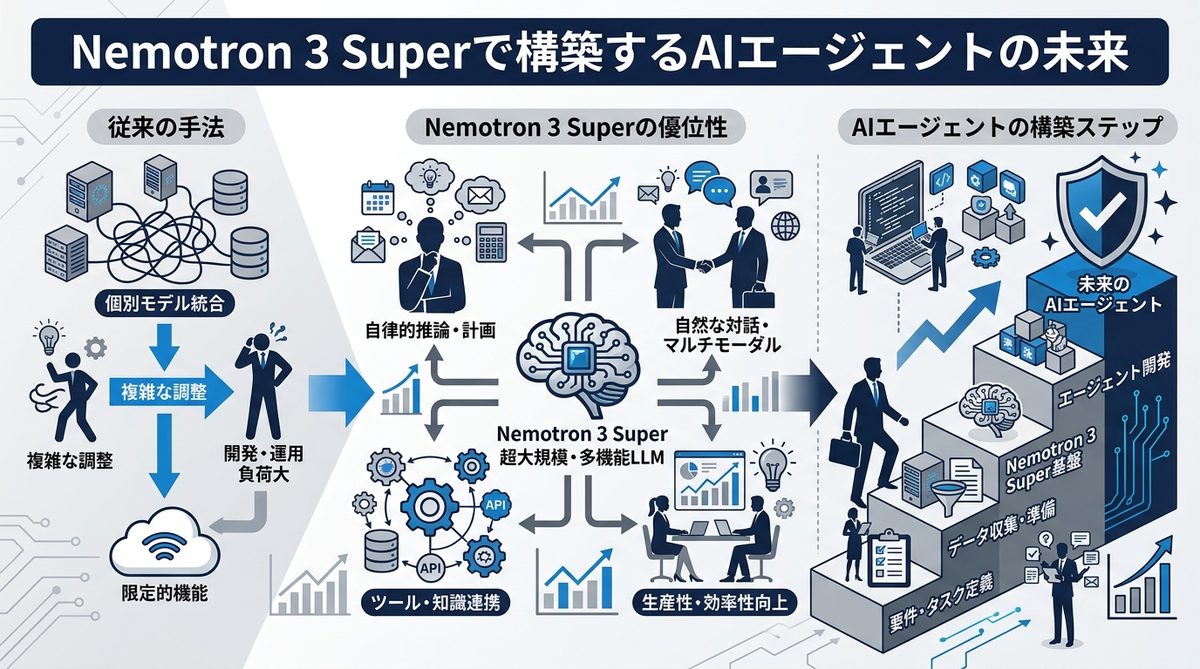

Nemotron 3 Superで構築するAIエージェントの未来

Claude Codeとの連携を見据えたハイブリッドエージェントの設計思想

日常的なコーディング支援はClaude Codeで行い、その裏で大規模なリファクタリングやテスト生成をNemotronが行う「分業体制」を構築しましょう。Claudeの柔軟性と、Nemotronの安定した自律実行能力を組み合わせることで、開発効率は劇的に向上します。

今すぐ始めるべきPoC(概念実証)のステップ

- 小規模検証: 特定の部署で、ログ解析などの非同期タスクをNemotronに移行する

- 精度測定: 既存のAPI環境と比較し、タスク完了率と推論速度を算出する

- 全社展開: 専有モデルのメリットを活かし、AIエージェントの稼働範囲を拡大する

関連記事:【中規模ビジネス向け】Claude Codeの料金体系と主要API比較ガイド

まとめ

Nemotron 3 Superの導入は、企業のAI戦略を「外部依存」から「自社主導」へと変える転換点となります。

- 技術的優位性: ハイブリッドMamba-Transformer MoEと100万トークンで、複雑かつ長大なタスクを効率的に処理可能。

- 自律性の強化: 「enable_thinking」機能を活用し、推論過程の可視化と精度向上を実現。

- 企業向けメリット: APIコストの固定化と、データプライバシーの完全な確保が可能。

今すぐNVIDIA NIMを通じてPoC環境を構築し、貴社独自の高性能なAIエージェント活用を始めてみてください。