Claude Codeの学習利用を無効化する設定と組織的な安全運用

「Claude Codeを社内で活用したいが、情報漏洩や学習利用が懸念で導入に踏み切れない」といった課題を抱えていないでしょうか。個人の設定変更だけでは、企業が求めるセキュリティ基準を満たすには不十分です。

本記事では、Claude Codeを組織で導入する際に必須となる学習データ除外設定、および技術的なガバナンス(統治)の構築手順を解説します。

この記事に対する編集部の見解

- 学習利用をオフにしても使えるモデルの性能・機能に変化はなく、デメリットはない

- 「オフ=情報が外に出ない」は誤解。データはAnthropicのサーバーを経由し続ける

- 個人の設定頼みから脱するにはTeam契約が必須。管理者が学習オフを組織全体に強制できる

Claude Codeの学習無効化設定

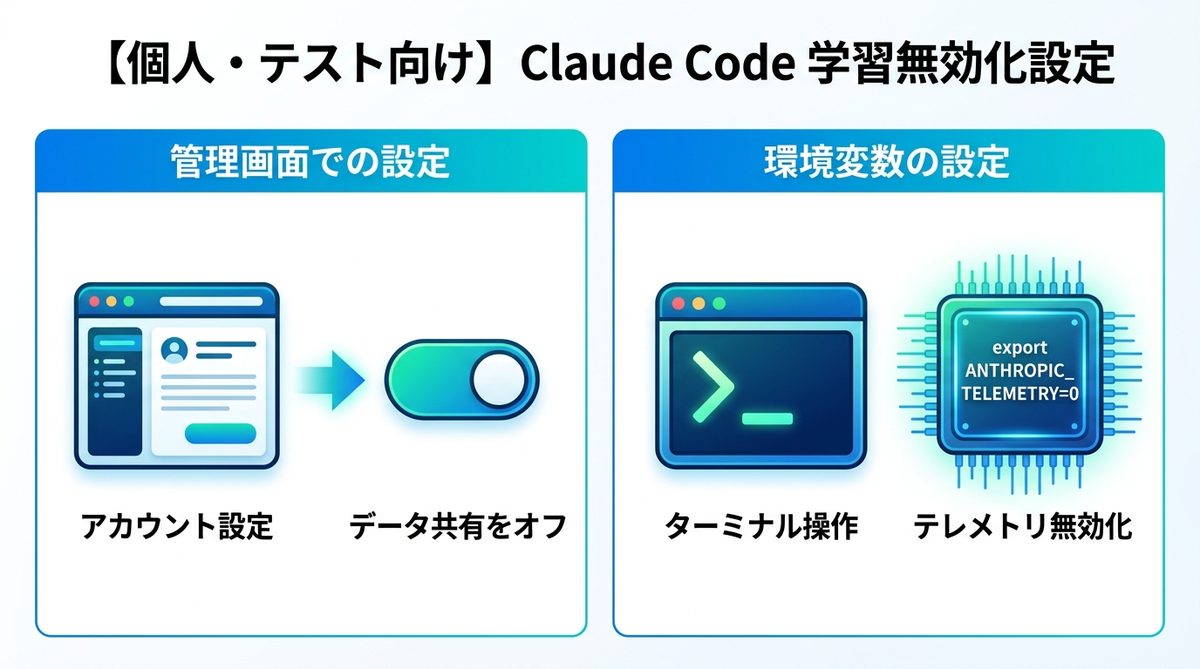

まずは、手元の開発環境でデータを保護するための基本的な設定を確認します。これらはPoC(概念実証)や個人利用の際、最初に行うべき必須操作です。

管理画面の設定変更

AnthropicのWeb管理画面(Account Settings)から、モデルのトレーニングに関する設定を変更します。

- Anthropicのコンソール画面にログインします。

- 「Account Settings(アカウント設定)」にアクセスします。

- 「Data Sharing(データ共有)」または「Help improve Claude(Claudeの改善に協力する)」という項目を探します。

- チェックボックスをオフ(無効)にします。

この設定により、以降に入力されたデータがAnthropicのモデル学習に利用されることを拒否できます。ただし、これはアカウント単位の設定であり、組織全体を管理するものではありません。

環境変数による無効化

ターミナル上でClaude Codeを呼び出す際に、特定の環境変数を設定することでデータ収集を制御できる場合があります。常にセキュアな状態を維持するため、.zshrcや.bashrcといったシェル設定ファイルに以下の記述を追加することを推奨します。

export ANTHROPIC_TELEMETRY=0

この設定は、ツール利用時におけるログ送信やテレメトリ(遠隔監視データ)の収集を抑制する役割を果たします。開発者のPC環境ごとに設定を強制することで、組織内での「設定漏れ」を防ぐことが可能です。

関連記事:【エンジニア必見】Claude Code環境をDockerで隔離!AI導入を成功させるためのガバナンスと環境構築術

設定オフが不十分な理由

個人の設定をオフにするだけでは、組織のガバナンスとしては「穴」が開いています。なぜなら、Claude Codeは単なるチャットツールではなく、PCのローカルファイルに直接アクセスする「エージェント」だからです。

責任共有モデルの理解

AI活用の現場では「責任共有モデル」という考え方が不可欠です。プラットフォーム側(Anthropic)は「データ暗号化」や「学習除外の確約」を提供しますが、以下の領域はすべて「利用者の責任」となります。

- アクセス権限: 誰がどのリソースに触れて良いかの制御

- 入力内容: 秘密情報(APIキーや社外秘コード)が含まれていないかの検閲

- 実行環境: セキュリティパッチの適用状況

データ流出と操作ログ

Claude Codeは、ユーザーの指示に従ってファイルを読み込み、コマンドを実行します。この際、Anthropicのサーバーへ送信されるデータには、指示内容だけでなく「読み込まれたファイルの中身」も含まれます。開発者が意図せず顧客情報を読み込ませた場合、それは即座にデータ流出リスクとなります。

個人利用のガバナンス課題

個人のGitHubアカウントや個人のAnthropicアカウントでClaude Codeを動かすと、組織として「誰が、いつ、どのリポジトリを操作したか」を追跡できません。退職時のアクセス権削除や、インシデント発生時のログ監査ができない点が、経営上の大きなリスクとなります。

関連記事:【IT責任者向け】Claude Code Enterpriseのガバナンス基盤|AWS・GCP連携で安全にAIコーディングを全社展開する方法

商用プランが企業導入の解

企業が安定してClaude Codeを利用するためには、個人向けプランではなく、法人向けプランを選択することが必須です。

学習利用なしの保証

商用プラン(Team/Enterprise/API)では、Anthropic側の利用規約において「入力データは学習に利用されない」ことが明示されています。また、これらは企業単位での一括管理が可能であり、管理者権限によって「学習オフ」設定を強制適用できるため、従業員個人の設定ミスを防げます。

プラン別セキュリティ比較

| 項目 | Free / Proプラン | Team / Enterprise / API |

|---|---|---|

| 学習利用 | 設定次第(個人の責任) | 規約で学習なし(保証) |

| 管理者機能 | なし | あり(SSO・権限管理) |

| ログ追跡 | 不可 | 可能(組織IDでの監査) |

| 責任範囲 | 個人 | 組織 |

関連記事:【完全ガイド】Claude Codeログの分析方法|コスト最適化とリスク管理で「部下」としてのAIを統制する

APIとMCPの安全な制御

技術面での防御として、Claude Codeを動かすための「権限の境界線」を明確に引くことが重要です。

最小権限の原則の実装

Claude Codeを動かすAPIキーには、必要最小限の権限(IAMロール)のみを付与してください。リポジトリの読み取り権限は制限し、本番環境のソースコードへの書き込み権限は原則として付与しない運用が理想的です。

mcp.jsonを活用したファイルアクセスとコマンド実行の制限

MCP(Model Context Protocol)サーバーの設定ファイルであるmcp.jsonを活用し、エージェントがアクセス可能なパスを明示的に指定します。特定の機密ディレクトリ(例:/configや/privateなど)へのアクセスを拒否する設定を共通化して配布してください。

外部通信の遮断と構築

ネットワークレベルでの制御も有効です。会社のプロキシサーバーやCASB(クラウドアクセスセキュリティブローカー)を経由させ、Claude Codeの通信先を制限することで、不正な外部サーバーへのデータ流出を物理的に遮断します。

関連記事:【セキュリティ】Claude Codeは「Dev Container」で動かすのが正解!安全なAI環境構築ガイド

Claude Code利用ポリシー

導入前に以下の項目をクリアしているか確認してください。

セキュリティ手順一覧

- 法人契約の締結: Team/Enterpriseプランを契約しているか

- SSO(シングルサインオン)の統合: 全社員のアカウント管理を中央化しているか

- MCPサーバーのホワイトリスト管理: 許可されたツール以外を実行できない設定にしているか

- 入力禁止データの策定: 個人情報・顧客名簿・秘密鍵の入力を禁止するガイドラインがあるか

- ログ監視体制: APIリクエストのログを定期的にモニタリングしているか

まとめ

Claude Codeは強力な開発支援ツールですが、組織導入には「設定」以上の「ガバナンス」が求められます。以下のステップを即座に実行しましょう。

- 個人設定に頼らない: 法人向けプランを契約し、組織単位で学習利用を禁止する。

- 技術的制限を設ける:

mcp.jsonやIAMロールを用いて、AIエージェントの行動権限を必要最小限にする。 - ポリシーを明文化する: 開発現場へ「入力して良いデータ」と「禁止データ」のガイドラインを配布する。

今すぐ貴社のセキュリティ担当者と連携し、Claude Codeを安全に活用するための「社内利用プロトコル」を策定してください。

関連記事:AIエージェントとは?概念から実装フェーズへ移行した2026年

AIエージェントナビ編集部の見解

AIエージェントナビでは、各記事のテーマについて編集長が「実際どうなの?」という素朴な疑問を「Nav」と名付けたAIエージェントにぶつけています。エンジニアではなく、経営者・ビジネス視点からの率直な見解をお届けします。

編集長の率直な感想

編集長

Nav

編集長

Nav

編集長

Nav

編集部のまとめ

- 学習利用をオフにしても使えるモデルの性能・機能に変化はなく、デメリットはない

- 「オフ=情報が外に出ない」は誤解。データはAnthropicのサーバーを経由し続ける

- 個人の設定頼みから脱するにはTeam契約が必須。管理者が学習オフを組織全体に強制できる