【決定版】AIエージェントとLLMの違いを徹底比較|「使い分け」で失敗しないための4つの判断基準

生成AIの導入が進む中で、「自社の業務をAIで自動化したいが、どこまで任せていいのかわからない」という悩みをお持ちではありませんか。チャットボット(LLM単体)で十分なケースと、AIエージェントの構築が必要なケースを混同すると、開発コストが肥大化し、セキュリティ上のリスクも高まります。

本記事では、AIエージェントとLLMの本質的な違いを解説し、失敗しないための導入判断基準を整理します。自社の業務特性に合わせた最適なAIアーキテクチャを選定し、過剰投資を回避するためのガイドとして活用してください。

目次

LLMとAIエージェントの本質的な違いとは?

LLMとAIエージェントは、どちらもAIという大きな括りに入りますが、その役割と機能には明確な差があります。

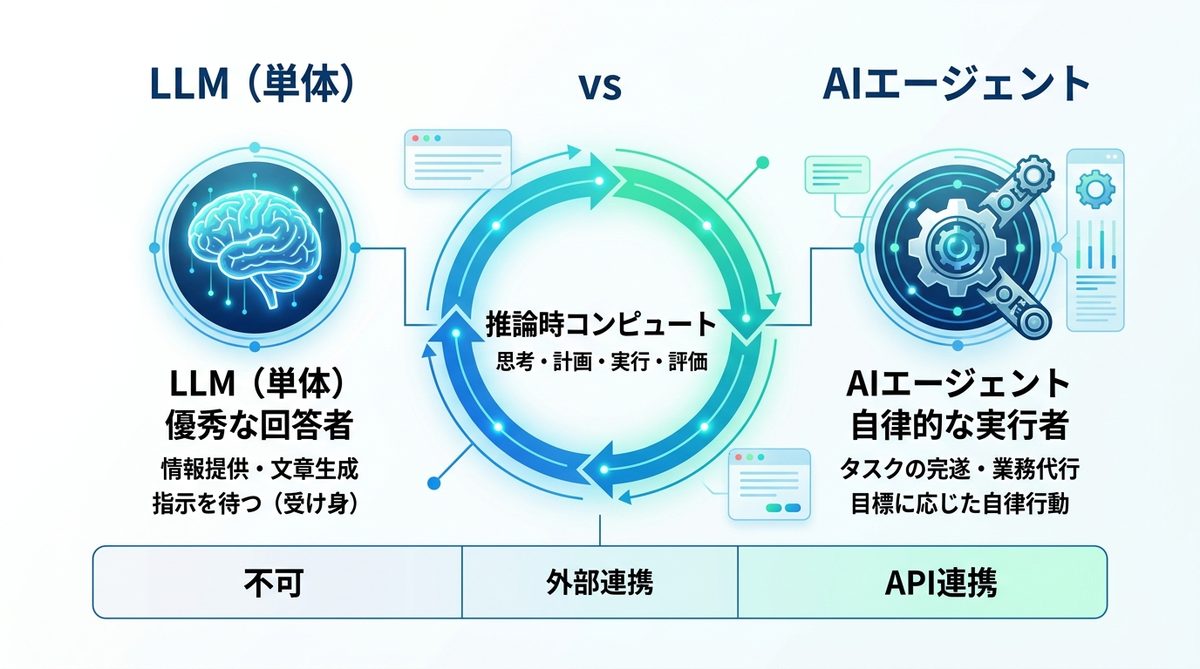

LLM単体は「優秀な回答者」、エージェントは「自律的な実行者」

LLM(大規模言語モデル)単体は、膨大な知識をもとに質問に対して回答を生成する「優秀な回答者」です。対してAIエージェントは、目標達成のために「思考・計画・実行・評価」のサイクルを自律的に繰り返す「実行者」です。

| 特徴 | LLM(単体) | AIエージェント |

|---|---|---|

| 主な役割 | 情報提供・文章生成 | タスクの完遂・業務代行 |

| 外部連携 | 基本的に不可(回答のみ) | API等を通じて外部ツールを操作 |

| 自律性 | 指示を待つ(受け身) | 目標に応じて自律的に行動 |

| 適用範囲 | 質問回答・要約・執筆 | 調査・データ入力・自動デプロイ |

推論時コンピュートの重要性|思考時間を活用する最新モデルの役割

2026年現在のAI開発において欠かせないのが「推論時コンピュート(推論の計算リソース)」という概念です。最新のモデル(o1/o3系など)は、回答を出す前に「内部で思考する時間」を設けます。これにより、複雑な論理的推論や多段階のタスク分解が可能になりました。以前は「プロンプトを工夫する」ことだけで解決していた問題も、現在は「AIに考えさせる時間を与える」ことで、精度が飛躍的に向上しています。

なぜ今、AIエージェントが注目されるのか?仕組みを紐解く

AIエージェントが注目される理由は、AIがPCの中に住み着き、人間のようにツールを操作できるようになったためです。

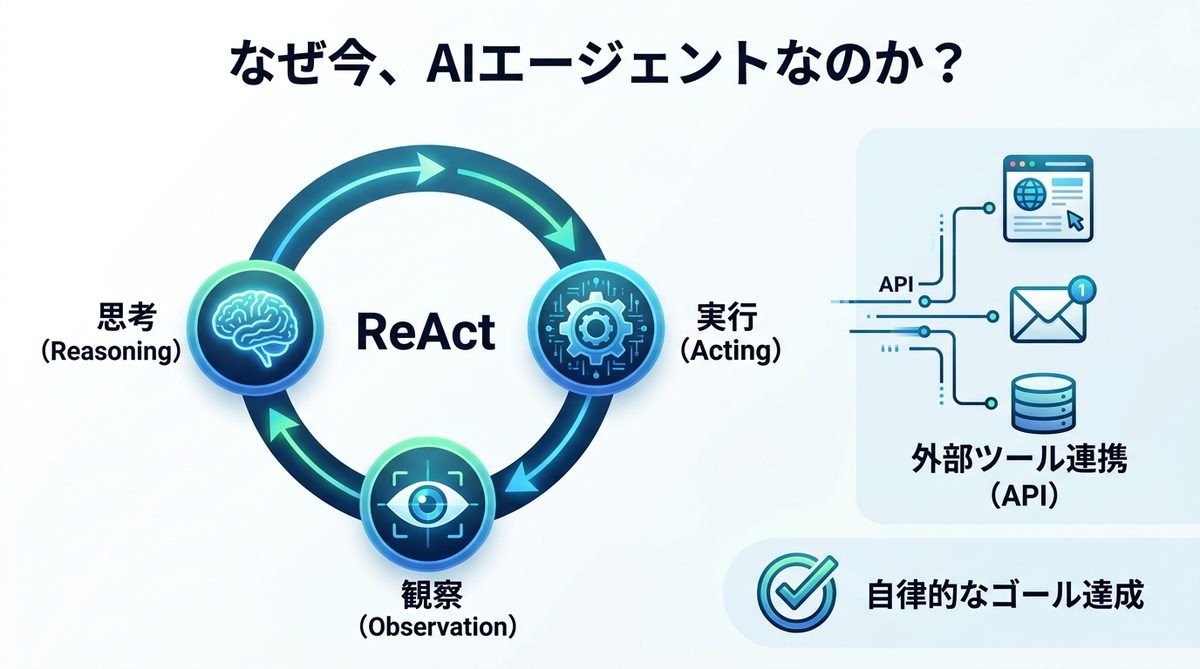

ReAct(思考+実行)アーキテクチャのループ構造を図解

AIエージェントが自律的に動く仕組みを、「ReAct(Reasoning+Acting)」と呼びます。これは「思考(Reasoning)」と「実行(Acting)」のループです。

- 思考(Reasoning): 目的達成のために必要なタスクを分解し、計画を立てる。

- 実行(Acting): 検索エンジンやデータベース等のツールを使い、情報を取得・操作する。

- 観察(Observation): 実行結果を確認し、目標に到達したか判断する。

このプロセスを繰り返すことで、人間が途中で指示を出さなくてもAIが勝手にゴールへたどり着くのです。

外部ツール連携で広がる「できること」の限界値

LLM単体はブラウザの外に出られませんが、エージェントはAPI(外部ソフトウェアとの接続口)を介して社内システムやメーラーを操作できます。「会議の議事録を書き、参加者にメールを送信し、タスク管理ツールに項目を追加する」といった一連の流れを、エージェントは「PCの中に住む優秀な事務スタッフ」のように実行できるのです。

【2026年最新】導入判断マトリクス|LLMとエージェントを使い分ける損益分岐点

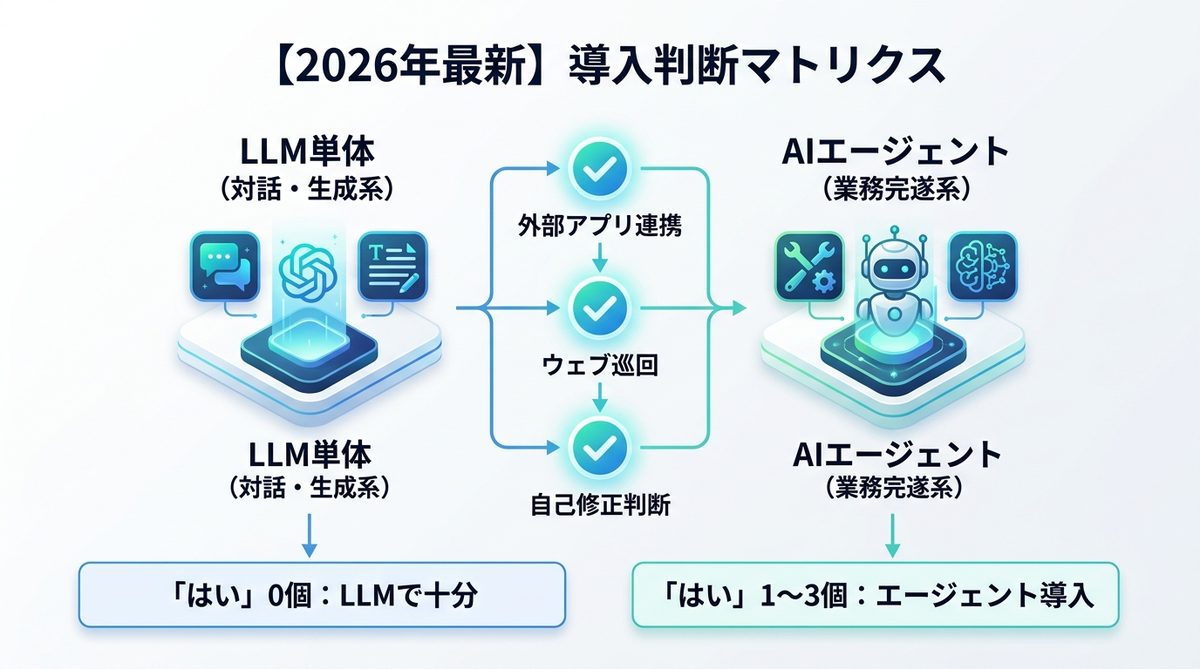

過剰なシステム設計を避けるために、以下の判断基準を確認してください。

1. タスクの複雑性とレイテンシ許容度による切り分け方

- LLM単体が適しているケース: 答えが一つに定まる、または即時性が求められる「対話・生成系」タスク。

- エージェントが適しているケース: 複数のツールを跨ぐ、または「調べながら考える」が必要な「業務完遂系」タスク。

2. 意思決定フローチャート|あなたの業務は「単体」で十分か?

以下の質問に「はい」がいくつあるか数えてみてください。

1. 外部アプリ(Slack/Gmail等)への書き込みが必要か?

2. 複数のウェブサイトを巡回して情報を集める必要があるか?

3. 手順が複雑で、AIが自分で修正判断を行う必要があるか?

- 「はい」が0個: LLM単体(チャットボット等)で十分です。

- 「はい」が1〜3個: AIエージェントの導入を検討する価値があります。

導入時のアンチパターン|過剰設計とリスク管理

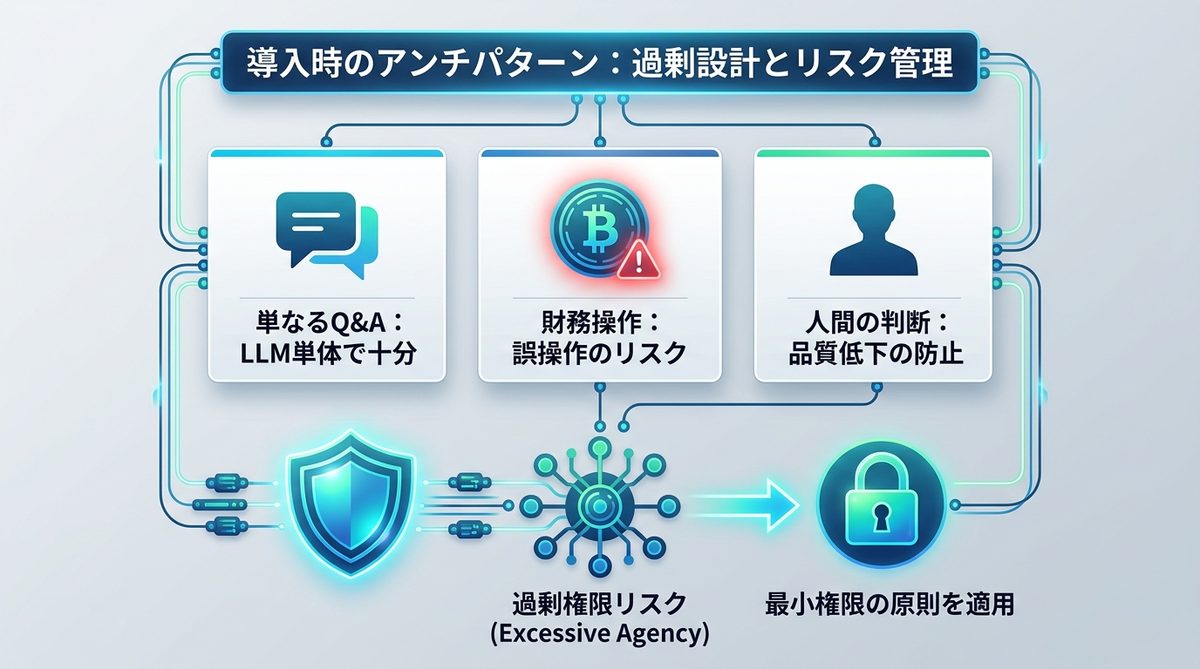

何でもエージェント化すれば良いわけではありません。失敗しないための注意点があります。

何でもエージェント化してはいけない3つのケース

- 単なるQ&A業務: 社内規定のFAQなどはLLM単体で十分であり、エージェント化はコストの無駄です。

- ミスが許されない財務操作: 権限の範囲が広すぎるエージェントは、誤操作のリスクが極めて高いです。

- 人間による判断が必須のプロセス: 最終承認などの人間性を要する部分は、自動化すると品質低下を招きます。

OWASP LLM Top 10に基づく「過剰権限リスク」への警告

AIエージェントに「社内システムを操作する権限」を与える際は注意が必要です。セキュリティ界の格言である「過剰権限リスク(Excessive Agency)」は、エージェントが必要以上に広い範囲へアクセスできる状態を指します。もし悪意ある指示(プロンプトインジェクション等)をAIが受け取った場合、エージェントが社内データを全削除してしまう可能性すらあります。必ず「最小権限の原則」を適用し、AIには必要最小限の操作のみを許可してください。

ビジネス現場で活きる!AIエージェント導入の成功ステップ

AIエージェント導入を成功させるための手順を解説します。

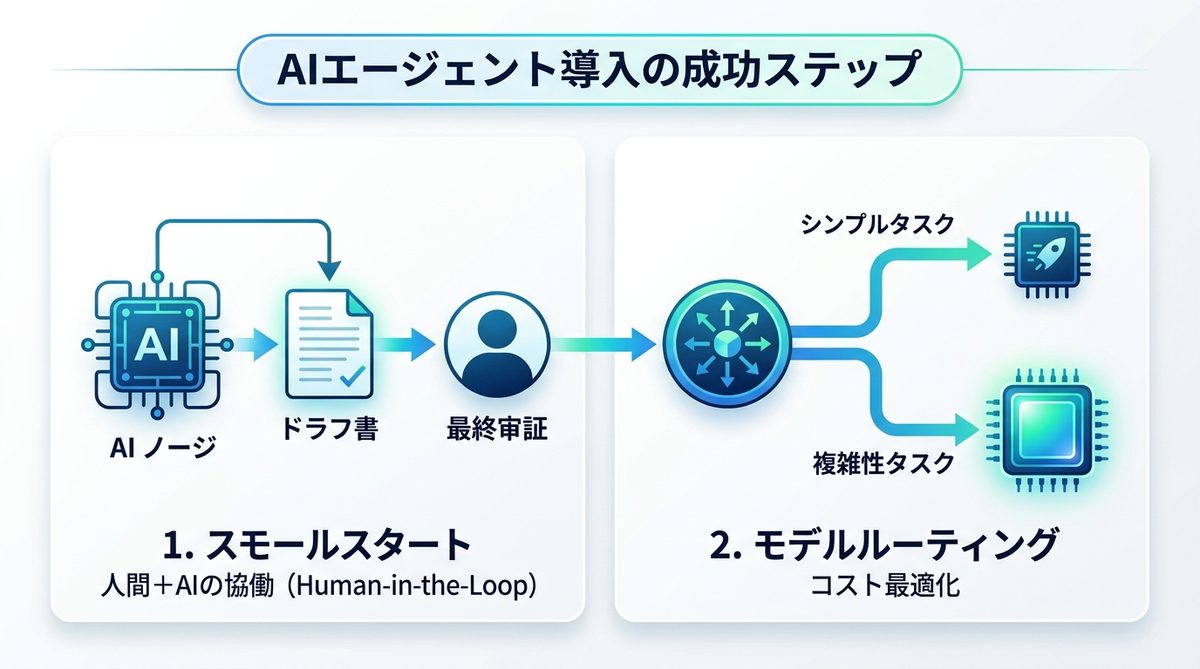

1. スモールスタートで構築する「人間+AI」の協働環境

最初は「AIが案を作成し、人間が最後にクリックする」というヒューマン・イン・ザ・ループ(人間の承認プロセス)から始めてください。いきなり全自動化を目指すと、修正コストが膨らみます。

2. 運用コストを最適化するモデルルーティング戦略

簡単なタスクは軽量なモデル(高速・低価格)、複雑なタスクは推論能力の高いモデル(高価格)へ自動で振り分ける「ルーティング」を活用しましょう。すべてを最高性能のモデルで動かすと、ランニングコストが跳ね上がります。

まとめ

AIエージェントとLLMは、どちらが優れているかという対立軸ではなく、業務要件に合わせた「適材適所の組み合わせ」が不可欠です。

- LLMは「回答」、AIエージェントは「自律的な実行」が得意

- 推論時コンピュートの活用でAIの賢さは飛躍的に向上している

- 導入判断マトリクスを活用し、過剰投資とリスクを未然に防ぐ

- 権限は最小限に留め、セキュリティリスクをコントロールする

まずは現在の業務プロセスを棚卸しし、自動化が必要なタスクの優先順位付けから今すぐ始めましょう。