【2026年最新】ローカルAIエージェントの作り方|Ollama×Open WebUIで完全オフライン構築

AIを業務に取り入れたいけれど、機密情報の扱いやコストが心配で踏み出せない。そんな悩みを持つビジネスパーソンにとって、今最も注目すべき選択肢が「ローカルAIエージェント」です。

本記事では、自分のPCの中にAIを構築し、外部へ情報を漏らさず、かつ無料で自律的にタスクをこなす環境の作り方を解説します。OllamaとOpen WebUIを活用した最短構築手順から、手元の資料をAIに読み込ませる「ローカルRAG(外部データ参照)」の活用法までを網羅しました。

目次

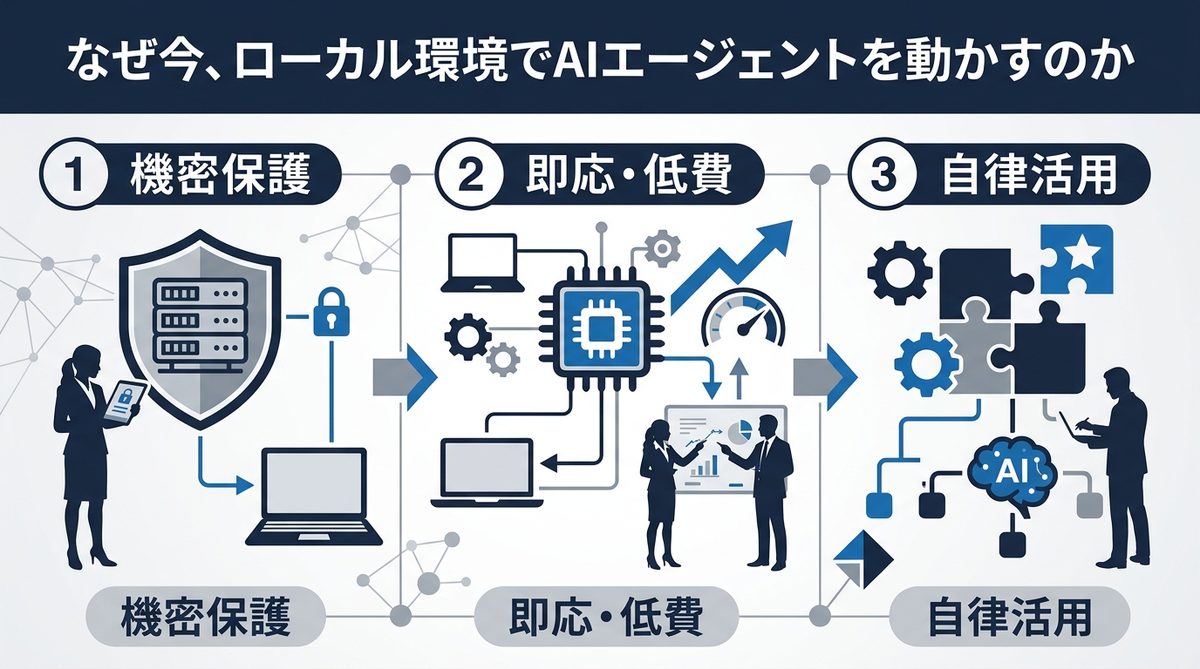

なぜ今、ローカル環境でAIエージェントを動かすのか

クラウド型のAIサービスは便利ですが、ビジネス利用ではセキュリティやコストが壁になることも少なくありません。PCの中に優秀なアシスタントが住み着いた状態を作れば、これらの課題は一気に解消されます。

プライバシー保護とコスト削減のメリットとは

ローカル環境でAIを動かす最大のメリットは「情報の完全遮断」です。社外秘のドキュメントや未公開の戦略データをAIに入力しても、外部サーバーに送信されることはありません。また、API利用料を気にする必要がなく、何度でも無料で対話・自律処理を試せます。

ネット不要!PCの中に優秀なアシスタントが住み着く体験

ローカル環境はネット接続が不要なため、オフラインでも安定して動作します。一度環境を構築すれば、PCが物理的に動く限りAIアシスタントは常に待機しており、あなたの業務を影で支え続けます。

【実践編】最短5分で構築:Ollama × Open WebUI インストールガイド

ここからは実際に、あなたのPCをAIの拠点へと変身させましょう。初心者の方でも迷わないよう、コマンド操作を最小限に絞って解説します。

ハードウェア要件チェックリスト

ローカルAIを快適に動作させるためには、一定のスペックが必要です。以下の要件を満たしているか確認してください。

- 推奨GPU: NVIDIA RTX 4070以上(VRAM 8GB以上必須)

- Apple Silicon Mac: メモリ 16GB以上(M1/M2/M3/M4搭載機を推奨)

- ストレージ: 空き容量 20GB以上(モデルデータ保存用)

コマンドをコピペで実行!インストールと初期設定手順

まずはAIエンジンである「Ollama」をインストールします。

- Ollama公式サイトからインストーラーをダウンロードして実行します。

- ターミナル(コマンドプロンプト)を開き、以下のコマンドを入力してモデルをダウンロードします。

ollama run deepseek-r1:8b - 次に、ChatGPTのような操作画面を提供する「Open WebUI」をDocker(仮想環境構築ツール)経由で立ち上げます。

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main - ブラウザで

http://localhost:3000にアクセスすれば、ローカルAIエージェントの完成です。

初めての質問〜自律動作を試すためのステップ

画面が立ち上がったら、まずは「こんにちは」と入力してみましょう。レスポンスが返ってくれば成功です。Ollamaはバックグラウンドで動いているため、次からはブラウザを開くだけでAIと対話が可能です。

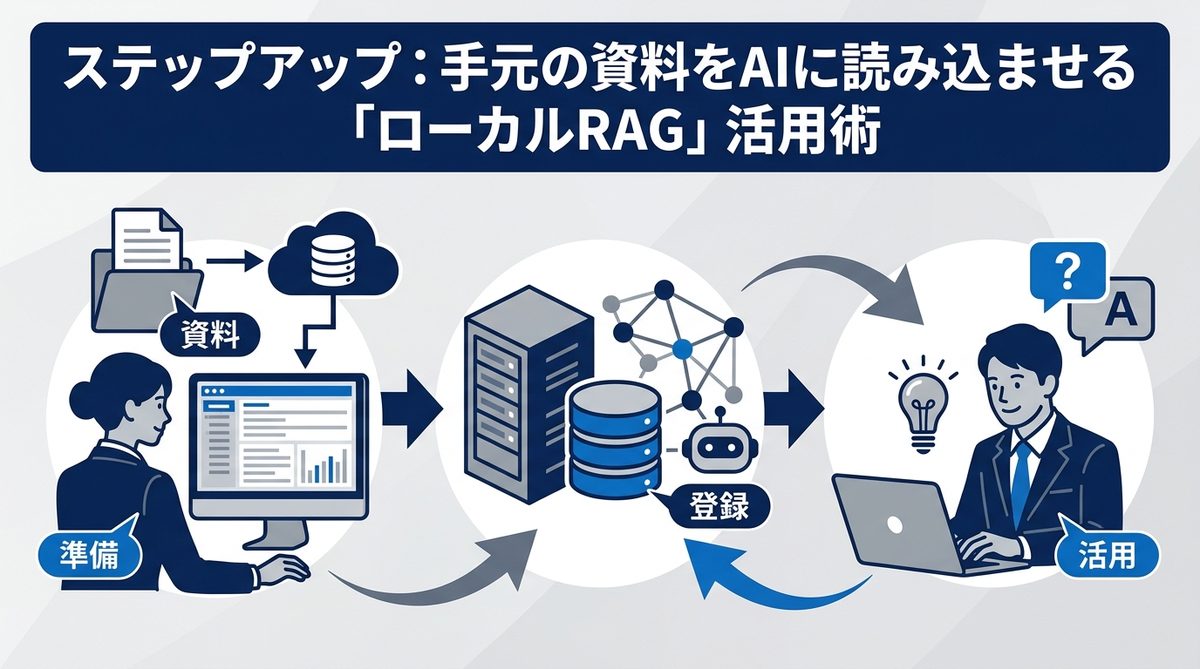

ステップアップ:手元の資料をAIに読み込ませる「ローカルRAG」活用術

単なるチャットボットから、「あなたの業務を理解するエージェント」へと進化させるのがRAG(検索拡張生成)です。

RAG(外部データ参照)でAIがあなたの専門家になる仕組み

RAGとは、AIが外部のデータベースや文書を「図書館の本」のように参照して回答する仕組みです。AI自体を再学習させるのではなく、資料の内容をその場で検索させることで、専門的な回答を正確に行わせることができます。

Open WebUIを使ってローカルドキュメントを読み込ませる手順

Open WebUIには、RAG機能が標準搭載されています。

- 画面左下の「+」ボタンや、チャット入力欄のファイルアイコンをクリックします。

- 読み込ませたいPDFやWordファイルをアップロードします。

- 「#」を入力すると、アップロードしたファイルが候補に出ます。それらを選択して質問を送ると、AIはファイルを読み込み、その内容に基づいた正確な回答を生成します。

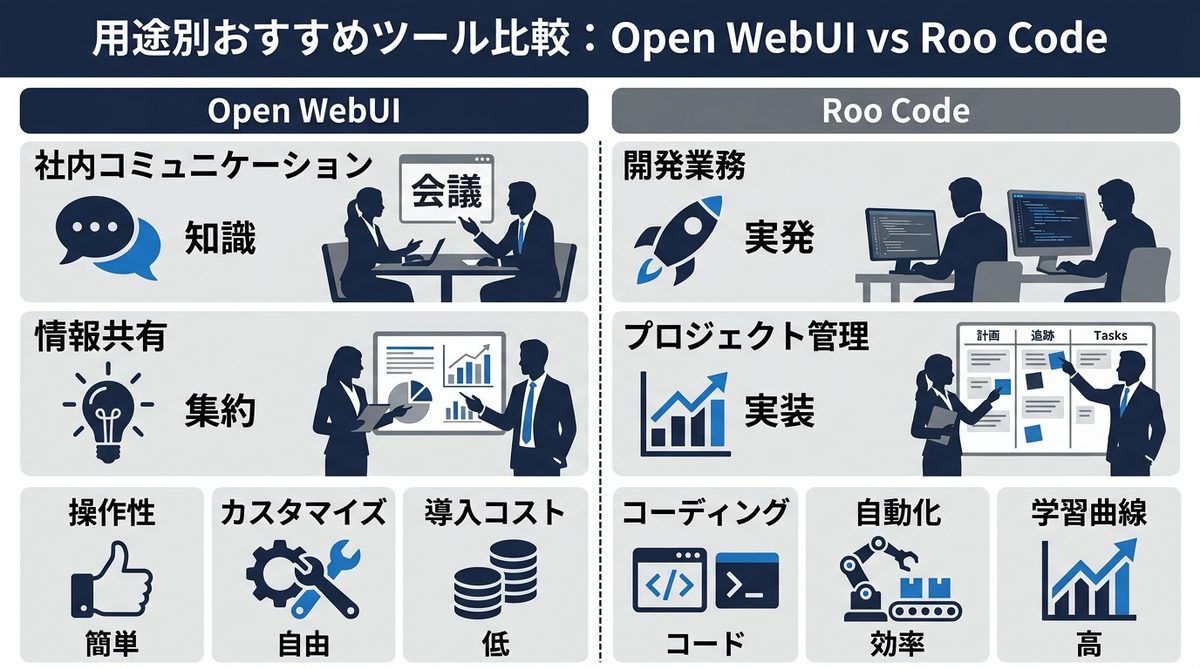

用途別おすすめツール比較:Open WebUI vs Roo Code

AIエージェントの使い道によって、最適なツールは異なります。以下の表を参考に、あなたの目的に合わせて選んでください。

| 比較項目 | Open WebUI | Roo Code |

|---|---|---|

| 主な用途 | 文章作成・要約・チャット | コード生成・開発・自動修正 |

| 操作環境 | ブラウザ(UI型) | VSCode(IDE統合型) |

| 難易度 | 初心者向け(直感的) | 初級エンジニア向け |

| 強み | ファイル読み込みが容易 | 実際のコード修正が爆速 |

ブラウザ操作で完結する「Open WebUI」の強み

ドキュメントの整理や企画案の作成など、汎用的な業務にはOpen WebUIが最適です。直感的な画面で、複雑な設定なしに資料を読み込ませることができます。

VSCodeで爆速コーディング!「Roo Code」の活用シーン

プログラミングやスクリプト作成を行う場合は、VSCodeの拡張機能である「Roo Code」を推奨します。開発環境とAIが完全に一体化するため、AIが提案した修正コードを即座に適用可能です。

関連記事:【開発者向け】AIエージェント開発フレームワーク比較と選び方のコツ

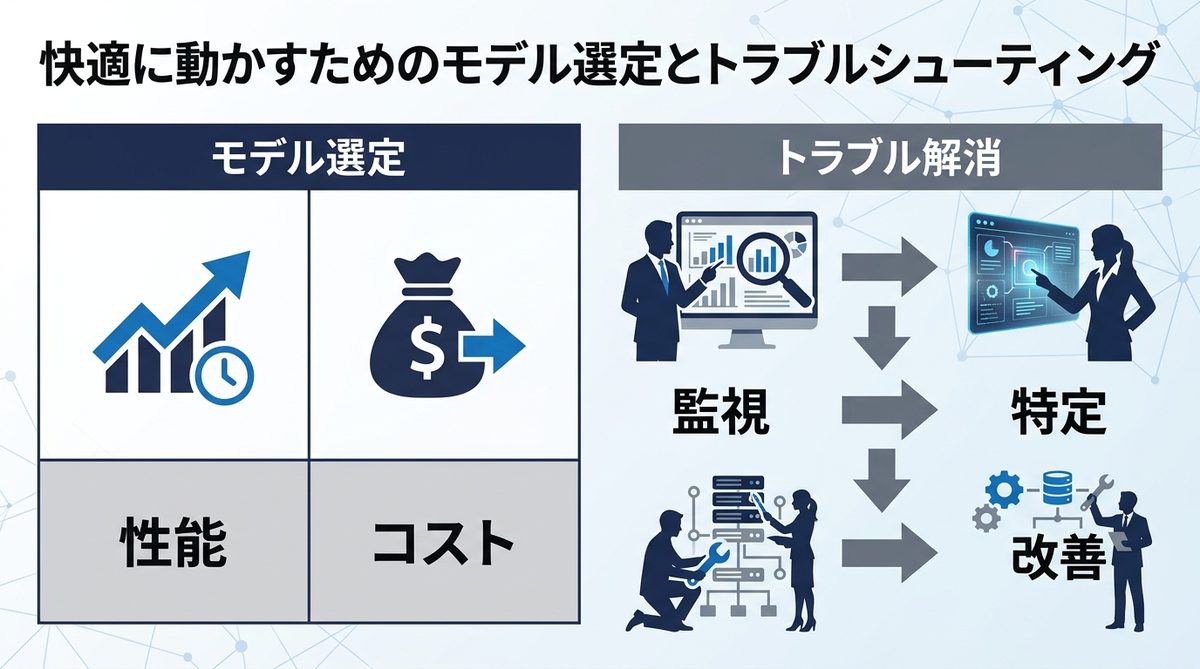

快適に動かすためのモデル選定とトラブルシューティング

AIエージェントの動作は「モデルの重さ」と「環境設定」に大きく左右されます。

PCスペック別・最適なおすすめモデル

- 高スペック機(VRAM 16GB〜):

deepseek-r1:32bを推奨。複雑な推論が可能です。 - 標準スペック機(VRAM 8GB):

deepseek-r1:8bまたはllama3.2:3b。軽快な動作が魅力です。

AIが動かない時に確認すべき「GPU・ポート・環境変数」一覧

もしAIが反応しない場合は、以下の3点を確認してください。

- Dockerは起動しているか:

docker psコマンドでコンテナが動いているか確認。 - GPUを認識しているか:

nvidia-smiコマンドでGPUが利用可能かチェック。 - ポート競合: 3000番ポートが他のアプリで使用されていないか確認してください。

まとめ:あなたのPCを最強のAI基地に

ローカルAIエージェントの構築は、一見難しそうに見えますが、現代のツールを使えば驚くほど簡単に実現可能です。プライバシーを保護しつつ、自分専用の賢い相棒を手に入れることで、業務の生産性は飛躍的に向上します。

- Ollama × Open WebUI でセキュアなAI環境を構築する

- RAG機能を活用し、社内文書をAIに読ませて回答精度を高める

- 用途に応じて、UIベースのOpen WebUIと開発特化のRoo Codeを使い分ける

今すぐPCに環境を構築し、あなただけのAIエージェントと効率的な働き方を始めましょう。