【比較検証】Claude CodeをOllamaでセキュアに使う現実|公式API環境と比較して分かった3つの適材適所

Claude Codeの圧倒的な開発効率に魅力を感じつつ、クラウドへのコード送信や月々のAPI利用料に課題を感じているDX担当者やチームリーダーは少なくありません。ローカル環境でLLMを動かすことは一見、セキュリティとコストの両面で理想的な解決策に見えますが、果たして本当に業務で実用レベルに達しているのでしょうか。

本記事では、Ollama(ローカルでLLMを動かすためのプラットフォーム)を活用した非公式連携の仕組みと、導入判断に必要なROI(費用対効果)の視点を詳細に解説します。

目次

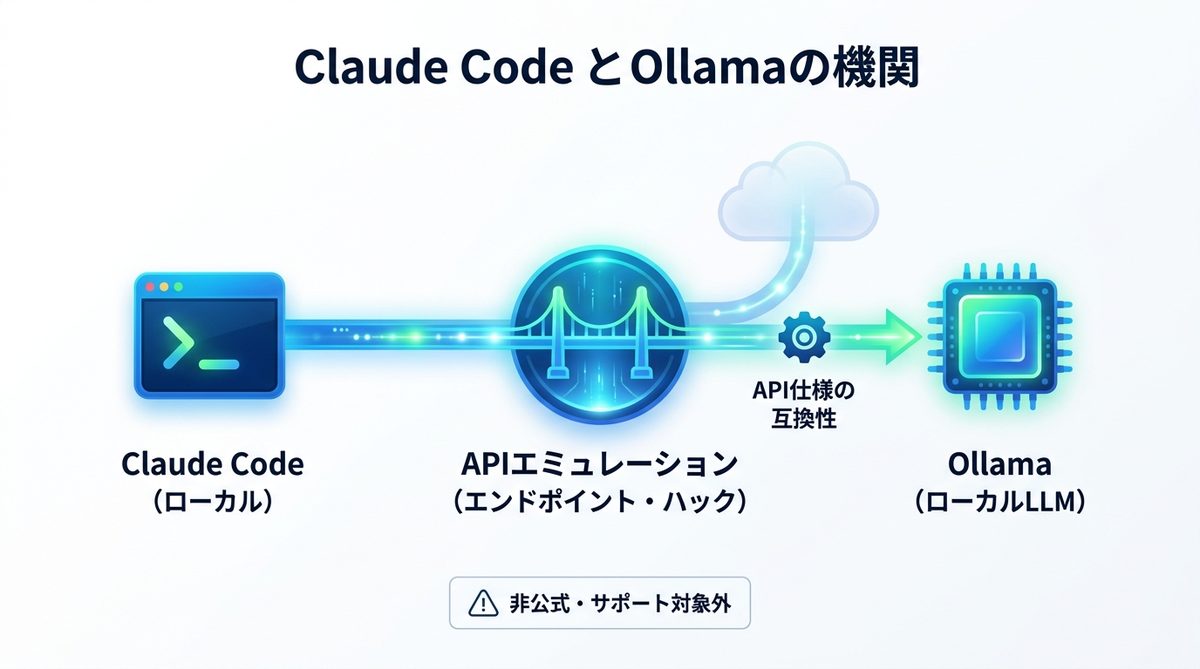

Claude CodeとOllama連携の仕組みとは?【APIエミュレーションの正体】

Claude Codeをローカルで動かすという手法は、いわば「本来の宛先をすり替える」ハックです。まずは、その技術的な裏側を理解しましょう。

公式APIを擬態する「エンドポイント・ハック」の仕組み

Ollama連携は、Ollamaが提供するAPIサーバーを、Anthropic社が提供する公式APIのエンドポイント(接続先)であるかのように偽装(エミュレート)することで実現します。Claude Codeは本来、Anthropicのサーバーに対して指示を投げますが、設定を変更することでその通信先をローカルのOllamaに向けるのです。これにより、Claude Codeは「相手が本物のClaude 3.5 Sonnetである」と認識し、ローカルのLLMモデルと会話を開始します。

【重要】Anthropic公式機能ではない「サポート対象外」という前提条件

ここで最も注意すべき点は、これがAnthropicの「公式サポート外」であるということです。本手法はコミュニティによって開発されたものであり、将来的にClaude Codeのアップデートが行われた際、突然動作しなくなる可能性があります。業務システムとして組み込む際は、公式サポートを受けられないリスクを許容できるか、あるいは自社エンジニアがメンテナンスできる体制があるかという判断が必須です。

なぜローカルLLMでClaude Codeが動くのか(互換性の原理)

Claude Codeは、Anthropicが策定したAPI仕様に準拠して動作します。Ollamaが提供するAPIはこの仕様と高い互換性を持っているため、データの入出力形式さえ合致していれば、中身がどのような言語モデル(Llama 3やMistralなど)であっても、ツール側は支障なく動作を継続できるのです。

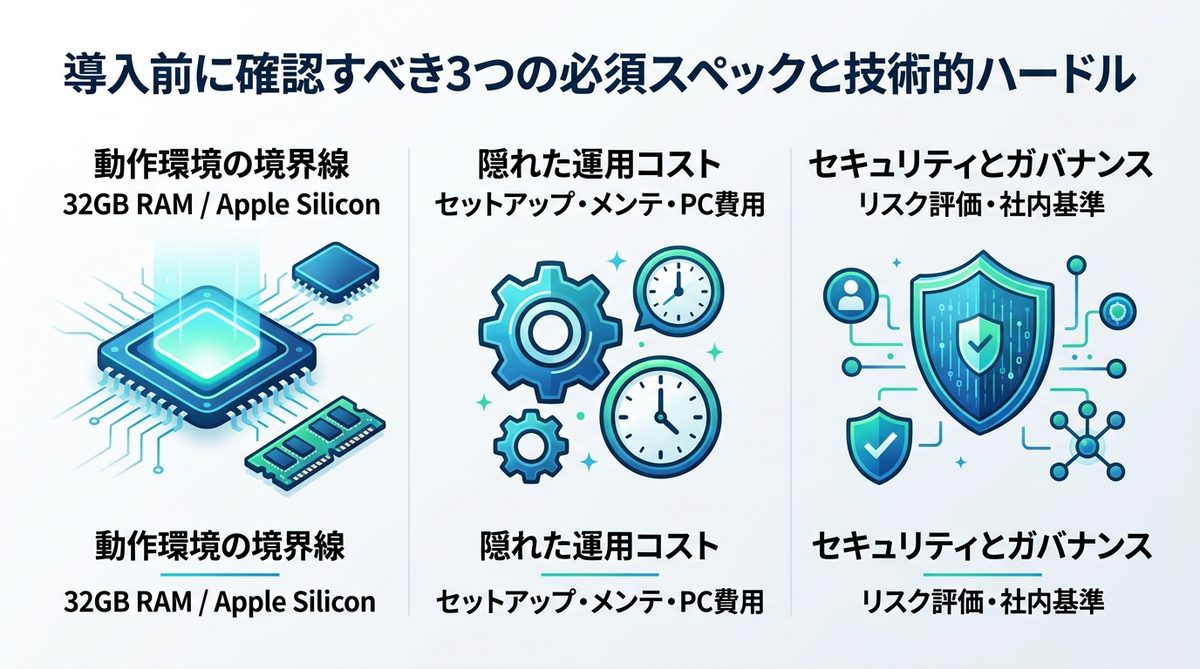

【環境構築】導入前に確認すべき3つの必須スペックと技術的ハードル

ローカル環境での運用には、クラウド利用時とは全く異なるリソース管理が求められます。

Appleシリコン・32GB RAMが「快適な動作」の境界線である理由

ローカルLLMは、PCのCPUとメモリ(RAM)を直接消費します。Claude Codeがコードを解析し、ファイルを操作する際、モデルの推論を高速に行うには最低でも32GB以上のメモリが推奨されます。16GB以下の環境では、コードベース(ソースコードの全体像)を読み込むだけでPCがフリーズしたり、推論時間が極端に遅延したりするケースが頻発します。

エンジニア工数を見積もる:環境構築とメンテナンスのランニングコスト

ローカル環境は「無料」ではありません。以下の「隠れコスト」を算出する必要があります。

- セットアップ工数: エミュレーション設定、モデルの選定・導入、Docker環境との連携作業。

- メンテナンス工数: モデルのアップデート、ツール側のバージョン追従、エラー発生時の原因切り分け。

- PCスペック費用: チーム全員にハイエンドPCを配布する場合の調達コスト。

セキュリティポリシーの壁:ローカル完結=安全と言い切れないリスクの評価

「ローカル=外部送信なし=完全安全」と安易に考えるのは危険です。使用するモデルが適切に管理されていない場合や、PC自体がマルウェアに感染している場合、ローカル環境こそが情報の漏洩源となります。社内ネットワークの隔離基準や、モデルのライセンス、データ保持ポリシーと照らし合わせるガバナンスが必要です。

関連記事:【2026年4月版】OpenClawのセキュリティリスクとは?急増するRCE脆弱性と企業が守るべき境界線

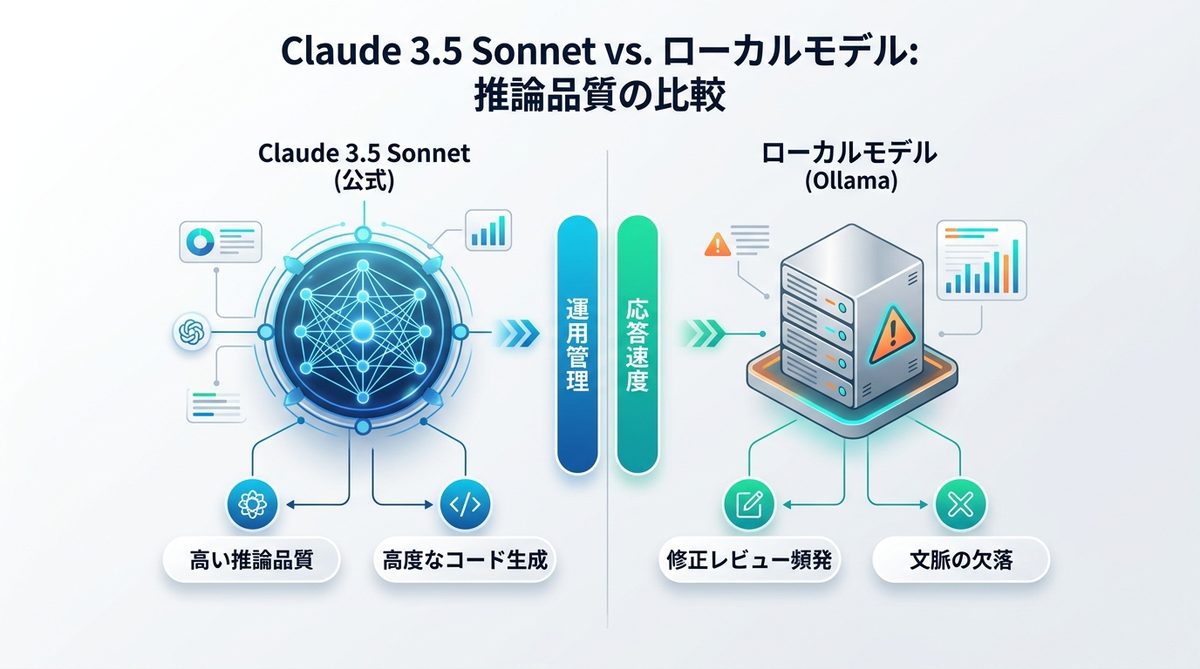

実務で使える?Claude 3.5 Sonnetとローカルモデルの「推論品質」の差

最も重要なのは「成果物の品質」です。結論から言えば、現時点のローカルモデルでClaude 3.5 Sonnetの性能を完全に代替するのは困難です。

なぜ「コード生成の精度」で苦戦するのか

Claude 3.5 Sonnetはコード理解と論理的推論において業界最高峰の性能を誇ります。これに対し、一般的なオープンソースのローカルモデルは、特定のプログラミング言語に対する専門性や、複雑な指示への追従性において劣ることが多く、ハルシネーション(AIによるもっともらしい嘘)の発生頻度が高まります。

複雑なリファクタリングで発生する「文脈の欠落」問題

コードベース全体を俯瞰したリファクタリング(プログラムの内部構造を整理すること)には、非常に長いコンテキスト(記憶容量)が必要です。ローカルモデルは、コンテキストが長くなるにつれて情報の想起能力が急速に低下する傾向があり、途中で指示を忘れたり、矛盾したコードを生成したりします。

修正レビューコストの増大

以下の表は、公式API環境とローカル環境を比較した際の実務上の懸念点です。

| 評価項目 | Claude 3.5 Sonnet (公式) | ローカルモデル (Ollama) |

|---|---|---|

| 推論品質 | 極めて高い | モデル依存(中程度) |

| 修正レビュー | ほぼ不要 | 頻繁に発生 |

| 応答速度 | ネットワーク依存 | PC性能に依存 |

| 運用管理 | 不要(SaaS) | 必須(エンジニア工数) |

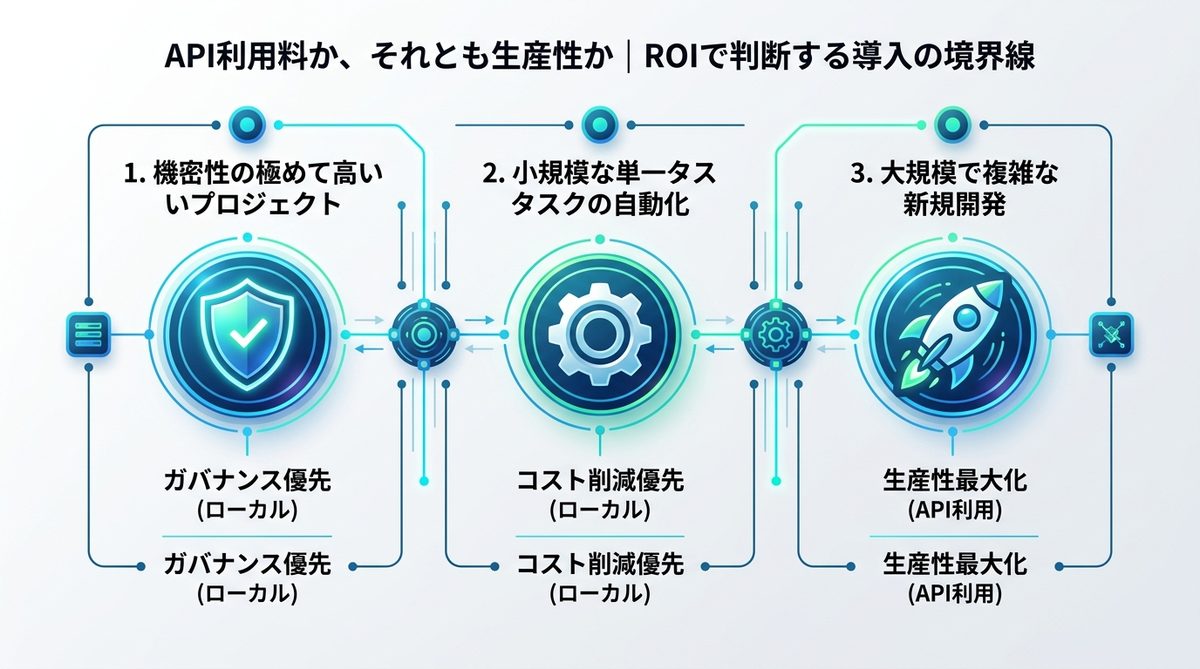

API利用料か、それとも生産性か|ROIで判断する導入の境界線

トータルコストを最適化するために、以下の3つのパターンで導入の是非を判断してください。

- 機密性の極めて高いプロジェクト: 外部へのデータ送信が絶対に許されない場合、コストや性能を犠牲にしてでもローカルモデルを導入する「ガバナンス優先」の選択が正当化されます。

- 小規模な単一タスクの自動化: プロンプトが単純で、モデルの性能差が結果に直結しない場合は、ローカル運用でコスト削減を狙うのが賢明です。

- 大規模で複雑な新規開発: 開発速度と品質が利益に直結するプロジェクトでは、公式APIのコストを払ってでも「生産性」を最大化する方が、結果としてROIが高くなります。

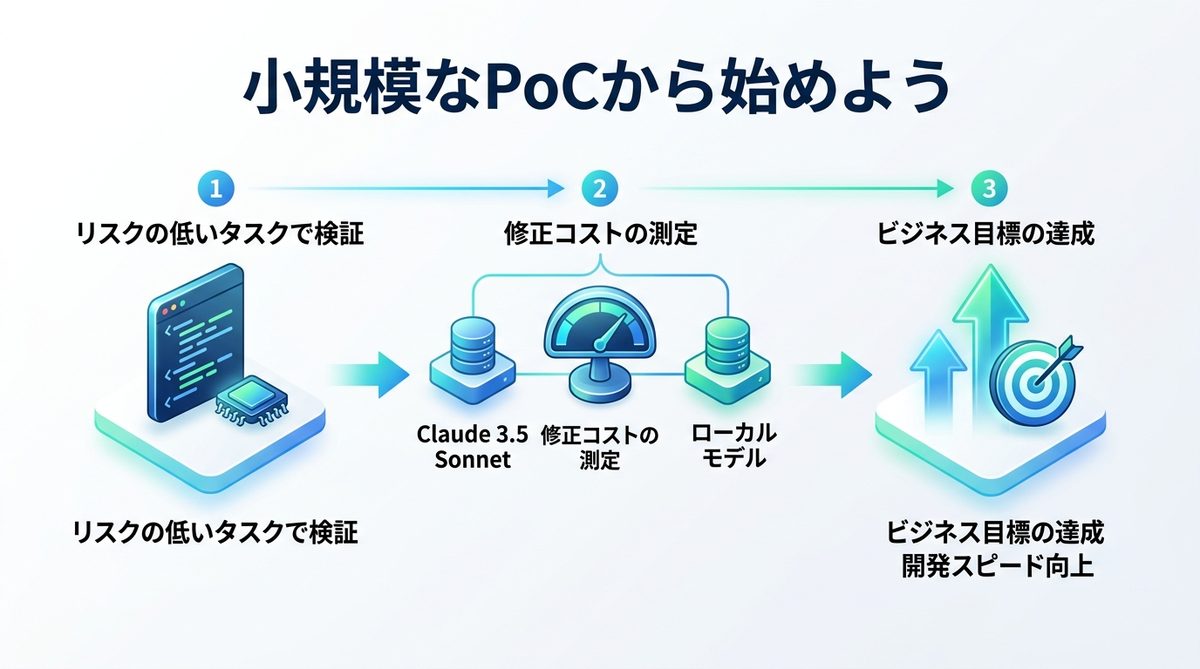

【結論】まずは小規模なPoC(概念実証)から始めよう

いきなり全社導入は厳禁:特定のタスクで性能を試す手順

まずは、非基幹システムや簡単なスクリプト作成など、リスクの低いタスクでPoC(概念実証)を実施してください。実際の業務コードを読み込ませ、Claude 3.5 Sonnetが出した結果と、ローカルモデルが出した結果を比較し、「修正コスト」を定量的に測定することが重要です。

ビジネス目標達成のために「手段」を最適化する考え方

AIエージェントの導入は目的ではなく、あくまで手段です。API利用料をケチった結果、エンジニアのレビュー工数が増大し、開発スピードが停滞しては本末転倒です。自社のビジネス目標を達成するために、どちらの環境が適しているかを冷静に見極めましょう。

関連記事:【2026年最新・総まとめ】AIエージェントとは?仕組み・種類・主要ツール・活用事例を徹底解説

まとめ

Claude Codeのローカル運用は、特定の制限環境においては強力な選択肢となりますが、公式API環境の「代わり」として完璧なものではありません。

- 仕組み: OllamaによるAPIエミュレーションだが、公式サポート対象外である。

- 前提: Appleシリコン・32GB RAMのPC環境が必須スペックとなる。

- 課題: 性能低下によるレビューコスト増加が、API費用以上の「隠れコスト」になり得る。

- 判断: セキュリティリスクと性能要件を天秤にかけ、まずは小規模なPoCでROIを検証する。

まずは、貴社の開発プロジェクトにおいて「API費用」と「修正コスト」のどちらが経営上の重石になっているかを確認し、最適な運用スタイルを選択してみてください。