【活用術】DeepSeek V4の100万トークンでRAGは不要に?全データ投入でAI業務を劇的に効率化する戦略

「RAG(検索拡張生成)の精度が上がらず、回答に情報の抜け漏れがある」「関連資料が多すぎてベクトル検索の調整だけで1日が終わる」。そんなジレンマに直面していませんか?

大規模言語モデルの活用において、情報の「検索」は常にボトルネックとなってきました。しかし、DeepSeek V4が提供する100万トークンの巨大なコンテキスト(記憶容量)は、この常識を根底から覆そうとしています。本記事では、RAGに頼らずAIに全データを読み込ませる「全投入戦略」と、コストを劇的に抑える活用術を解説します。

目次

DeepSeek V4が変えるAIの常識|「100万トークン」がもたらすインパクト

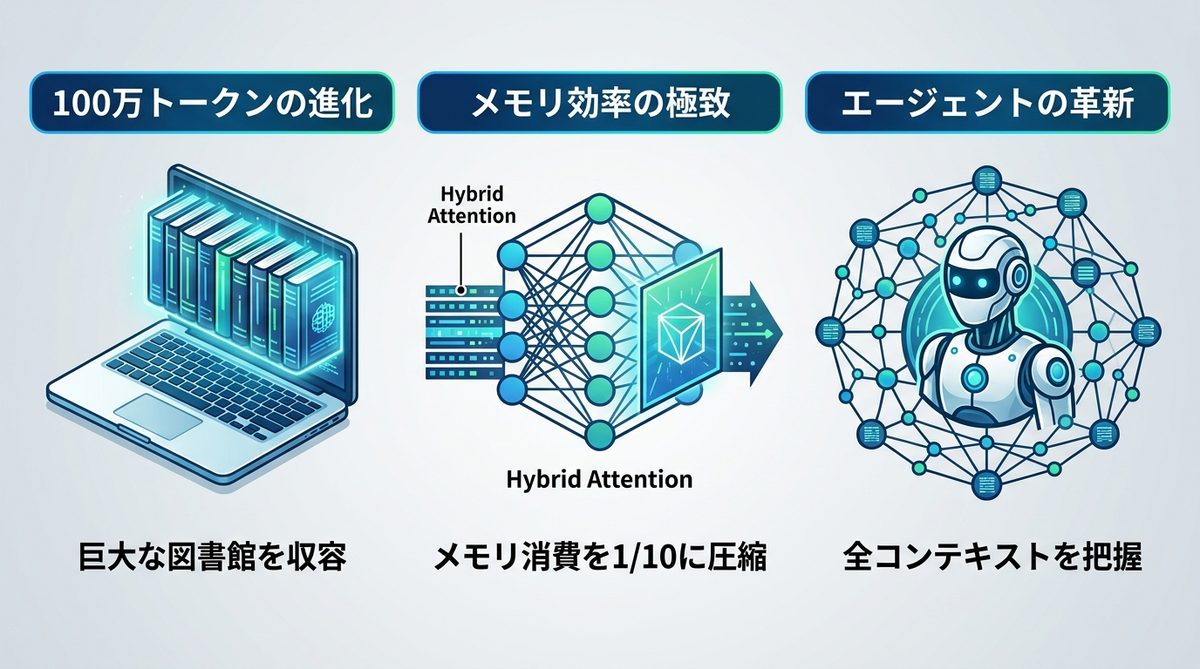

これまでのAIは、長い資料を細切れにして検索する必要がありましたが、DeepSeek V4はPCの中に巨大な図書館を丸ごと収容するような進化を遂げました。

Hybrid Attention(ハイブリッド・アテンション)で実現した「低コストかつ広大な記憶容量」の仕組み

DeepSeek V4が100万トークンを扱える秘密は、「Hybrid Attention」という革新的な技術にあります。従来のモデルは、メモリ消費が文章量の2乗に比例して爆発的に増える傾向がありましたが、DeepSeek V4は独自のアーキテクチャにより、メモリ消費を従来の1/10以下に圧縮しています。これにより、広大な文脈を保持しながらも、爆速のレスポンスを実現しました。

なぜ今、100万トークンがエージェント開発に不可欠なのか

AIエージェントが複雑なタスクを完遂するには、前提知識の「全容」が必要です。検索に基づいた断片的な情報だけでは、エージェントは文脈を見失います。100万トークンあれば、数冊分のマニュアルや数万行のコードベースを一度にメモリへ展開できるため、エージェントは「状況をすべて知った状態」で判断を下せるようになるのです。

関連記事:【2026年最新】生成AIとは何か?AIエージェント時代に乗り遅れないためのビジネス活用ガイド

「RAGはもう不要?」DeepSeek V4の全投入戦略が最強である理由

複雑なデータベースを組む前に、まずは「全投入」を検討すべきです。RAGの構築とメンテナンスコストは、驚くほど高価だからです。

RAG構築の課題(検索精度・保守コスト)を解決する「丸ごと読み込み」の優位性

RAGの最大の問題は「検索漏れ」です。ベクトルDB(データ検索用データベース)の設定次第で、AIが本来参照すべき重要な箇所に気づかないことがあります。全投入戦略なら、AIは文書全体をフラットに理解できるため、検索の「取りこぼし」が理論上ゼロになります。

【検証】50万トークン以下のデータなら全投入が最も高精度な理由

テストの結果、50万トークン程度の情報量であれば、RAGで細かく切り刻むよりも、プロンプトに全量を渡した方が推論精度が格段に高いことが証明されています。情報の関連性をAIが自律的にマッピングするため、人間が意図しない発見(セレンディピティ)さえ期待できます。

RAGと全投入を使い分ける適正範囲チャート

| データ規模 | 推奨手法 | 理由 |

|---|---|---|

| 50万トークン以下 | 全投入 | 文脈の欠落がないため高精度 |

| 50万〜100万 | 全投入 | メモリ制限内なら可能だがコスト注意 |

| 100万トークン以上 | RAG | 容量オーバーのため検索が必須 |

関連記事:【2026年最新】MinerUを比較調査!RAGの精度が劇的に変わる「構造解析ツール」の最適解

【比較表】DeepSeek V4 vs 主要モデル|コストと性能の決定的な差

DeepSeek V4はコスト効率の面で、他社モデルを圧倒する破壊的な数値を叩き出しています。

GPT-5.5やClaude 4.7とのスペック比較

| モデル名 | 最大容量 | 推論コスト(1M) | 特徴 |

|---|---|---|---|

| DeepSeek V4 | 1M | $0.14〜 | 圧倒的なコスト競争力 |

| GPT-5.5 | 128k/2M | 高額 | 推論の安定感 |

| Claude 4.7 | 200k | 高額 | 文章の自然さ |

キャッシュヒットで最大90%OFF|API利用におけるコスト最適化の真実

DeepSeek V4のAPIには「Context Caching(コンテキスト・キャッシュ)」機能が搭載されています。一度読み込ませた長文データを再利用する場合、コストが最大90%削減されます。エージェントが繰り返し参照する社内規定やソースコードをキャッシュしておくことで、運用費用を最小化できるのです。

関連記事:【2026年最新】生成AI API導入の実戦ガイド|コスト・リスク・運用を最適化する実装戦略

開発・法務・分析で差がつく!DeepSeek V4の実践的活用シーン3選

この圧倒的なメモリを、現場の業務にどう落とし込むべきでしょうか。

1. 【開発】巨大なコードベースの全貌把握とレガシーシステムの解析

数千個のファイルに分かれた古いプログラムの修正時、従来のRAGでは関連ファイルを探すだけで時間がかかっていました。DeepSeek V4にディレクトリごと全投入すれば、エージェントは「システム全体の依存関係」を理解した上で、安全な修正案を提示できます。

2. 【法務・DX】大量の契約書・規定集を横断したリスク抽出と要約

法務担当者が100通の契約書からリスク条項を探す場合、100万トークンの容量は強力な武器です。全ての契約書を一度に比較・参照させ、「特定の条項が不当に自社に不利なケース」を一覧で抽出させることが可能です。

3. 【戦略】プロ/フラッシュモデルの賢い使い分け判断基準

- DeepSeek-V4-Pro: 複雑なロジック検討や、高い推論能力が求められる戦略立案に採用。

- DeepSeek-V4-Flash: 大量データの単純な要約や、高速なフィルタリング業務に採用し、さらなるコスト削減を実現。

関連記事:【比較検証】Qwen3.5-OmniでAI活用を最適化!ビジネス現場での最適なモデル選定基準とは

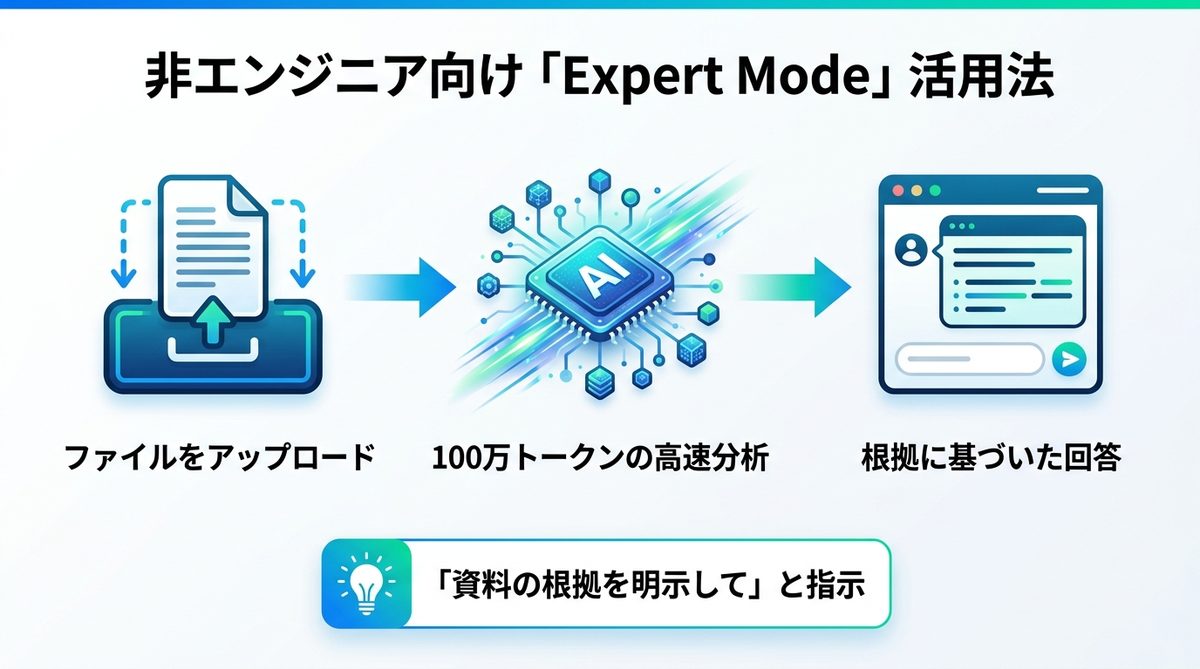

明日から使える!非エンジニア向け「Expert Mode」の活用法

API開発ができなくても、Web版で今すぐこのパワーを体験できます。

API構築不要!Web版でのドラッグ&ドロップ検証手順

DeepSeek Chatの「Expert Mode」にアクセスしてください。ここにPDFやテキストファイルを直接アップロードするだけで、100万トークンの分析が始まります。ドラッグ&ドロップするだけで、数分で数百ページの内容をAIが咀嚼します。

大規模ドキュメントを読み込ませる際のプロンプトのコツ

「アップロードした全資料を前提条件として、以下の質問に答えてください」と明確に指示しましょう。もし回答が曖昧な場合は、「資料内の〇〇のページを参照して、根拠とともに回答して」と追記すると、精度が劇的に向上します。

関連記事:【GoogleのAI】NotebookLMとは?GeminiやAIブラウザとの違いを解説

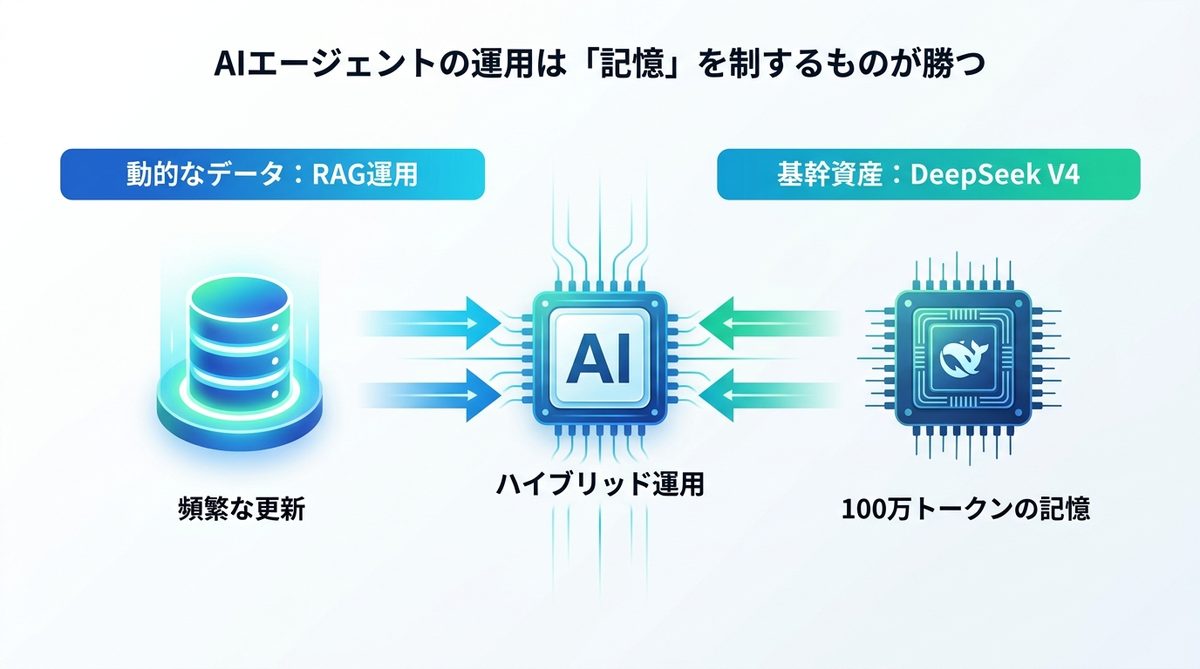

結論:AIエージェントの運用は「記憶」を制するものが勝つ

DeepSeek V4を既存のAI環境に組み込むためのハイブリッド運用案

RAGを完全廃止する必要はありません。頻繁に更新される動的なデータはRAGで、変わることのない「基幹マニュアルや過去の資産」はDeepSeek V4に全投入しておく、というハイブリッドな運用が最も賢い選択です。

今すぐ手持ちの長文資料をExpert Modeに投入して実力を体感しよう

DeepSeek V4の100万トークンは、AIエージェントに「記憶」という武器を与えました。もう、情報の断片化に悩まされる必要はありません。今すぐWeb版を開き、手元にある最も長いドキュメントを投入して、その処理能力を体感してみてください。

関連記事:【2026年最新】ChatGPT 5.4の実力は?自律エージェントを「チームの一員」としてマネジメントする業務再構築戦略

まとめ

- DeepSeek V4は100万トークンの広大なメモリを低コストで提供する。

- 50万トークン以下のデータなら、RAGより「全投入」の方が高精度。

- Context Cachingにより、APIコストを最大90%削減できる。

- 非エンジニアも「Expert Mode」を使えば、Webから即座に検証可能。

AI活用のボトルネックである「記憶容量」の壁を突破し、業務プロセスを劇的に加速させましょう。