源内(GENAI)とは?ベンダーロックインを回避するAI内製化の道

社内のDX推進を任されているものの、生成AIをいかに実務へ組み込み、具体的な成果に繋げるべきかとお悩みではありませんか?そのような課題を解決し、セキュアかつ効率的なAI活用を実現するのが、エンタープライズ向けプラットフォーム「源内(GENAI)」です。本記事では源内(Genai)の概要から4つのコンポーネント、導入要件まで解説します。

この記事に対する編集部の見解

- ChatGPTのような「契約して使う」ではなく、エンジニアが構築する「自社AI基盤」の設計図

- 特定ベンダーへの依存を断ち、AWS・Azure・GCPとLLMを状況で切り替えられる柔軟性が強み

- 民間大企業より地方自治体・省庁向きで、民間活用はAI製品を内製したいテック系企業に限定的

目次

源内(Genai)とは?

行政向けに開発されたOSS基盤

「源内(Genai)」は、デジタル庁が政府職員約18万人の利用を想定して開発した生成AI基盤のソースコードを、民間企業や地方自治体でも活用できるようオープンソースソフトウェア(OSS)として公開したものです。

SaaSとは異なる「テンプレート型」の位置づけ

2026年4月24日にMITライセンスで公開されたこの基盤は、単なるチャットツールではなく、組織が独自のAI環境を構築・運用するための「高度なテンプレート群」といえます。源内は、ChatGPTやClaudeのような「契約すればすぐにブラウザで使えるSaaS」ではないため、導入・運用には、Node.jsやPython、クラウドインフラ(AWS/Azure/GCP)の高度な知識を持つエンジニアリソースが不可欠です。

行政水準のセキュリティを民間へ

しかし、そのハードルを越えるだけの価値が源内にはあります。政府機関の厳しいセキュリティ要件をクリアした設計思想をそのまま自社の基盤として転用できるため、機密情報の保護と高度なカスタマイズ性を両立させたい中規模以上の企業にとって、AI戦略の核となるポテンシャルを秘めています。

デジタル庁が「源内」をOSS化した背景と目的

デジタル庁が開発した「源内」がOSS化された背景には、日本の公的機関および民間企業における「AI主権」の確保という大きな狙いがあります。

行政実務での実績を民間へ開放

もともと源内は、中央省庁の職員が日々の業務で安全に生成AIを活用するために設計されました。行政文書の検索や法制度の照会など、高い信頼性が求められる業務に耐えうる設計がなされています。これをOSSとして公開することで、地方自治体での導入コストを下げると同時に、民間企業が「行政水準のセキュリティ」を低コストで実装できる環境を整えたのです。

ベンダーロックインの回避

特定のAIベンダーや特定のクラウドサービスに過度に依存することは、将来的なコスト増やサービス終了のリスク(ベンダーロックイン)を伴います。源内はマルチクラウド(AWS、Azure、GCP)に対応しており、GPT-4o、Claude Sonnet 4.6、Gemini 2.5 Flashといった最新のLLMを柔軟に切り替えて利用できる設計になっています。これにより、企業は常に最適なモデルを選択できる「柔軟性」を手にすることができます。

MITライセンスによる自由な商用利用

源内はMITライセンスで提供されています。これは、著作権表示さえ行えば、改変や再配布、さらには商用利用が無償で認められる非常に自由度の高いライセンスです。自社専用の社内AI基盤として構築するだけでなく、自社が提供するBtoBプロダクトの裏側にあるAIエンジンとして源内を組み込み、顧客へ提供することも可能です。

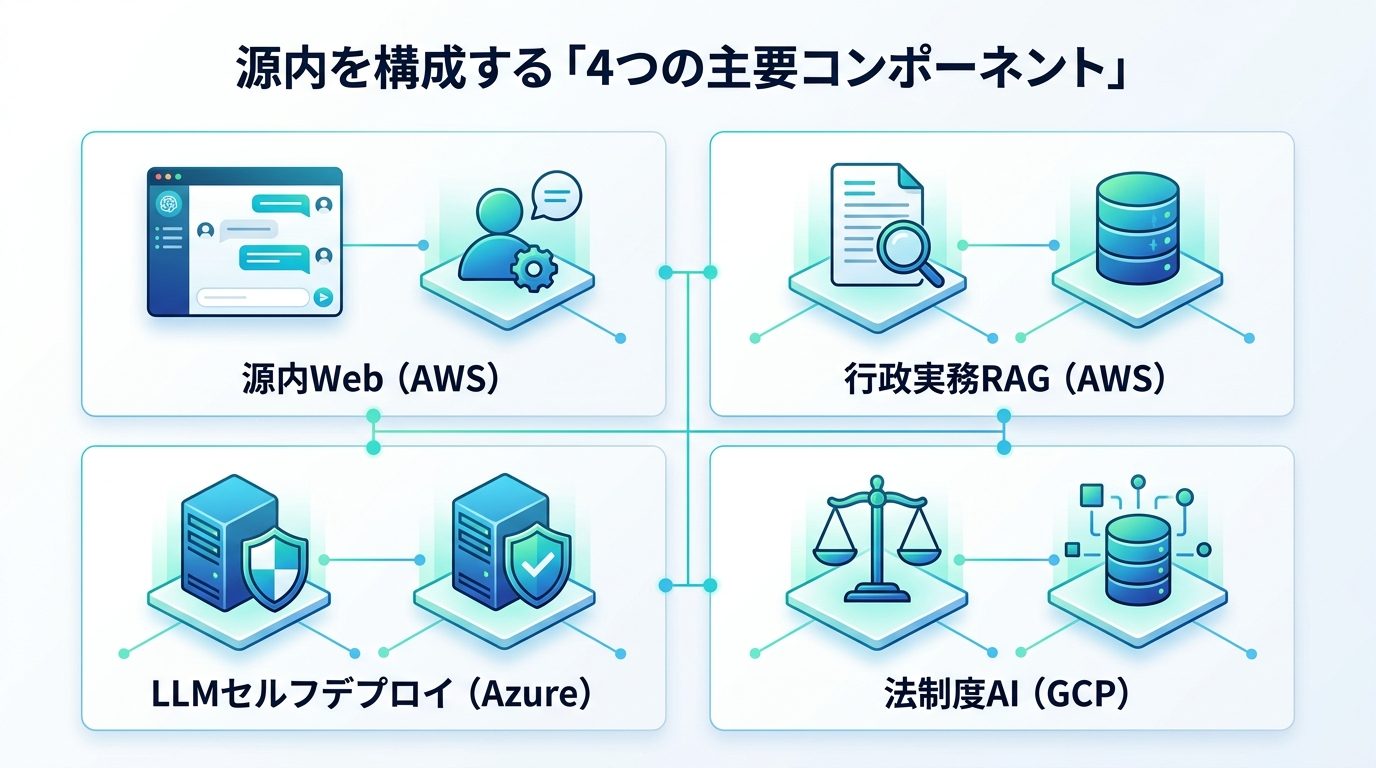

源内を構成する「4つの主要コンポーネント」の詳細

源内は、その機能ごとに4つのコンポーネントに分かれて構成されています。エンジニアリングチームは、これらを自社の目的に合わせて組み合わせてデプロイすることになります。

1. 源内Web(AWS環境)

「源内Web」は、ユーザーが直接触れるチャットインターフェースと、管理者が利用するガバナンス機能を提供します。

主な機能は、ユーザー認証、会話履歴の保存、そして利用ログの管理です。特に法人利用において、誰が・いつ・どのようなプロンプトを入力したかをログとして記録することは、コンプライアンスの観点から必須となります。AWS上に構築されるこのコンポーネントは、スケーラビリティに優れ、数千人規模の同時利用にも耐えうる設計がなされています。

2. 行政実務RAG(AWS環境)

生成AIの最大の弱点である「ハルシネーション(もっともらしい嘘)」を防ぐための仕組みがRAG(検索拡張生成)です。「行政実務RAG」は、自社が保有する膨大な業務マニュアルや規程集、過去の議事録などのドキュメントをAIに読み込ませ、それに基づいた回答を行わせるためのテンプレートです。

AWSのベクトルデータベースを活用し、精度の高い情報検索を実現します。これにより、単なる汎用AIではなく「自社の業務に精通したAI」を構築することが可能になります。

3. LLMセルフデプロイ(Azure環境)

セキュリティポリシー上、パブリックなAPI経由でデータを出したくない、あるいは特定のリージョン内でデータを完結させたい場合に重宝するのが「LLMセルフデプロイ」です。

Microsoft Azure環境を活用し、独自にLLMをデプロイするためのテンプレートを提供します。これにより、エンタープライズレベルの強固なセキュリティ境界の中でAIモデルを運用でき、機密性の高い研究開発データや個人情報を扱う業務へのAI適用が可能になります。

4. 法制度AI(GCP環境)

「法制度AI」は、e-Govなどの法令データや公的な参照情報を効率的に検索・参照するためのRAGアプリケーションです。Google Cloud Platform(GCP)のデータ処理能力を活かし、複雑な法制度データを構造的に理解するための仕組みが組み込まれています。

民間企業においても、法務部門でのリーガルチェックの補助や、コンプライアンス確認の一次回答エンジンとして転用できる強力なコンポーネントです。

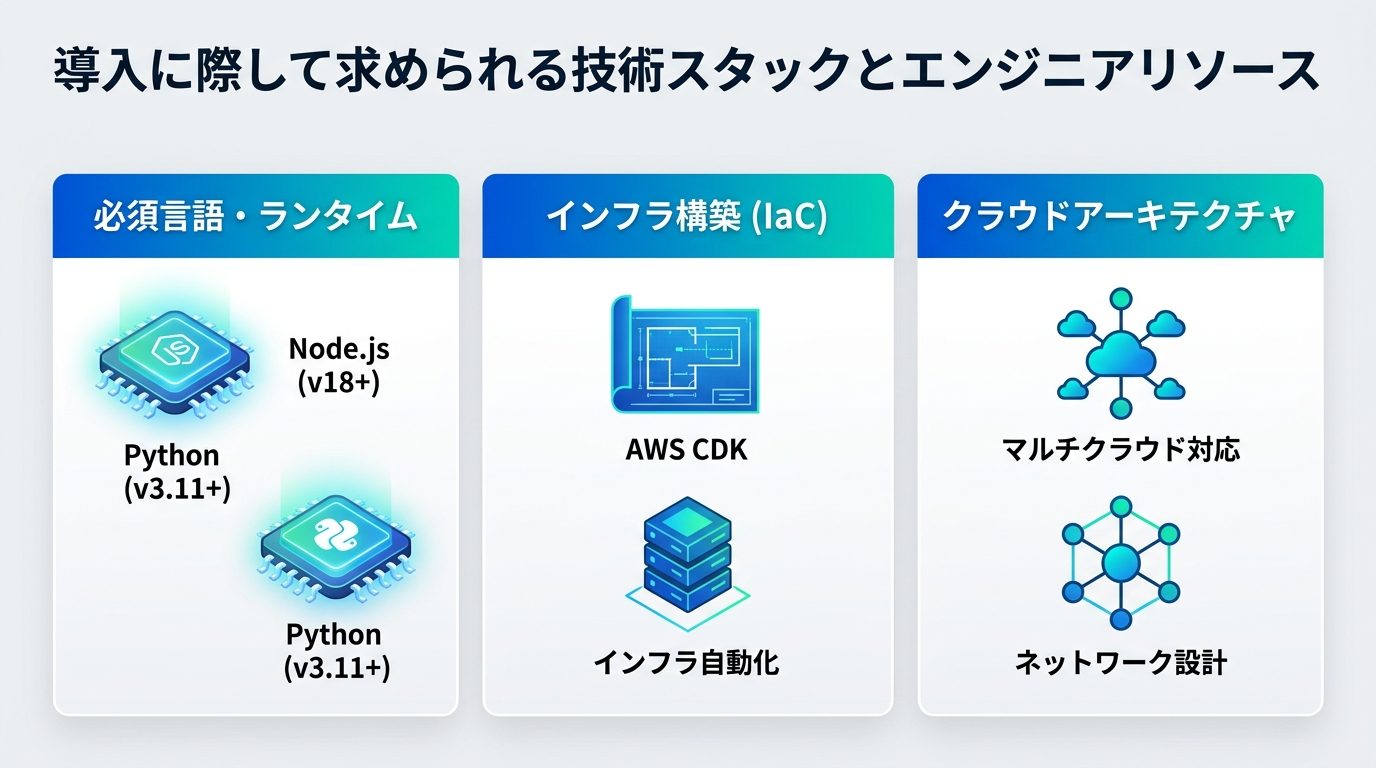

導入に際して求められる技術スタックとエンジニアリソース

冒頭で述べた通り、源内は「完成された製品」ではなく、あくまで「ソースコード」です。導入を成功させるためには、以下の技術スキルを持つエンジニアで構成されたチームが必要です。

必須となるプログラミング言語とランタイム

源内のバックエンドおよびフロントエンドは、モダンな開発環境を前提としています。

* Node.js(バージョン18以上): WebフロントエンドおよびAPIサーバーの動作に必要です。

* Python(バージョン3.11以上): RAGのロジックやデータ処理、LLMとの連携部分で多用されます。

これらの言語に精通し、非同期処理やライブラリの依存関係を適切に管理できるスキルが求められます。

インフラ構築スキル(AWS CDK)

源内のデプロイには、Infrastructure as Code(IaC)ツールである「AWS CDK」が採用されています。手動でコンソールを操作して構築するのではなく、コードによってインフラを定義し、自動展開する手法です。

そのため、AWSの各種サービス(ECS, Lambda, S3, DynamoDB, RDS等)の知識に加え、CDKを用いたデプロイパイプラインの構築経験があるインフラエンジニア、あるいはDevOpsエンジニアの存在が不可欠です。

クラウド・マルチクラウドの知識

源内はAWSを中心に設計されていますが、コンポーネントによってはAzureやGCPの利用も想定されています。自社の既存インフラがどこにあるか、ネットワーク構成(VPCや専用線接続)をどう設計するかといった、クラウドアーキテクチャ全体の設計能力が問われます。

源内を活用することで得られる戦略的メリット

エンジニアリソースを投入してまで源内を導入するメリットは、単なる「無料のAI」を手に入れること以上の価値があります。

行政水準のセキュリティ設計の継承

デジタル庁が開発したシステムであるため、アクセスコントロール、データの暗号化、ログの監査といったセキュリティ要件が、最初から高い水準で設計に組み込まれています。一から自社でこれほどの堅牢なシステムを設計・実装しようとすれば、膨大な工数とセキュリティコンサルティング費用がかかります。源内をベースにすることで、この「設計の安全性」をショートカットして手に入れることができます。

運用コストの最適化

SaaS型のAIサービスは、ユーザー数に応じた月額課金が一般的です。数千人規模の企業では、毎月多額のライセンス料が発生します。

源内はOSSであるため、ソフトウェアライセンス料は無料です。発生するのはクラウドのインフラ利用料と、LLMのAPI使用料(トークン課金)のみです。また、利用頻度の低い時間帯のインスタンスを停止させるなど、自社でインフラをコントロールすることで、運用コストを劇的に最適化できる可能性があります。

プロダクトへの組み込みと独自進化

MITライセンスの特性を活かし、源内の機能を自社のSaaSプロダクトの一部として組み込むことができます。例えば、顧客向けFAQシステムに源内のRAG機能を統合し、自社製品のドキュメントを学習させたAIチャットボットを提供するといった展開が考えられます。

また、ソースコードが手元にあるため、特定の業務フローに特化した独自のカスタマイズ(例:社内のワークフローシステムとのAPI連携)も自由自在です。

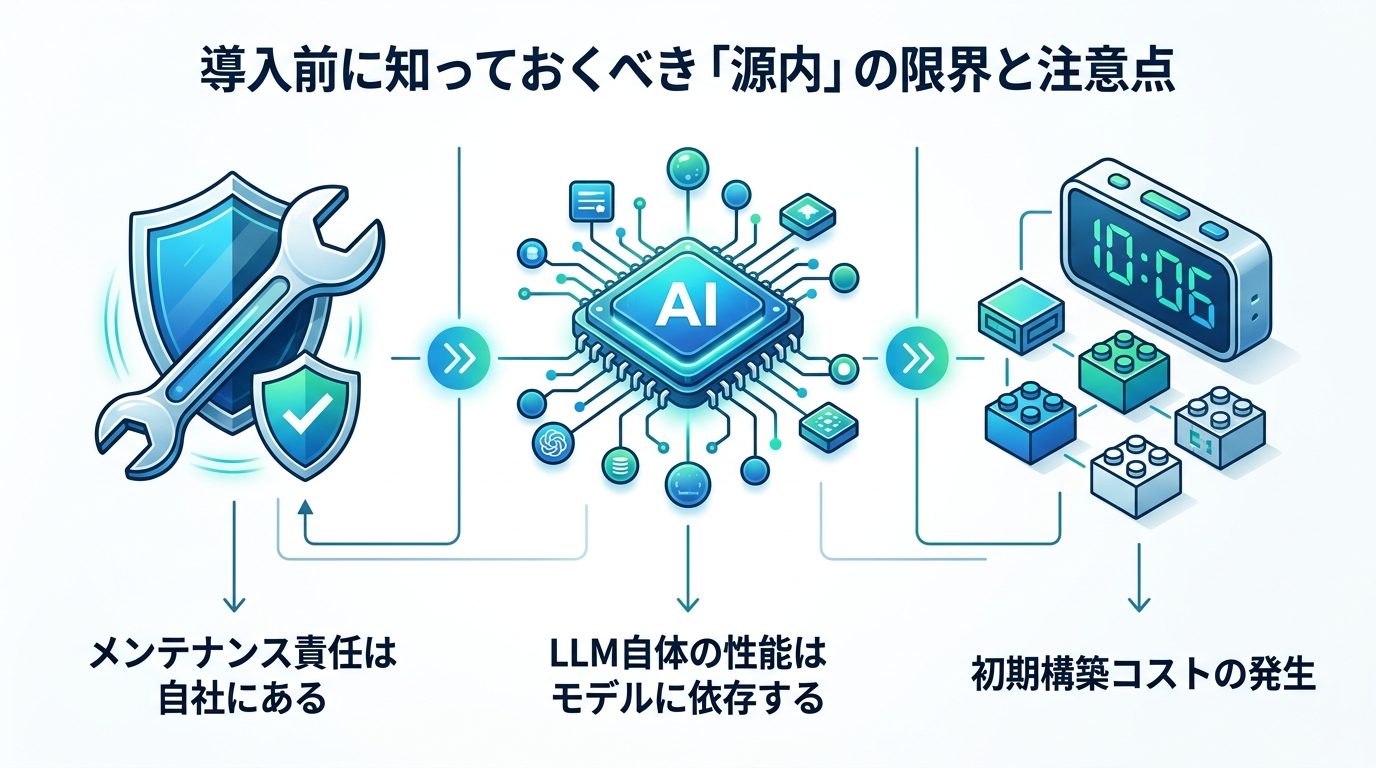

導入前に知っておくべき「源内」の限界と注意点

源内は強力なツールですが、万能ではありません。導入を決定する前に、以下の現実を理解しておく必要があります。

メンテナンス責任は自社にある

OSSである以上、バグの修正やセキュリティパッチの適用、LLMのバージョンアップへの対応はすべて自社のエンジニアが行う必要があります。デジタル庁が将来的にソースコードをアップデートする可能性はありますが、自社の環境に適用する際の整合性チェックは自社の責任となります。

LLM自体の性能はモデルに依存する

源内はあくまで「基盤(枠組み)」です。AIの賢さそのものは、接続するLLM(GPT-4oやClaude等)に依存します。源内を導入したからといって、AIの回答精度が魔法のように上がるわけではありません。適切なプロンプトエンジニアリングや、RAGに投入するデータのクレンジングといった地道な作業は引き続き必要です。

初期構築コストの発生

ライセンス料は無料ですが、エンジニアの工数という形での「初期投資」は確実に発生します。環境構築、認証基盤との連携、社内データのインポートなど、実運用に乗せるまでには数ヶ月単位のプロジェクト期間を見込むべきでしょう。

「源内」の導入に向いている組織・向いていない組織

源内の特性を踏まえ、導入を検討すべき組織と、避けるべき組織を明確にします。

向いている組織

- 自社に開発チームを抱える中大規模企業: インフラからアプリケーションまで自社でコントロールしたい組織。

- 高いセキュリティ要件が求められる業種: 金融、製造、医療、公共など、データの所在や処理プロセスを厳格に管理したい組織。

- AIを自社プロダクトの核に据えたい企業: 独自のAI機能を安価かつ迅速に開発・提供したいスタートアップやSaaSベンダー。

- マルチクラウド戦略を推進している組織: 特定のベンダーに依存せず、状況に応じて最適なクラウドやLLMを使い分けたい組織。

向いていない組織

- エンジニアリソースが不足している組織: 設定やトラブルシューティングを外部のベンダーに丸投げしたい場合、源内は不向きです。

- 「とりあえずAIを使ってみたい」程度の小規模組織: ChatGPT EnterpriseなどのSaaSを利用するほうが、トータルコストも導入スピードも優れています。

- IT投資を月額費用(OPEX)だけで完結させたい組織: 構築に伴う人件費や初期コスト(CAPEX)を許容できない場合は、SaaS型が適しています。

まとめ:源内は「AI主権」を握るための戦略的基盤

デジタル庁の「源内(GENAI)」は、行政水準の高度なセキュリティ設計をMITライセンスで低コストに転用できる、自社専用AI基盤の強力な土台です。導入にはエンジニアの専門知識と相応の工数を要しますが、プラットフォーマーに依存せず、AIを「消費」から「自社資産としての運用」へと転換させ、競合他社との差別化を生む源泉となります。

行政が作り上げたこの堅牢な「骨組み」に自社の知見を肉付けすることで、真に価値のあるAI活用が始まります。まずはエンジニアチームと共に、公開されている公式リポジトリの確認から始めてみてはいかがでしょうか。

AIエージェントナビ編集部の見解

AIエージェントナビでは、各記事のテーマについて編集長が「実際どうなの?」という素朴な疑問を「Nav」と名付けたAIエージェントにぶつけています。エンジニアではなく、経営者・ビジネス視点からの率直な見解をお届けします。

編集長の率直な感想

編集長

Nav

編集長

Nav

編集長

Nav

編集長

Nav

編集部のまとめ

- ChatGPTのような「契約して使う」ではなく、エンジニアが構築する「自社AI基盤」の設計図

- 特定ベンダーへの依存を断ち、AWS・Azure・GCPとLLMを状況で切り替えられる柔軟性が強み

- 民間大企業より地方自治体・省庁向きで、民間活用はAI製品を内製したいテック系企業に限定的