【2026年最新】OpenAI「Codex Security」の導入手順|GitHub連携から脅威モデル調整の秘訣まで

「また誤検知の山か…」と、既存のSAST(静的アプリケーションセキュリティテスト)ツールが吐き出す大量のアラートに頭を抱えていないでしょうか。実は、その終わりのないトリアージ作業は、AIエージェントの力で大幅に効率化できます。本記事では、OpenAIが2026年3月6日にリリースしたセキュリティ特化型エージェント「Codex Security」の基本概念から、現場で活用するための導入・運用フローを解説します。

目次

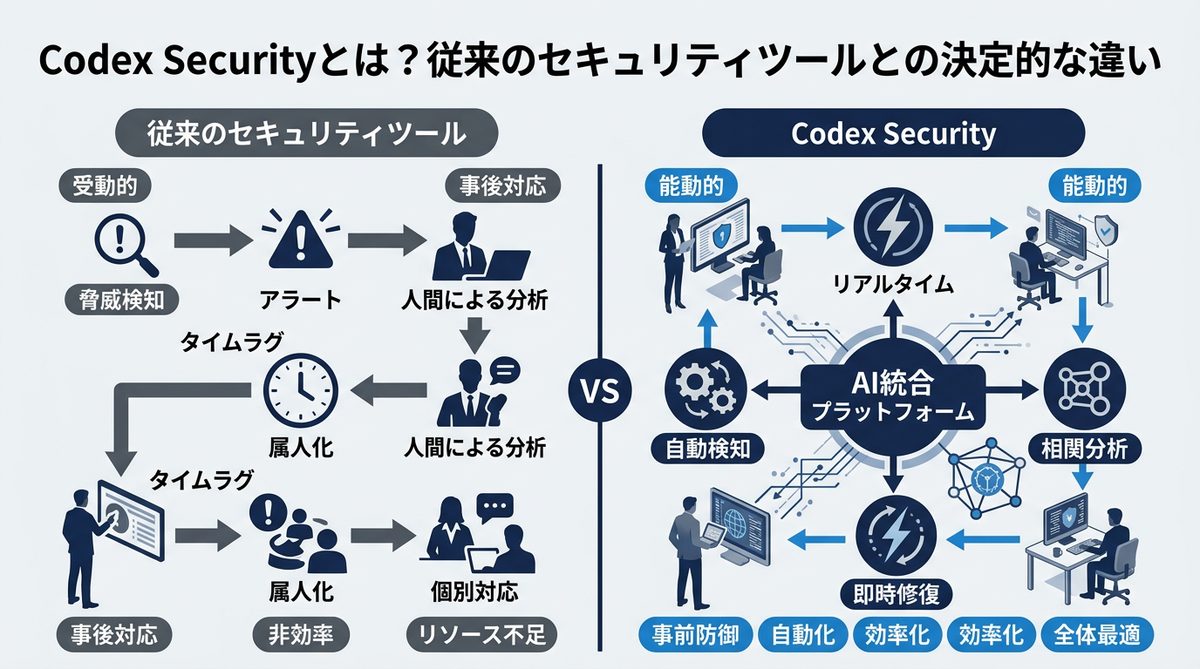

Codex Securityとは?従来のセキュリティツールとの決定的な違い

セキュリティツールは「導入して終わり」ではありません。むしろ、導入後の運用こそが最大の課題です。Codex Securityは、単なるスキャナーではなく、セキュリティ専門家の思考を模倣する「知的なパートナー」として設計されています。

静的解析の限界と「文脈理解」という解決策

従来のSASTツールは、決まったルール(パターンマッチング)に基づいてコードを検査します。これは例えるなら、「黒い服を着ている人間は全員怪しい」と決めつける検問所のようなものです。その結果、無害なコードまで大量に引っかかり、エンジニアは「ノイズ」の山から真の脅威を探すという不毛な作業を強いられてきました。

一方、Codex Securityは「文脈理解(Context Understanding)」を行います。リポジトリ全体の設計思想や、データの流れをAIが把握するため、「このコードは確かに危なそうに見えるが、前段でバリデーションを行っているため安全である」といった高度な判断が可能になるのです。

誤検知率84%削減を支える「サンドボックス検証」の仕組み

なぜCodex Securityは、従来のツールと比べて圧倒的な精度を誇るのでしょうか。その秘密は「サンドボックス(隔離された実行環境)検証」にあります。

- 仮説生成:AIが脆弱性の可能性を検知する。

- 自動テスト実行:そのコードを安全な隔離環境で実際に動かし、本当に攻撃が成立するかを検証する。

- 確信度の提示:実害が出たケースのみを「真の脅威」として報告する。

このプロセスにより、人間が一つひとつコードを読み解いて確認する時間を劇的に短縮します。実際の検証では、最大84%の誤検知削減という実績が出ており、アラート疲れを根本から解消します。

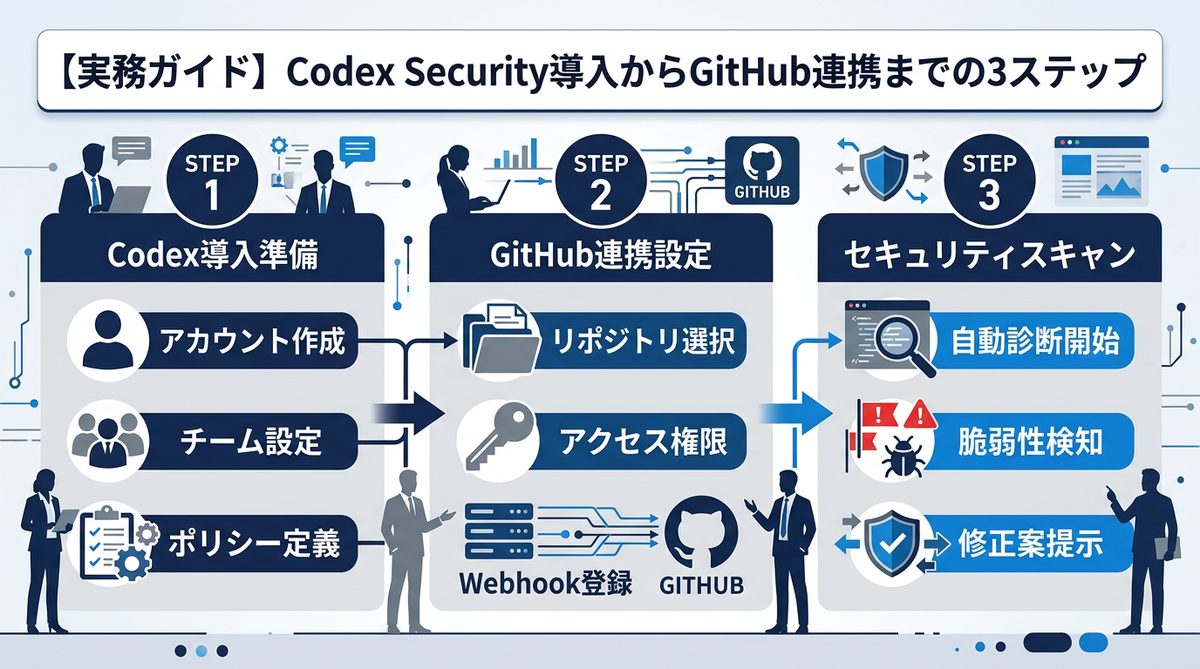

【実務ガイド】Codex Security導入からGitHub連携までの3ステップ

ここでは、Codex Securityを自社の開発ワークフローに組み込むための具体的なステップを紹介します。なお、本ツールは2026年3月現在、ChatGPT Pro, Enterprise, Business, Eduユーザー向けに「Codex web」経由で提供されています。

1. まずはここから!ChatGPTでのアクセス方法

Codex Securityを利用するには、まずChatGPTのインターフェースから「Codex web」へアクセスします。研究プレビュー版として公開されており、リリースから1ヶ月間は無料試用が可能です。まずは管理画面から自社のワークスペースと紐付けを行い、エージェントの権限を設定してください。

2. GitHubリポジトリ接続とスキャン実行

GitHubとの連携は非常にシンプルです。以下の手順で進めてください。

- 接続設定:Codex Securityの管理画面で「GitHubリポジトリを接続」を選択し、読み取り権限(Read Access)を許可します。

- 初回スキャン:対象のリポジトリを指定し「Analyze」ボタンをクリックします。

- 初動確認:AIがリポジトリの構造を読み込み、数分程度で最初の脆弱性レポートを生成します。

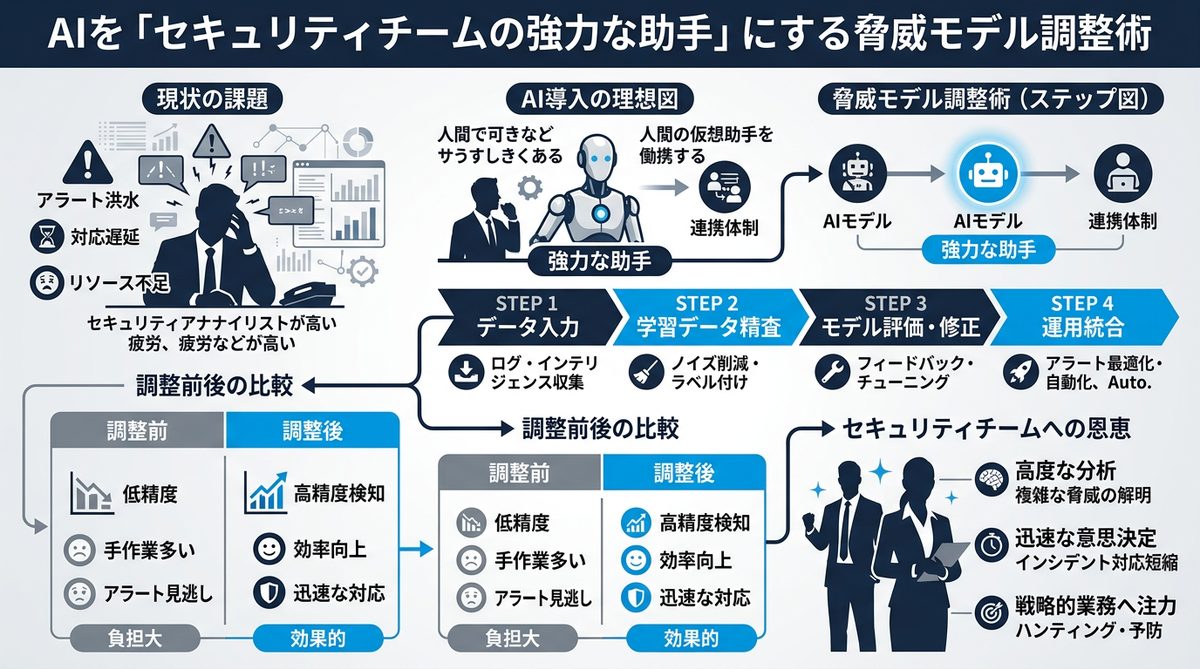

AIを「セキュリティチームの強力な助手」にする脅威モデル調整術

Codex Securityを最大限に活かす鍵は、AIが作成する「脅威モデル(Security Threat Model)」のチューニングにあります。

脅威モデルとは何か?

脅威モデルとは、「アプリケーションのどこが、どのような攻撃に対して脆弱であるか」を示した地図のようなものです。Codex Securityは、コードベース全体を脳内に取り込み、データフローや認証機構を可視化します。この地図があることで、AIは「どの脆弱性を優先的に塞ぐべきか」というビジネス上の文脈を理解できるようになります。

人間が介入すべき「重要度」と「露出度」のカスタマイズ

AIの提示する結果に対して、エンジニアが「これは許容範囲内」「これは重要」とフィードバックを行うことが重要です。この「人間による評価」を重ねることで、AIはあなたのチーム特有のアーキテクチャを学習し、使えば使うほど精度が向上するサイクルが完成します。

関連記事:【2026年最新・総まとめ】AIエージェントとは?仕組み・種類・主要ツール・活用事例を徹底解説

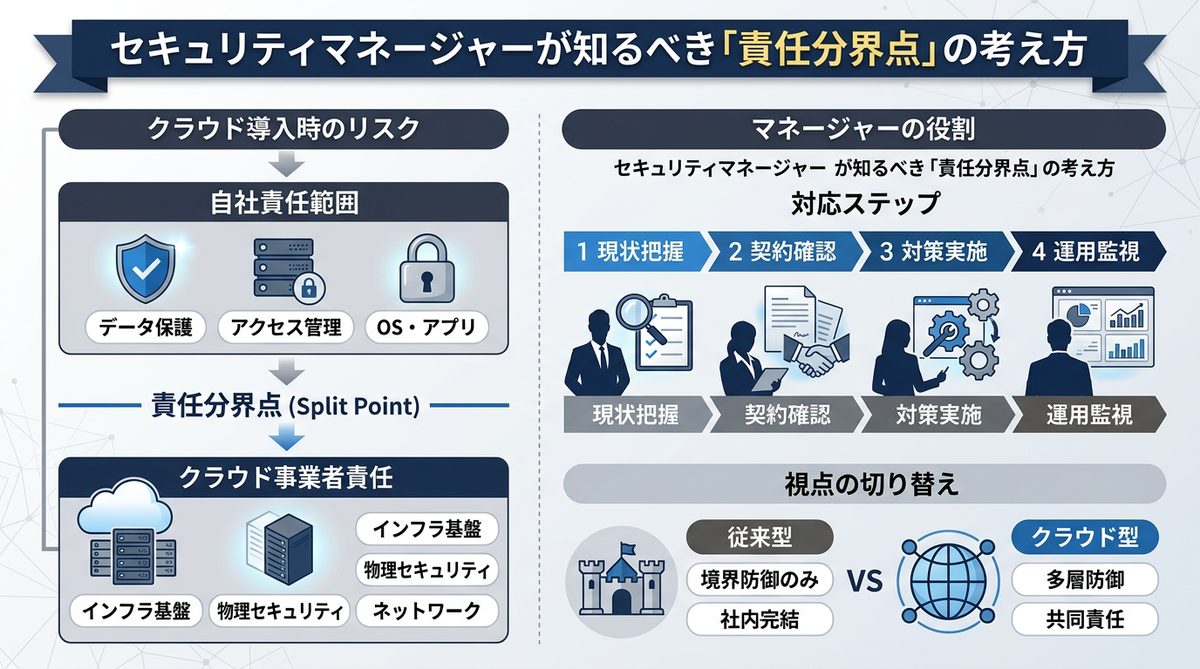

セキュリティマネージャーが知るべき「責任分界点」の考え方

AIにすべてを任せるべきではない、という不安はもっともです。ここでは、AIとの正しい付き合い方について解説します。

AIは補助輪であり「全自動」ではないという現実

Codex Securityは「人間によるレビューを高速化・高精度化するためのツール」です。パッチの提案自体はAIが行いますが、その適用を最終承認するのは人間であるべきです。AIを「判断を下す主体」ではなく「判断をサポートする優秀な助手」と定義することで、責任の所在を明確に保てます。

使い込むほど賢くなる!セキュリティ運用の未来

Codex Securityの導入効果を比較表にまとめました。

| 項目 | 従来型SAST | Codex Security |

|---|---|---|

| 解析手法 | パターンマッチング | 文脈理解+サンドボックス検証 |

| 誤検知 | 非常に多い | 大幅削減(最大84%減) |

| トリアージ負荷 | 膨大 | 最小限に抑制 |

| 運用の変化 | 疲弊の蓄積 | 学習による精度向上 |

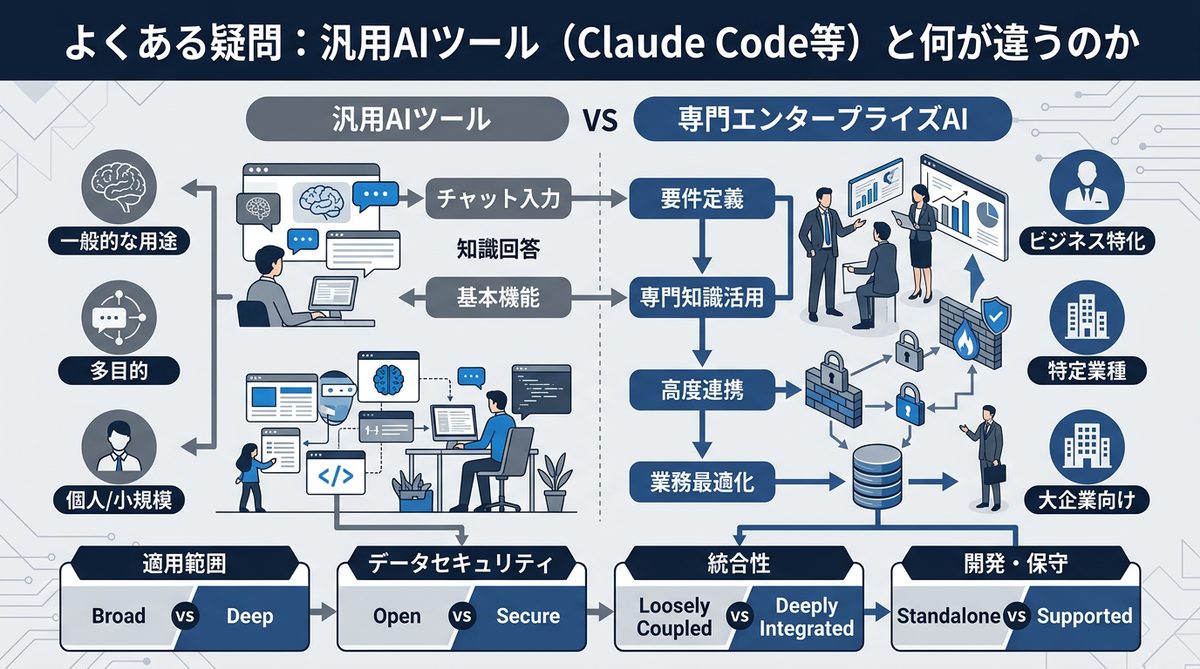

よくある疑問:汎用AIツール(Claude Code等)と何が違うのか

「Claude Codeで十分ではないか?」という質問をよく受けます。両者の違いは「目的の純度」にあります。

- 汎用AI(Claude Code等):コーディング全般をサポートする「万能型」。セキュリティ指摘は得意だが、トリアージ専門ではない。

- Codex Security:セキュリティ運用のトリアージ排除に特化した「専門型」。システム全体の整合性を考慮したパッチ提案を行うため、レグレッション(退行/バグの再発)リスクが抑えられています。

まとめ

Codex Securityは、現場のエンジニアを単調なトリアージ作業から解放し、本質的なアーキテクチャの改善に集中させるための強力なパートナーです。要点をまとめます。

- 圧倒的な誤検知削減:サンドボックス検証により、実害のないノイズを84%排除する。

- 文脈の理解:コード全体を俯瞰し、リポジトリ特有の設計に合わせたパッチを提案する。

- 人間との連携:AIが提案し、人間が承認する責任分界点を明確にすることで、安全性とスピードを両立する。

まずはGitHubリポジトリを試験的に接続し、AIが提示する「真の脅威」の可視化をぜひ体感してみてください。今すぐ最初の一歩を踏み出し、開発チームのセキュリティ運用を次のステージへ引き上げましょう。