【検証】Rakuten AI 3.0はなぜ選ばれるのか?導入コストと計算資源から見る「自社AI基盤」構築の現実

機密情報を扱う企業にとって、モデルを外部に委ねる既存のAPI利用は「データ主権」の観点で課題が残ります。Rakuten AI 3.0は、その壁を打破する強力な選択肢となるのか。本記事では、エンジニアが知るべきモデルの導入手順と、経営者が判断すべきインフラ構築の現実を解説します。

目次

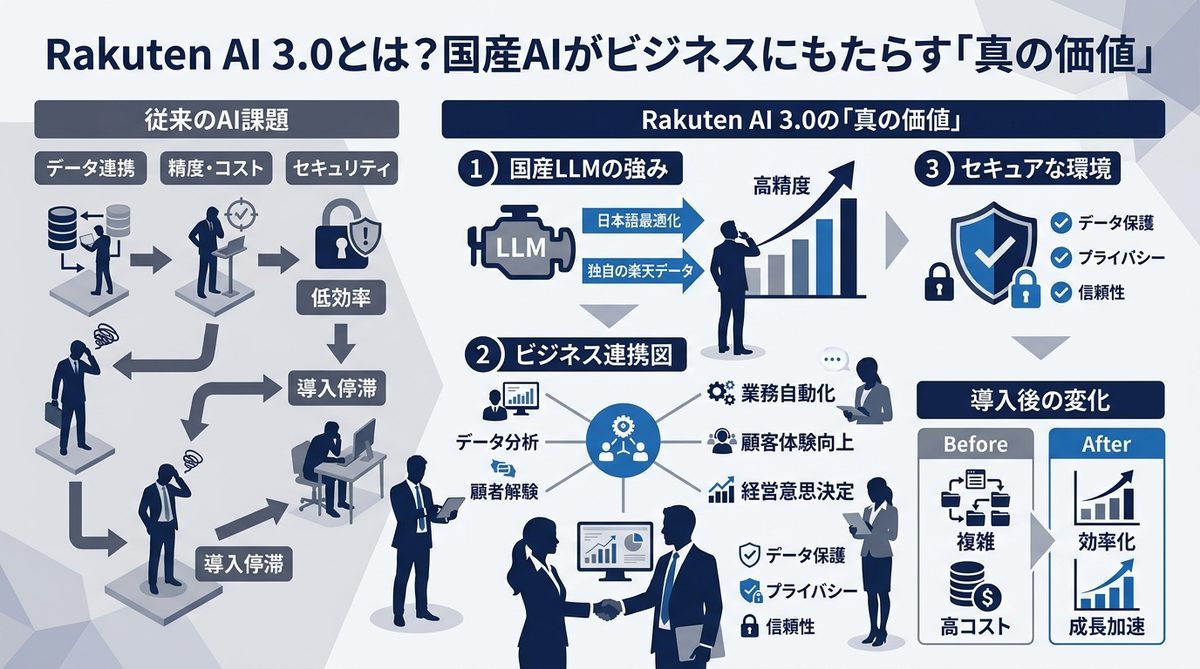

Rakuten AI 3.0とは?国産AIがビジネスにもたらす「真の価値」

Rakuten AI 3.0は、楽天グループがGENIACプロジェクトを通じて開発した、日本語能力に特化した大規模言語モデル(LLM)です。単なるチャットボットではなく、企業が自社の環境内に「頭脳」を埋め込むための基盤モデルとして設計されています。

7000億パラメータ×MoE技術が実現する圧倒的な日本語推論能力

Rakuten AI 3.0の最大の特徴は、7000億パラメータという圧倒的な規模と、MoE(Mixture of Experts:専門家混合)アーキテクチャの採用にあります。MoEとは、モデル全体を巨大な一つの塊として動かすのではなく、入力内容に応じて適切な「専門家(サブネットワーク)」だけを稼働させる仕組みです。これにより、膨大な知識量を保持しながらも、推論時の計算コストを抑えつつ高い回答精度を両立しています。PCの中に「あらゆる分野の専門家が待機している頭脳」を住まわせるようなもので、日本語特有の文脈やビジネス表現の理解において極めて高いパフォーマンスを発揮します。

なぜ「Apache 2.0」なのか?商用利用とデータ主権の決定的なメリット

本モデルはApache 2.0ライセンスで公開されています。これは「無償かつ商用利用可能」であり、モデルの改変や再配布も自由であることを意味します。既存の海外製APIは規約変更によって突然サービスが停止したり、入力データが学習に再利用されたりするリスクが拭えません。自社インフラにこのモデルを載せることで、データは一歩も社外に出ることなく完結します。データ主権を重んじる金融・医療・製造業にとって、これは極めて戦略的なメリットです。

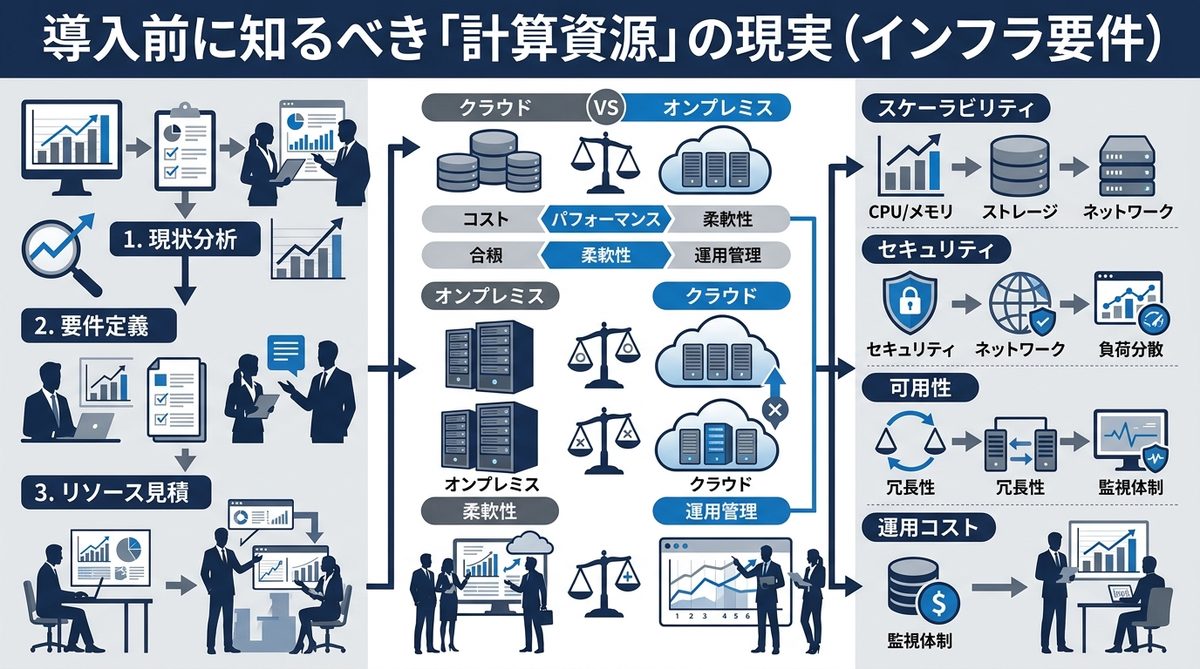

導入前に知るべき「計算資源」の現実(インフラ要件)

「モデルが無料」という言葉に惑わされてはいけません。Rakuten AI 3.0を動かすには、相応のインフラ構築能力が求められます。

7000億パラメータモデルを動かすためのGPU・VRAMの目安

7000億パラメータという規模は、一般的なPCでは到底動かせません。推論を実行するには、膨大なビデオメモリ(VRAM)が必要です。具体的には以下のスペックが最低ラインの目安となります。

- 必要なハードウェア: NVIDIA H100 または A100 GPU(80GBモデル)の複数台構成

- 必要構成: モデルの量子化(軽量化)を行っても、最低でも数百GBのVRAMを確保できるクラスター構築が必須

- サーバー負荷: 安定した推論速度(トークン生成速度)を維持するには、GPUの相互接続(NVLink等)を最適化した環境構築が不可欠です

クラウド・オンプレミスでの構築コストと運用費用の考え方

モデルの利用料は無料ですが、以下の運用費が恒常的に発生します。

| 項目 | 概算コスト・留意点 |

|---|---|

| GPUインスタンス代 | クラウドなら月額数百万〜数千万円単位の計算が必要 |

| 電気・冷却コスト | オンプレミスの場合、データセンターの維持費が直撃 |

| 保守運用エンジニア | モデルの更新・微調整(ファインチューニング)を行う専門職の雇用 |

モデルを無料で使える分、それらを動かす「巨大なエンジン」を維持するための投資が必要になる、という構造を理解しておく必要があります。

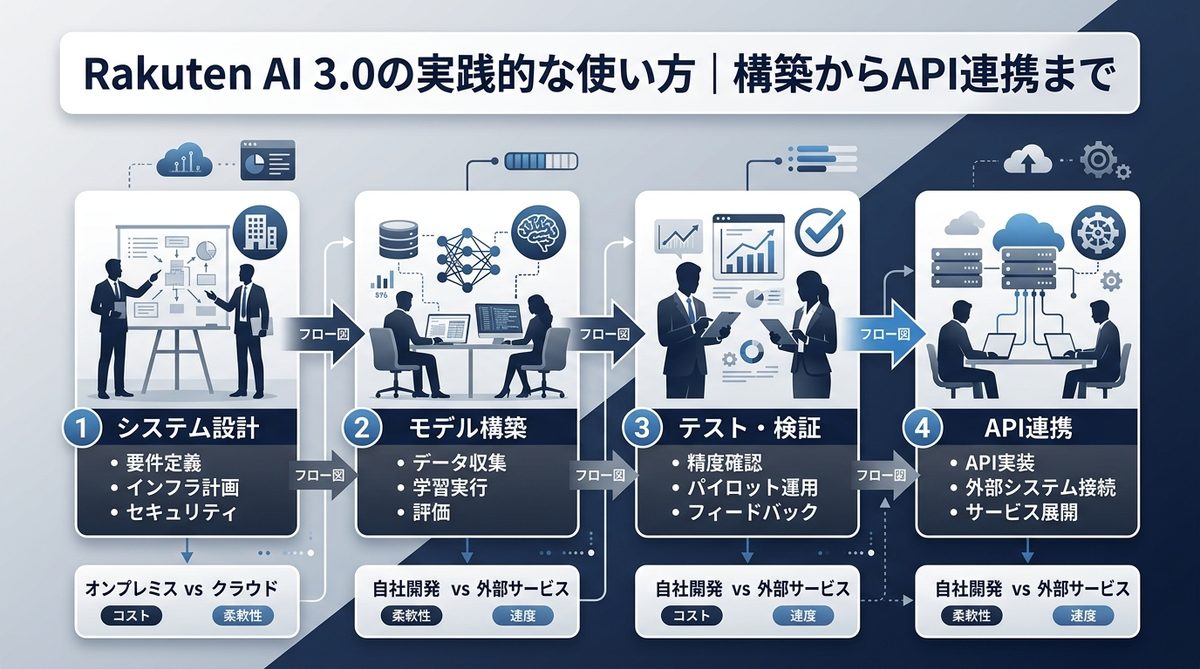

Rakuten AI 3.0の実践的な使い方|構築からAPI連携まで

ここでは、技術者がどのように導入を進めるべきかの流れを整理します。

Hugging Faceからのダウンロードとローカル環境のセットアップ

Rakuten AI 3.0はHugging Face(AIモデル共有プラットフォーム)から重みデータを入手可能です。導入の手順は以下の通りです。

- 環境構築: PyTorchやvLLM(高速推論ライブラリ)がインストールされたLinux環境を準備します。

- 重みの取得: Hugging Faceの公式リポジトリからモデルファイルをダウンロードします。

- 推論サーバーの立ち上げ: vLLM等の推論エンジンを用い、APIエンドポイントを構築します。

既存の社内システムへの組み込み方法

自前で構築したAPIエンドポイントは、既存の社内ツールから呼び出し可能です。LangChainなどのフレームワークを利用すれば、現在お使いの社内チャットツールや、AIエージェントプラットフォームと数行のコードで接続できます。外部APIではなく「社内ネットワーク内」のエンドポイントを指定するだけで、セキュアなAI環境が完成します。

関連記事:【2026年最新】ChatGPT 5.4の実力は?自律エージェントを「チームの一員」としてマネジメントする業務再構築戦略

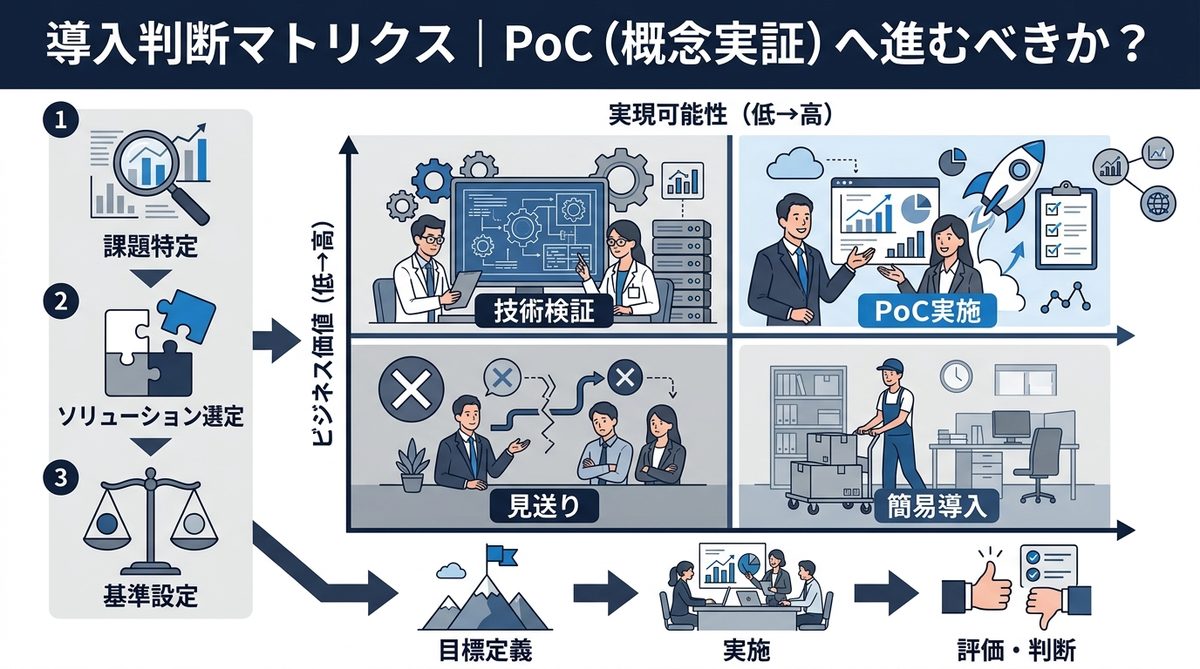

導入判断マトリクス|PoC(概念実証)へ進むべきか?

経営層が検討すべき導入判断の基準をまとめました。

既存の海外製LLMとRakuten AI 3.0の比較判断表

| 比較項目 | 海外製LLM (API利用) | Rakuten AI 3.0 (自社構築) |

|---|---|---|

| 導入ハードル | 極めて低い | 高い(インフラ知識必須) |

| 運用コスト | 利用量に応じた従量課金 | 固定のインフラ維持費 |

| データ主権 | 外部委託(リスク有) | 自社で完全制御(安全) |

| 性能 | 汎用的に高い | 日本語・特定ドメインで強み |

自社AI構築を成功させるための「チェックリスト」

- [ ] 自社内にGPUサーバーの構築・運用実績があるか

- [ ] 月額数百万円規模のインフラ予算を確保できるか

- [ ] セキュリティポリシー上、データを外部へ出すことが禁止されているか

- [ ] 専任のエンジニアチームが確保できているか

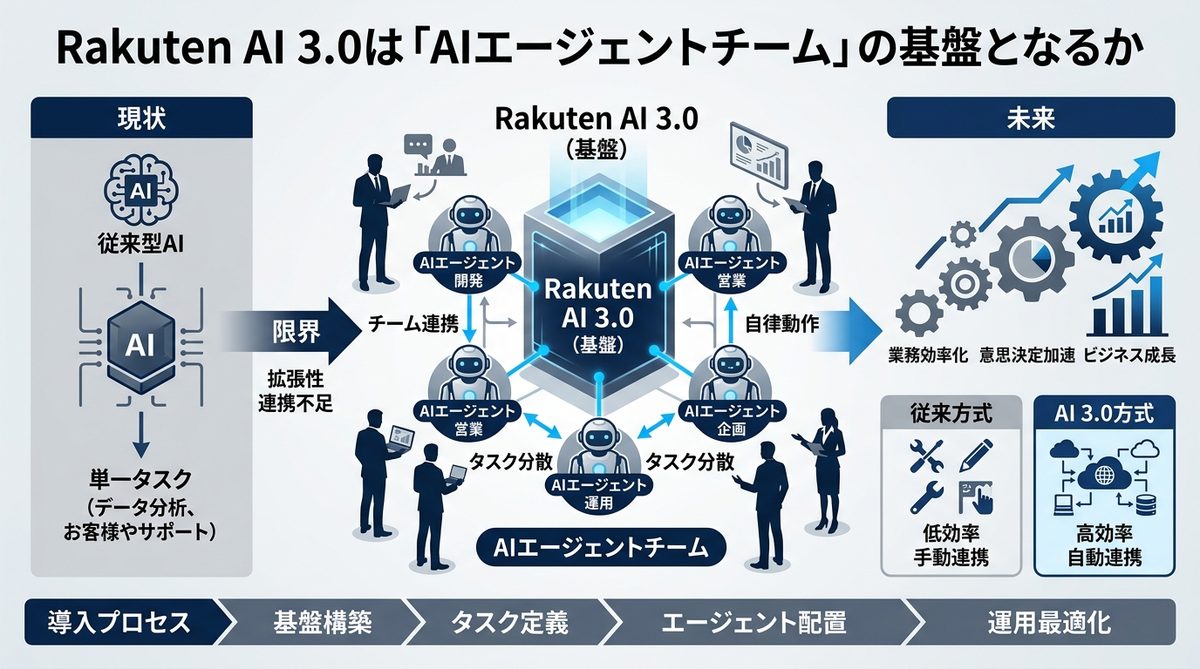

Rakuten AI 3.0は「AIエージェントチーム」の基盤となるか

頭脳(基盤モデル)としてのRakuten AI 3.0と、活用ツール(Claude Code等)の棲み分け

Rakuten AI 3.0を、すべてのAIエージェントツールと組み合わせる必要はありません。Rakuten AI 3.0は「機密情報を扱う推論エンジン」として中央に置き、社内のAIエージェント(Claude Codeなどのコーディングツールなど)に対してAPI経由で推論能力を提供する「プライベート基盤」として運用するのが理想的です。

まずは小規模PoCから開始する戦略のすすめ

いきなり全社導入を行うのではなく、まずは「特定の機密性の高いドキュメント検索」や「社内文書の要約」など、限定的な範囲でのPoCを開始してください。小規模な検証を通じて、自社のインフラでどれだけのレスポンスが得られるかを測定することが、投資対効果を見極める最短ルートです。

関連記事:【2026年最新】生成AIとは何か?AIエージェント時代に乗り遅れないためのビジネス活用ガイド

まとめ

Rakuten AI 3.0は、データ主権と高性能な日本語処理を両立したい企業にとって、最強の選択肢となり得る基盤モデルです。今回のポイントは以下の通りです。

- 高い日本語能力: 7000億パラメータ×MoE技術により、専門的なタスクも高精度に処理可能。

- データ主権の確保: Apache 2.0ライセンスにより、社内インフラでのクローズドな商用運用が可能。

- インフラ投資の覚悟: モデル利用料は無料だが、GPU環境の構築・運用コストが導入の鍵となる。

- スモールスタートの推奨: まずは限定的なPoCでインフラ性能を検証し、徐々に利用範囲を拡大しましょう。

まずは貴社のインフラ要件を整理し、小規模な検証環境の構築を始めてみてください。それが、データ主権を守りながら最先端のAIを使いこなす第一歩です。