【完全図解】OpenClawとGemma 4で実現するローカル完結型エージェントの導入手順

「毎月のAI API利用料が予算を圧迫している」「機密情報を含む業務を外部APIで処理することに抵抗がある」。AIエージェントの導入を検討する多くのビジネスリーダーが直面しているのが、このコストとセキュリティの両立という壁です。本記事では、この課題を解決する手段として、オープンソースの「OpenClaw」とGoogleの最新モデル「Gemma 4」を組み合わせた、ローカル完結型エージェントの構築方法を解説します。

目次

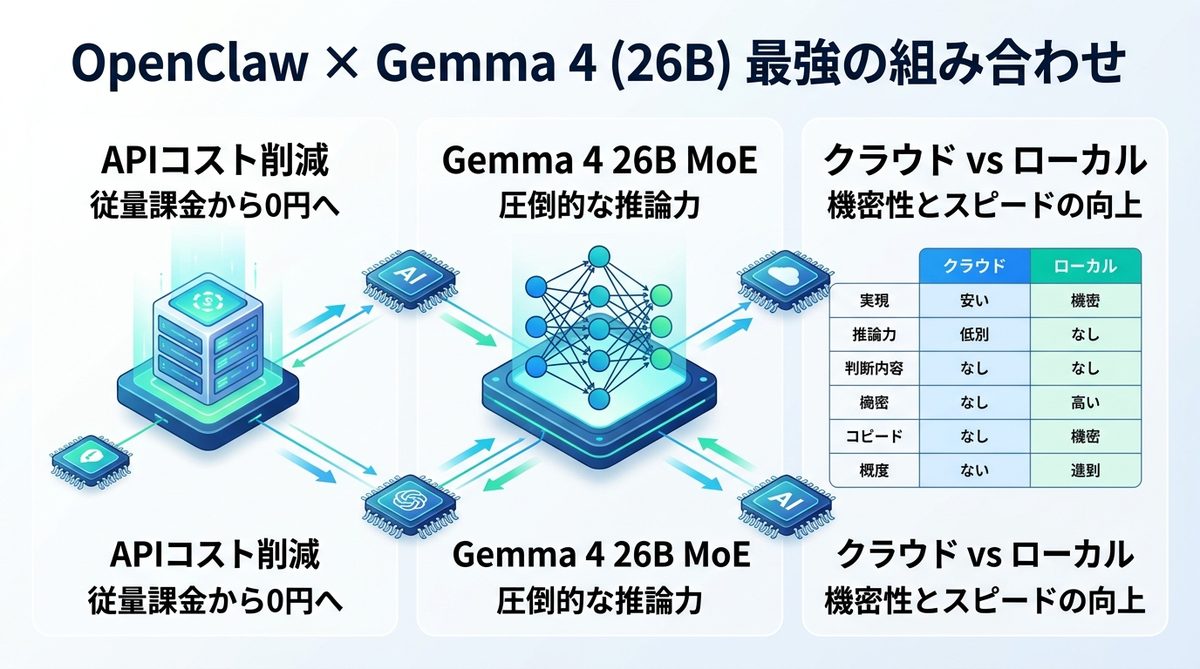

なぜ今「OpenClaw × Gemma 4 (26B)」が最強の組み合わせなのか

AIエージェントの活用が加速する中で、なぜわざわざローカル環境を構築するのか、その理由は明白です。API依存からの脱却と、自律的な判断能力の向上にあります。

APIコスト地獄からの脱却:ローカルLLM(大規模言語モデル)が選ばれる真の理由

クラウド型のAPIは便利ですが、リクエスト数が増えるほど「従量課金」という名の請求書が重くのしかかります。OpenClawとローカルLLMを組み合わせれば、一度環境を構築してしまえば、API利用料は実質0円です。サーバー代や電気代を考慮しても、月間で数万円〜数十万円のコスト削減が見込めます。

7Bモデルでは不可能だった「思考の深さ」:Gemma 4 26B MoEの衝撃

これまでローカル環境で手軽に動かせる「7B(70億パラメータ)」クラスのモデルは、簡単な対話には適していても、複雑な業務遂行には力不足でした。しかし、2026年4月にリリースされた「Gemma 4 26B MoE(混合専門家モデル)」は違います。

| 特徴 | 7B モデル | Gemma 4 26B MoE |

|---|---|---|

| 推論能力 | 基本的な指示のみ | 高度な論理的推論が可能 |

| 関数呼び出し | 低精度 | ネイティブ関数呼び出し対応 |

| 業務適性 | 単発タスク向け | 複数ステップの自律実行 |

Gemma 4 26Bは、必要な専門家(Expert)部分だけをアクティブに活用するMoEアーキテクチャを採用しており、軽量でありながらGPT-4クラスの推論精度を実現しています。

比較表で見る:OpenClawとローカル環境の圧倒的なコストパフォーマンス

| 比較項目 | クラウドAPI (Claude等) | OpenClaw × Gemma 4 |

|---|---|---|

| 実行コスト | 従量課金(変動) | 実質0円(固定) |

| データ機密性 | 外部送信あり | 完全ローカル完結 |

| 実行速度 | ネットワーク依存 | マシンスペック依存 |

| 構築難易度 | 低(すぐ使える) | 中(環境構築が必要) |

関連記事:【2026年最新】OpenClawとは?AIエージェントの仕組みと、安全に業務導入する「NemoClaw」活用ガイド

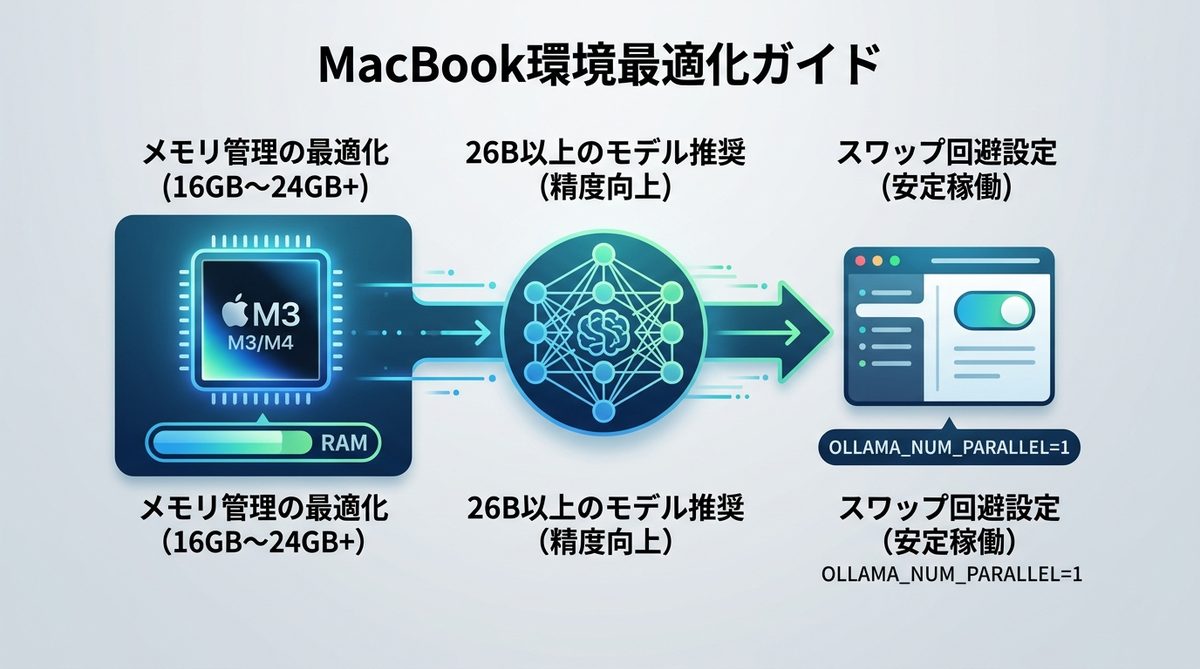

【事前準備】MacBookでOpenClawを快適に動かすための環境最適化

ローカルで26Bモデルを動かすには、一定のハードウェアリソースが必要です。特にメモリ(RAM)管理が勝負を分けます。

メモリ16GB〜24GBの壁を突破するOllamaのメモリ最適化Tips

Appleシリコン(M3/M4)を搭載したMacBookにおいて、メモリ16GBは最低ライン、24GB以上が推奨です。Ollama(ローカルLLM実行エンジン)を動かす際、他のアプリケーション(ブラウザやSlackなど)を閉じ、「Ollama serve」以外の不要なプロセスを停止することで、モデル専用のメモリ領域を最大化できます。

なぜ軽量モデル(2B/7B)では業務に支障が出るのか:スペック選定の重要性

2Bや7Bといった軽量モデルをエージェントに利用すると、指示を深く理解できず、作業のループ(無限回帰)や誤ったファイル操作を引き起こすリスクが高まります。自律エージェントには「文脈を理解する力」が不可欠であり、最低でも26B以上のモデルが、業務を完遂するための「判断力」を担保します。

スワップ地獄を回避し、エージェントを安定稼働させるための設定法

メモリが不足するとMacはストレージをメモリ代わりにする「スワップ」が発生し、エージェントの動作が極端に遅くなります。これを避けるには、Ollamaの設定ファイルでOLLAMA_NUM_PARALLELを「1」に固定し、並列処理を抑制してリソースを安定させましょう。

関連記事:【2026年版】ローカル生成AIの始め方|PCスペック判定表とおすすめソフト徹底解説

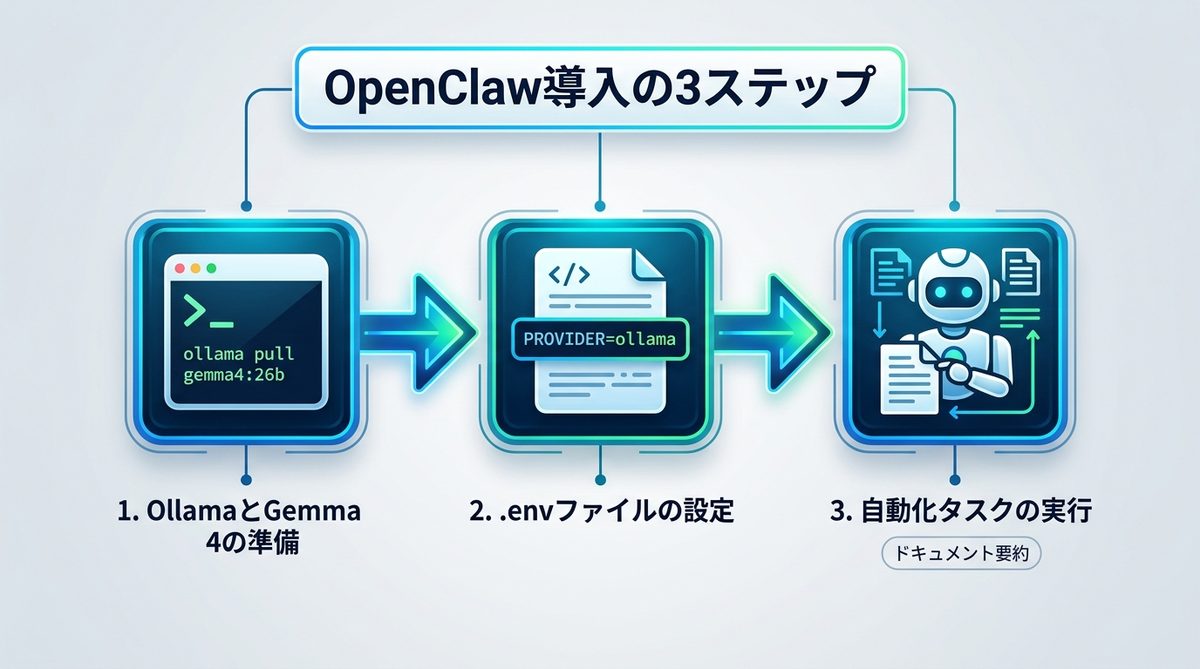

【導入手順】OpenClawをインストールしてGemma 4と接続する3ステップ

ここでは、ローカル環境でエージェントを動かすための最短の手順を解説します。

1. OllamaのインストールとGemma 4 26Bモデルのセットアップ

公式サイトからOllamaをダウンロードし、インストール後、ターミナルで以下のコマンドを実行してモデルをダウンロードします。

bash

ollama pull gemma4:26b

2. .envファイルによるプロバイダー接続

OpenClawの設定フォルダにある.envファイルを開き、以下の内容を追記・編集します。

プロバイダー設定

PROVIDER=ollama

MODEL=gemma4:26b

OLLAMA_BASE_URL=http://localhost:11434

3. 最初の一歩:自動化タスクを実行して動作を確認する方法

設定が完了したら、OpenClawを起動し、簡単なタスクを指示します。「ローカルディレクトリにあるドキュメントの内容を要約して、Markdown形式で保存して」と入力し、エージェントが自律的にフォルダを探索し、処理を完結できるかを確認してください。

関連記事:【経営戦略】Gemma 4を比較して分かった、データ主権を守りコストを最適化する「ローカルLLM」導入術

思考モードを使いこなせ!エージェントの推論精度を最大化するコツ

Gemma 4 26Bの真価を発揮させるには、「思考(Thinking)」をプロセスに組み込むことが重要です。

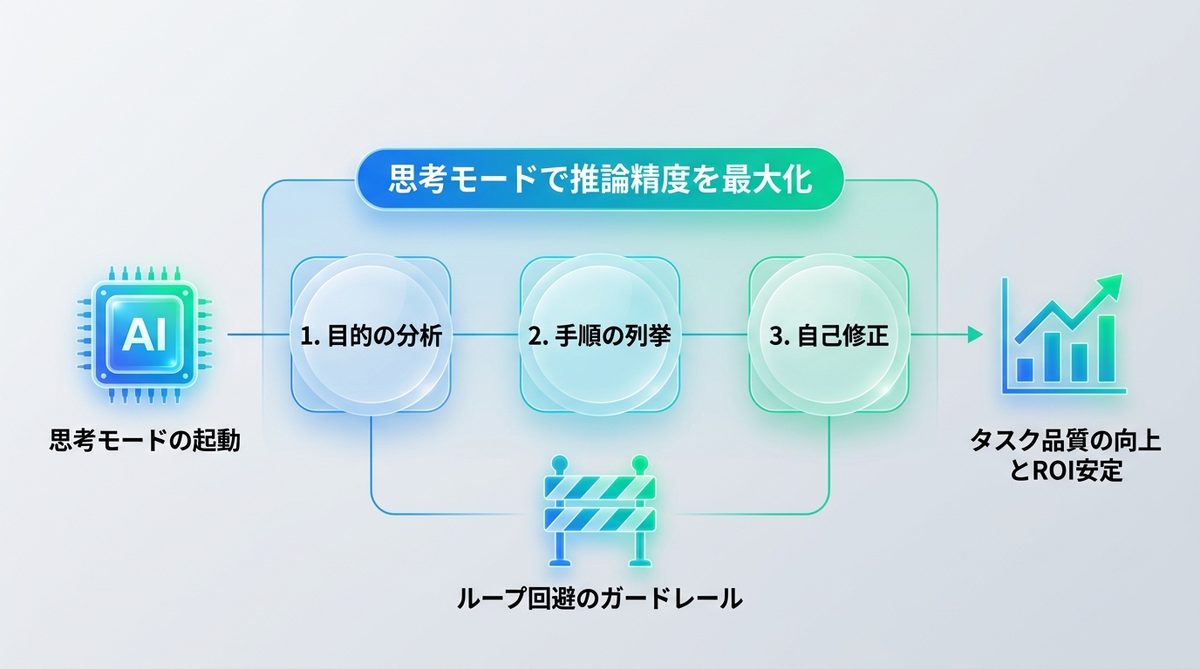

「まず計画してから実行する」:推論思考モードがもたらすタスク品質の向上

いきなり実行するのではなく、「タスク完了のための計画案を作成し、矛盾がないかチェックせよ」というプロンプトを与えることで、エラー率を劇的に下げられます。

OpenClaw上でのプロンプト記述例

あなたは専門の業務アシスタントです。

タスクの実行前に、以下のステップに従ってください。

1. 目的の分析

2. 必要な手順の列挙

3. 実行中の自己修正プロセスの設定

この思考過程を出力してから作業を開始してください。

ループを回避し、最短ルートで業務を完遂させるプロンプトのヒント

「もし3回同じエラーが発生したら、実行を停止してユーザーに報告すること」といったガードレール(安全装置)をプロンプトに加えることで、エージェントの暴走を防ぎ、ROIを安定させられます。

関連記事:【比較検証】OpenClawの仕組みとClaude Coworkの違い|自律型AI導入で経営者が知るべきコストとリスクの境界線

経営者視点で見る:AIエージェントのローカル移行によるROI最大化

ローカル運用はコスト削減だけではありません。企業としての戦略的価値がここにあります。

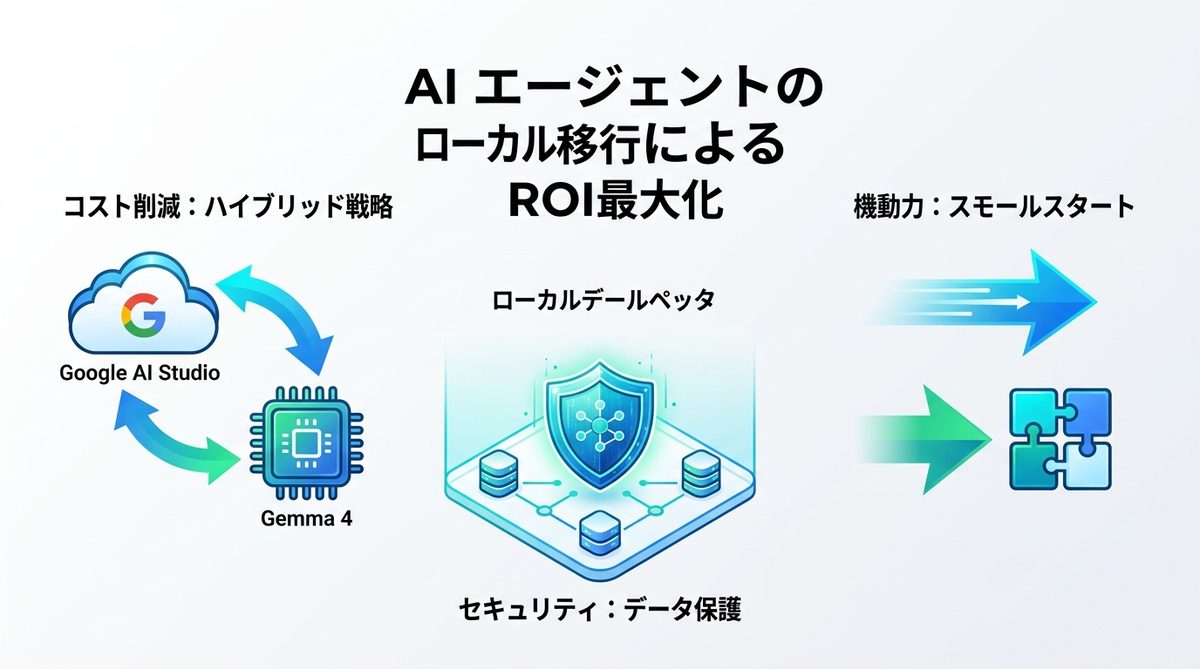

Google AI Studioの無料枠を賢く使い、実質0円運用を実現するシミュレーション

開発やテスト段階ではGoogle AI StudioのAPI(無料枠あり)を活用し、本番環境の自律エージェントにはローカルのGemma 4を充てる。このハイブリッド戦略により、開発コストを抑えつつ、運用コストを限りなくゼロに近づけられます。

セキュリティとプライバシー:社内データを外部に出さない選択の価値

機密性の高い顧客データや社内戦略文書をクラウドにアップロードせず、ローカル環境のみで完結させることは、DX(デジタルトランスフォーメーション)の安全保障そのものです。情報漏洩リスクをゼロに抑えることは、計算コスト以上の価値があります。

「試してダメならすぐ戻せる」:スモールスタートがDXを加速させる理由

ローカルエージェントは環境依存が低く、合わなければ即座にクラウドへ戻せます。まずは特定業務の自動化から、スモールスタートで検証を始めましょう。

関連記事:【2026年最新】失敗しないAIエージェント選定・導入ガイド|MCP対応と業務自動化の判断軸

まとめ

OpenClawとGemma 4 26Bの組み合わせは、コスト・精度・セキュリティの3要素を高度に両立させる、現在の最適解です。

- Gemma 4 26B MoEは7Bモデルを凌駕する高い推論精度を持つ

- ローカル完結型環境により、APIコストを実質0円に抑えられる

- MacBook 16GB以上のメモリ環境があれば、安定稼働が可能

- 思考モードを組み込むことで、複雑な業務も自律的に完遂できる

まずはOllamaをインストールし、Gemma 4を導入して、あなたの業務の自動化を今すぐ始めましょう。