【エンジニア必見】Claude Code local llm活用のリスクと成功法則|APIを補完する「適材適所」な開発ワークフローとは

開発スピードを劇的に変えるClaude Codeですが、APIコストの増大や機密情報の外部送信は、企業導入における大きな壁となります。本記事では、Claude CodeをローカルLLM(ローカル環境で動作する大規模言語モデル)と連携させ、セキュリティとコストをコントロールするための「ハイブリッド運用」の手法を解説します。

目次

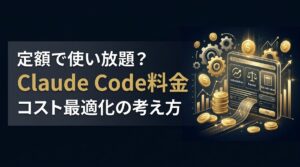

Claude CodeをローカルLLMで動かす「3つの戦略的メリット」

Claude Codeをあえてローカル環境で動かす理由は、単なるコスト削減だけではありません。テックリードとして検討すべき主要なメリットを3つ挙げます。

APIコストを気にせず開発に集中できる

API料金は従量課金であるため、試行錯誤や大規模なリファクタリングを繰り返すとコストが予測不能になります。ローカルLLMを活用すれば、トークン消費を一切気にせず、実験的なコード生成や単純な反復作業を無制限に回すことが可能です。

機密情報の流出リスクを物理的に遮断する

多くの企業でAI活用を阻むのは、ソースコードの外部送信に対するセキュリティポリシーです。ローカルLLMであれば、モデルがPCのメモリ内で完結して動くため、機密性の高いプロジェクトでも外部サーバーへのデータ流出リスクを物理的に遮断できます。

通信遅延を排除しレスポンスを高速化させる

API経由の通信はネットワーク環境に依存します。ローカルサーバーを利用すれば、インターネット回線の混雑状況に左右されず、推論のレスポンスが高速化し、エージェントとの対話がよりスムーズになります。

関連記事:【2026年最新】ローカルAIエージェントの作り方|Ollama×Open WebUIで完全オフライン構築

【実証済み】Claude CodeとローカルLLMの環境構築手順

Claude Codeの公式仕様である「API互換エンドポイント」を活用し、ローカルLLMと連携させる具体的な3ステップを解説します。

推奨される実行環境とハードウェアスペック

ローカルLLMを実用的な速度で動作させるには、推論能力を支える十分なリソースが必要です。特にAIエージェントの処理はメモリを大量に消費します。

- 推奨OS: macOS (Apple Silicon M2/M3/M4チップ搭載機)

- メモリ: 32GB以上(16GBではモデルロード時に不足する可能性が高い)

- ストレージ: 高速なSSD(モデルファイル保存用)

LM Studioを用いたローカルサーバーの立ち上げ

LM Studioなどのツールを活用すると、ローカル環境をOpenAI互換のAPIサーバーとして公開できます。これにより、Claude Codeからは「まるでAPIサーバーに接続している」ように認識されます。

- LM Studioをインストールする

- 「Server」メニューからローカル推論サーバーを起動する

- ベースURL(例:http://localhost:1234/v1)を確認する

環境変数による接続切替の設定方法

.zshrcや.bash_profileに環境変数を設定することで、実行時にAPIとローカルを切り替えられます。ターミナルで以下のように設定します。

# ローカルサーバーを使用する場合 export ANTHROPIC_BASE_URL="http://localhost:1234/v1" export ANTHROPIC_API_KEY="local-mock-key" # ローカルなら任意の値で可

必要に応じてこの変数を切り替えるエイリアスを作成しておくと、作業効率が大幅に向上します。

関連記事:【経営判断】Claude Code モデルの切り替え術|無駄なコストを削り開発スピードを加速させる方法

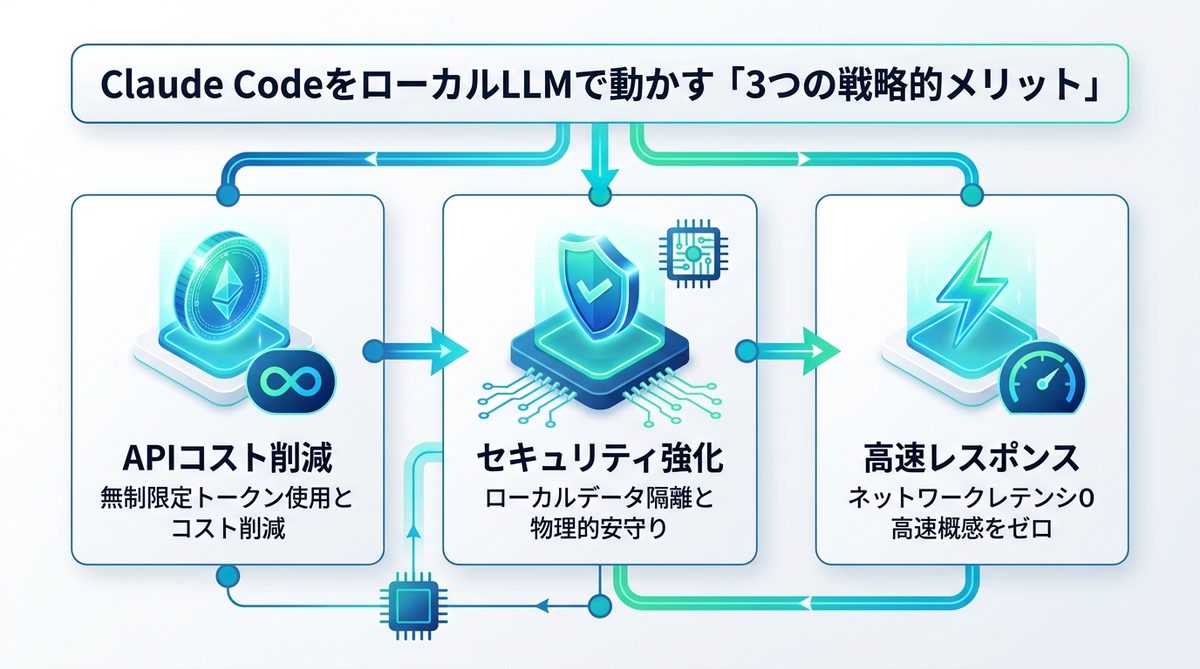

実用性を見極める!コーディングに適したローカルモデルの選定

モデル選びは「推論精度」に直結します。適当なモデルを選ぶとエージェントが「迷子」になるため注意が必要です。

Qwen3-Coderなど最新のコーディング特化型モデルの強み

汎用モデルではなく、コード生成に特化したモデルを選定することが成功の鍵です。特に「Qwen3-Coder」のような最新モデルは、コンテキスト(記憶容量)の理解度が高く、複雑なリファクタリングにも耐えうる能力を持っています。

モデルサイズと推論精度のトレードオフ

| モデルサイズ | 特徴 | 推奨用途 |

|---|---|---|

| 7B - 8Bクラス | 高速・軽量 | 単純なスクリプト作成 |

| 14B - 32Bクラス | バランス型 | 一般的なリファクタリング |

| 70B以上 | 高精度・重い | 複雑なロジック設計・分析 |

メモリ容量に合わせて、まずは14B〜32Bクラスの量子化済みモデルから試すのが定石です。

ツール利用(Tool Use)能力の限界と注意点

ローカルモデルは、Claude公式のAPI版と比べると「ツール利用」の精度が低い傾向にあります。特にディレクトリ階層が深い複雑なプロジェクトでのファイル操作では、誤ったパスを指定したり、処理ループに陥るリスクがあるため、常に人間の監視下で実行してください。

関連記事:【生産性2倍へ】Claude CodeによるAI駆動開発の極意|CLAUDE.mdで制御する安全な自律エージェント運用法

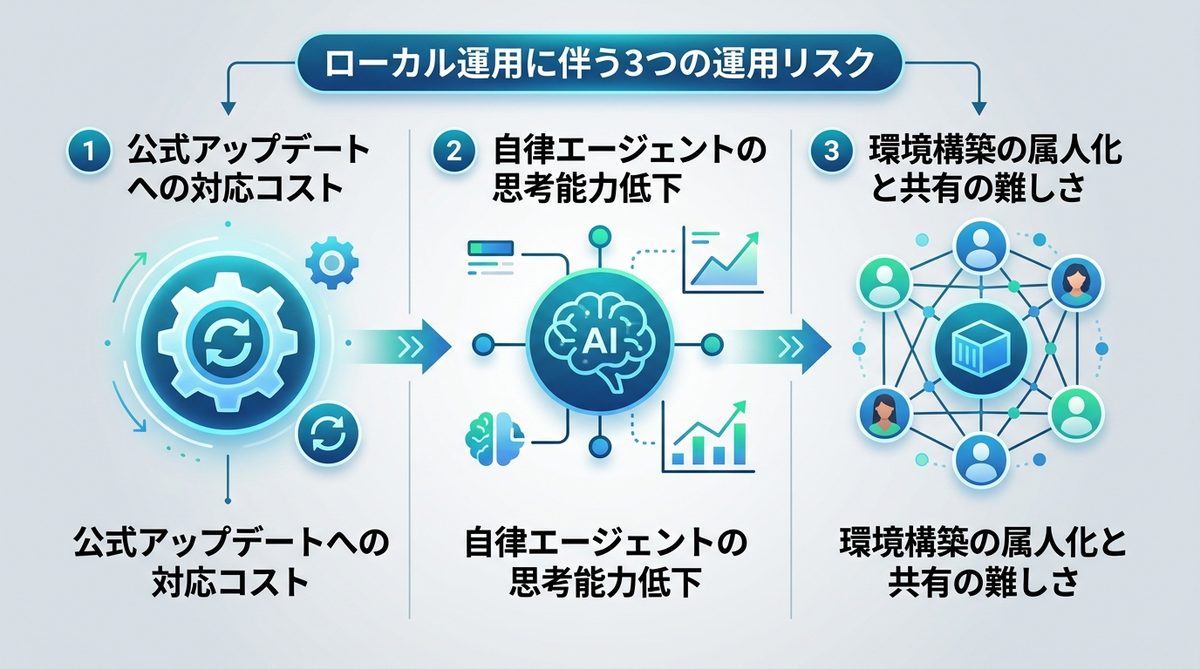

忘れてはいけない!ローカル運用に伴う「3つの運用リスク」

ローカル運用は万能ではありません。管理職やテックリードとして把握しておくべき3つの注意点を紹介します。

公式アップデートに伴う接続整合性の維持コスト

AnthropicがClaude CodeのCLI仕様をアップデートした場合、ローカルLLM側の互換性が崩れることがあります。環境のメンテナンスはエンジニア側で行う必要があり、その工数が発生することを計算に入れておくべきです。

自律エージェントとしての思考能力の低下

API版のClaude 3.5 Sonnet等が持つ「文脈を深く汲み取る能力」や「自己修正能力」は、現在のローカルLLMでは再現しきれない部分です。難易度の高いタスクを無理にローカルで回すと、かえって修正工数が増大します。

環境構築の属人化を防ぐチーム内共有の難しさ

メンバーごとにローカルのGPUスペックやモデル環境が異なると、挙動に差異が生まれます。チーム開発で導入する場合は、コンテナ化や設定ファイルの共有など、構成管理の仕組みが不可欠です。

関連記事:【完全ガイド】AIエージェントに「前提」を二度と言わせない!CLAUDE.mdと.claude/rules/の最適化術

結論:公式APIとローカルLLMの「賢い使い分け」術

ローカルLLM導入を成功させるには、全行程をローカルに寄せるのではなく、役割を分担させることが肝心です。

単純作業はローカル、設計・難問は公式APIのハイブリッド戦略

ローカルLLMは、セキュリティが重要な初期設計や、低難度の単純なコード生成・リファクタリングに充てます。一方で、複雑なバグ調査や高度な機能実装については、迷わず信頼性の高い公式APIを利用する「ハイブリッド運用」が最適解です。

プロジェクトのフェーズに応じたツールの選定基準

- プロトタイプ作成時: 高速なローカルモデルで回し、思考スピードを優先。

- 本番コードの修正時: 推論精度が保証された公式APIを使用し、バグ混入リスクを最小化。

- 機密情報を含む解析: ローカル環境一択で実行し、情報漏洩を徹底的に防御。

関連記事:【図解で解説】Claude Codeとは?Claude Coworkとの違いと活用事例

まとめ

- Claude Codeのローカル連携は、セキュリティとコストの両面からエンジニアリング・ワークフローを保護する強力な武器です。

- LM Studio等を用いて構築可能ですが、推論精度には限界があることを理解しましょう。

- 単純なタスクはローカルで高速化し、複雑なタスクは公式APIに任せるハイブリッド運用が鉄則です。

ローカルLLMの導入は「無料化」ではなく「リスク管理」のための投資です。まずは低難度のリファクタリングからローカル運用を試し、自社の開発環境に最適なバランスを見つけていきましょう。