【情シス必見】Claude Codeのセキュリティ設定|学習除外とテレメトリ制御の正しい手順

Claude Codeの導入により開発効率は劇的に向上しますが、企業の機密情報がAIの学習に使われることを懸念する声は少なくありません。本記事では、ソースコードの機密を守りつつ、Claude Codeを組織で安全に運用するための「学習オプトアウト」と「テレメトリ無効化」の手順を解説します。

目次

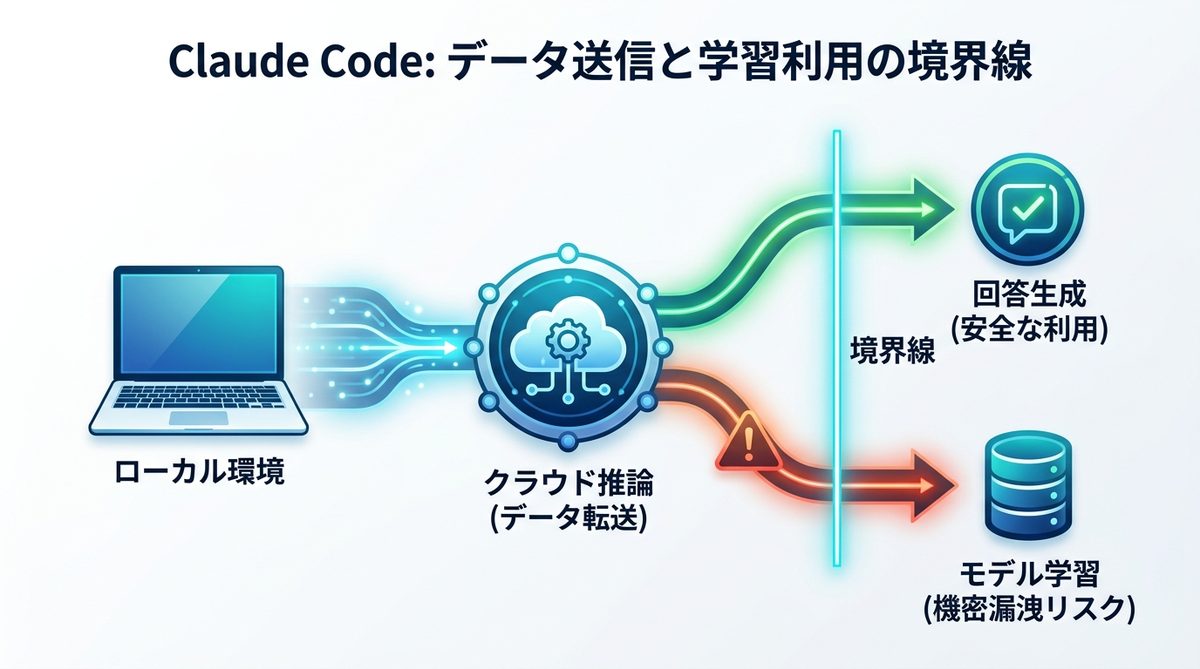

Claude Code導入前に知るべき「データ送信」と「学習利用」の境界線

クラウド型エージェントの仕組みとは?推論のためのデータ転送と学習の違い

Claude Codeは、PCの中に優秀なアシスタントが住み着いた状態で、複雑なコーディング作業を完遂してくれる強力なツールです。ここで重要なのは、「推論(AIがコードを生成・解析する処理)」と「学習(AIモデルそのものを賢くするためにデータを蓄積する処理)」は全く別物であるという点です。

Claude Codeはクラウド型サービスであるため、AIがソースコードを理解して回答を生成するには、サーバーへのデータ転送が不可欠です。しかし、この転送されたデータが「モデルの訓練(学習)」に再利用されるかどうかは、別の次元の話となります。私たちはこの2つを混同せず、リスクの性質を見極める必要があります。

なぜ「学習利用」が経営課題となるのか?機密情報保護の観点から

企業にとって、ソースコードは最高レベルの機密資産です。AIの学習にコードが利用されるリスクを放置することは、自社の知的財産が将来的なAIの回答として、あるいは他社の開発環境で意図せず漏洩する可能性を孕んでいます。法務・経営陣にとって、単なる利便性よりも「データが外部モデルの肥やしにならないこと」の確約が、導入の絶対条件となるのです。

関連記事:【企業導入ガイド】Claude CodeをAWS Bedrockで安全に動かすための環境構築術

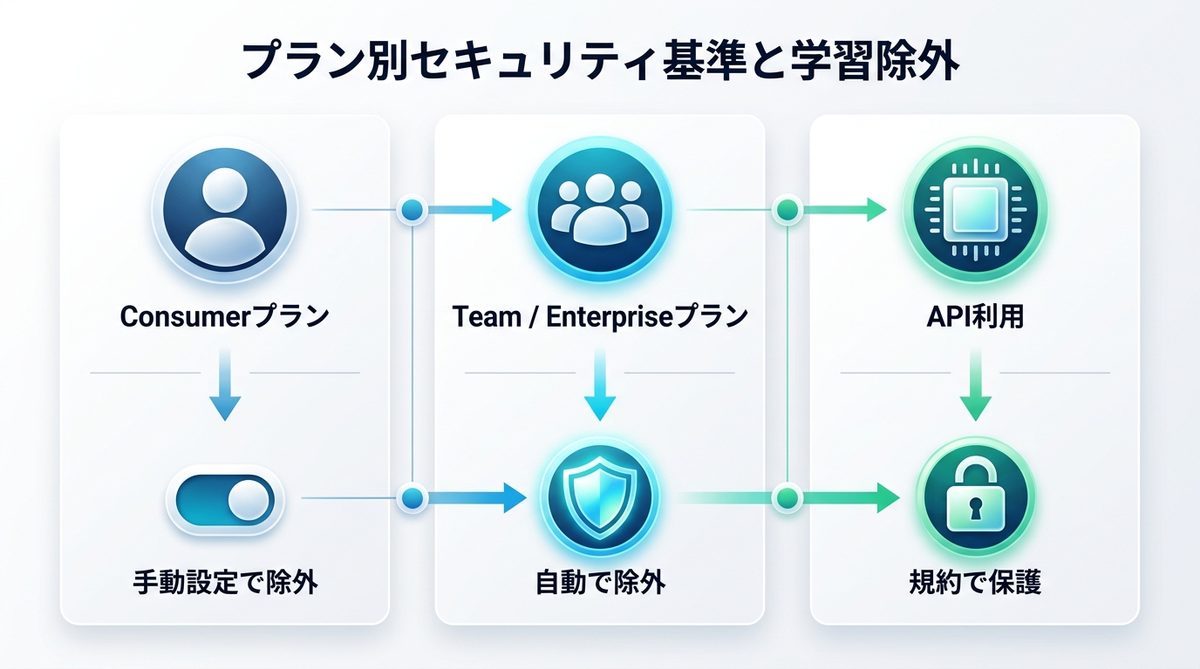

【図解】プラン別に見るセキュリティ基準と学習除外の仕組み

ConsumerプランとTeam/Enterpriseプランの決定的な違い

Anthropic社が提供する各プランには、データの取り扱い規約に明確な差があります。まずは以下の比較表を確認してください。

| プラン区分 | 学習への利用 | 適用設定 |

|---|---|---|

| Consumer (Free/Pro) | 設定によりオプトアウト可能 | ユーザー側で手動設定 |

| Team / Enterprise | デフォルトで対象外 | 自動適用(設定不要) |

| API 利用 | デフォルトで対象外 | 自動適用(規約により担保) |

API利用および法人プランが選ばれる法的・規約的根拠

Team/EnterpriseプランおよびAPIを利用した開発環境では、Anthropicの利用規約に基づき、入力データがモデルの改善や学習のために使用されることはありません。これは法務的にも非常に強力な根拠となります。特にAPI経由での利用は、データプライバシーが強固に保護される設計となっており、機密性の高いシステム開発においては、個人アカウントの利用ではなくAPI連携を前提とすることが推奨されます。

関連記事:【図解で解説】Claude Codeとは?Claude Coworkとの違いと活用事例

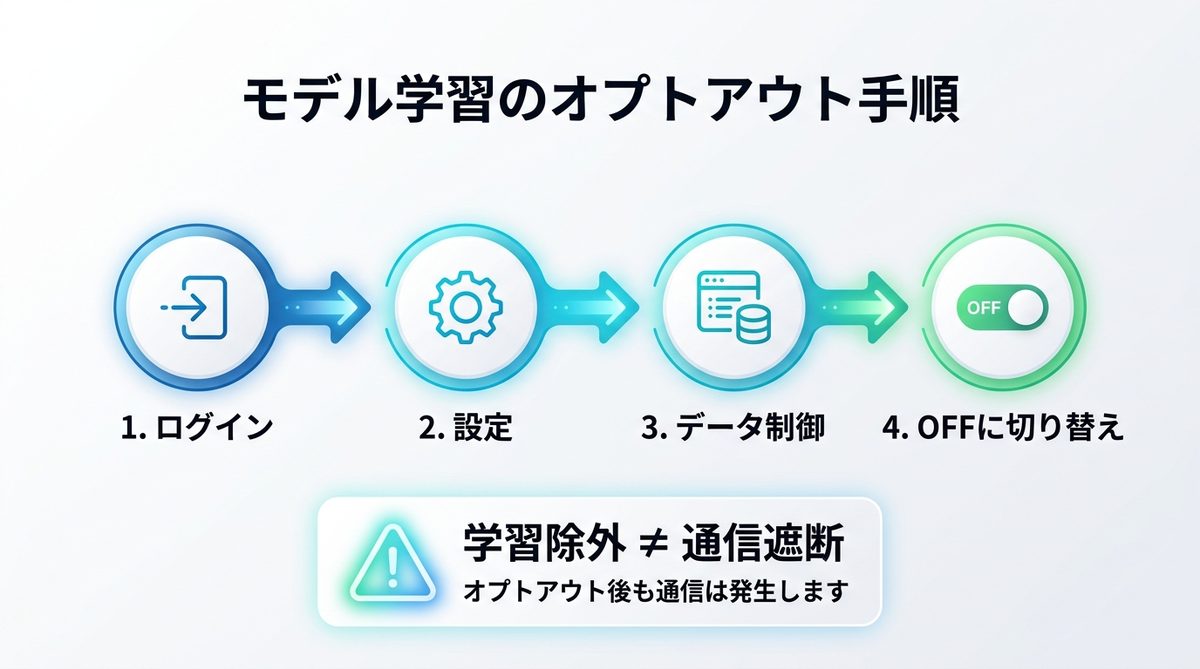

必須ガードレール設定1:モデル学習のオプトアウト手順

アカウント設定から行う「学習除外」の適用方法

個人向けのProプラン等を使用する場合、必ず以下の手順で学習オプトアウトを実施してください。

- Claude公式Webサイト(claude.ai)にログインする。

- 左下のアイコンから「Settings(設定)」を開く。

- 「Data Controls(データ制御)」タブを選択する。

- 「Allow Claude to use your content to improve its models(モデル改善へのデータ利用)」のスイッチを「OFF」にする。

この設定を完了させることで、Claudeのアカウントに紐づくデータは、将来的なモデル学習から除外されることが保証されます。

オプトアウトしても消えない「データ送信」という前提の再確認

ここで強調したいのは、オプトアウト設定をしたからといって「データが外部に一切出ない」わけではないという事実です。AIがコードを解析・修正するためには、依然としてサーバーとの間でソースコードの転送が行われます。オプトアウトは「学習への再利用を禁止する」ためのガードレールであり、「通信そのものを遮断する」ためのものではないことを、改めて開発チーム全体で共有してください。

関連記事:【2026年最新】ローカルAIエージェントの作り方|Ollama×Open WebUIで完全オフライン構築

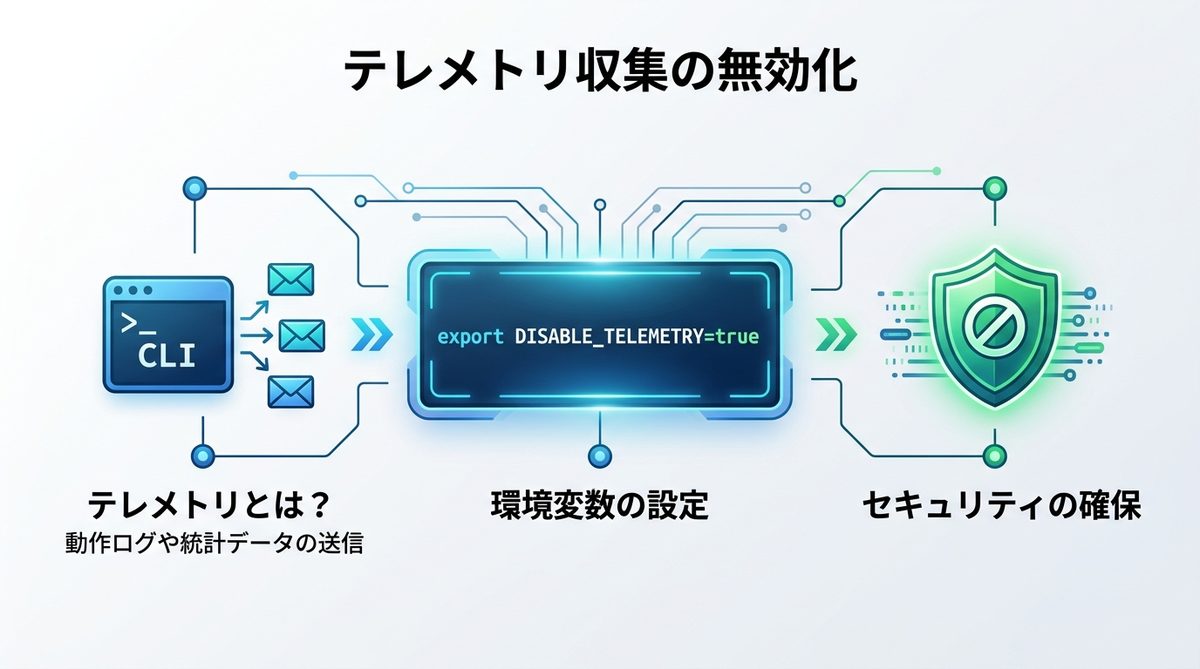

必須ガードレール設定2:環境変数によるテレメトリ収集の無効化

CLIツールにおける「テレメトリ(動作ログ)」の正体とは?

Claude CodeのようなCLI(コマンドラインインターフェース)ツールには、利便性向上のために「テレメトリ(遠隔測定)」機能が搭載されていることがあります。これは、ツールがクラッシュした際のエラーログや、どの機能がどれくらい使われたかという統計データをAnthropicへ送信する仕組みです。これはモデルの学習とは異なる技術的データですが、企業の厳格なセキュリティポリシー下では、これも送信を制限すべき対象となり得ます。

DISABLE_TELEMETRY=true を設定する具体的なコマンドライン操作

Claude Codeのテレメトリ収集を完全に無効化するには、環境変数を使用します。各OSのシェル設定ファイル(.bashrcや.zshrcなど)に以下の設定を追加してください。

export DISABLE_TELEMETRY=true

これにより、CLIツールが動作ログやエラーレポートを送信することを防げます。導入時は必ずこの変数が有効化されていることを、デプロイ前のスクリプトなどでチェックする体制を構築しましょう。

関連記事:【エンジニア必見】Claude Code HooksでAIを完全統治する:3つの制御技術と実装レシピ

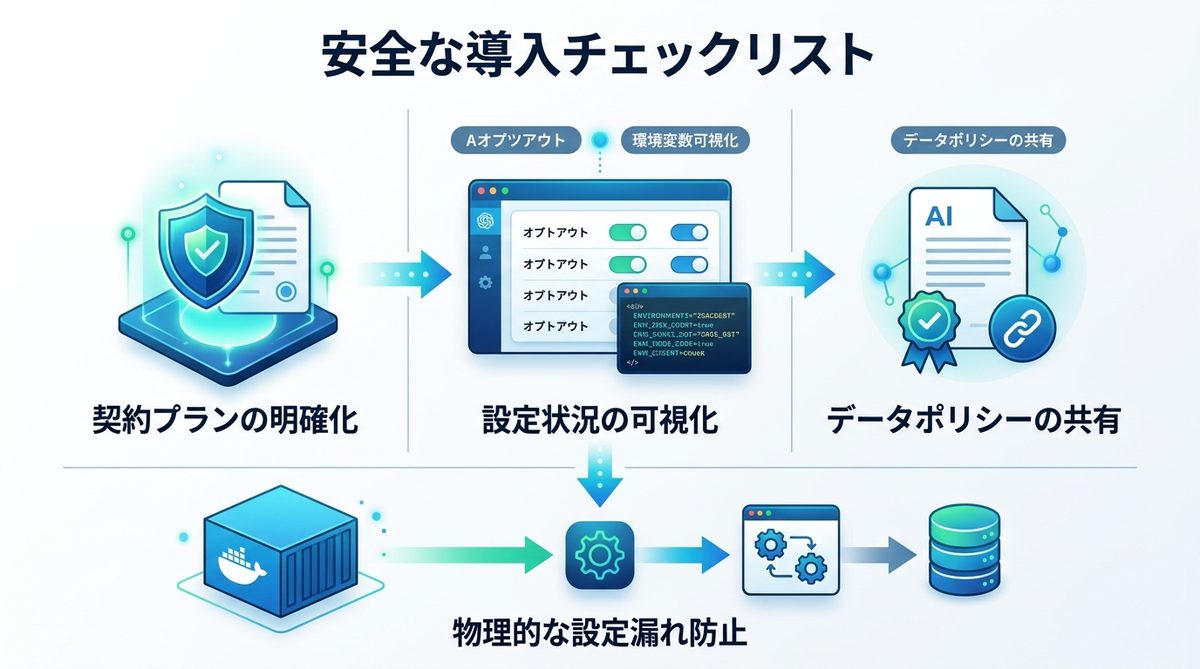

情シス・法務を説得するための「安全な導入チェックリスト」

導入の承認を得るために確認すべき3つのポイント

情シスや法務へ説明する際は、単に「便利です」と伝えるのではなく、以下の3点をまとめた資料を提示してください。

- 契約プランの明確化: 学習対象外となるTeamプランを利用する、あるいはAPI経由で利用する旨の定義。

- 設定状況の可視化: 学習オプトアウト設定画面のスクリーンショットおよび環境変数設定(

DISABLE_TELEMETRY)の提示。 - データポリシーの共有: Anthropic公式のセキュリティ規約(Trust Centerなど)へのリンクと、自社の業務規程との整合性確認。

組織として運用ルールを定める際のヒント

導入を成功させるコツは、設定を現場個人の裁量に任せないことです。例えば、開発用コンテナ(Docker)を起動する際に、自動的に環境変数がセットされるような仕組みを構築することで、「設定漏れ」というヒューマンエラーを物理的に排除できます。

関連記事:【生産性2倍へ】Claude CodeによるAI駆動開発の極意|CLAUDE.mdで制御する安全な自律エージェント運用法

まとめ

Claude Codeを安全に業務導入するための要点を整理します。

- 学習と推論は別物: オプトアウト設定は学習を防ぐものだが、推論のための通信は継続されることを理解する。

- プラン選びが重要: 法人利用では、デフォルトで学習除外が保証されているTeam/Enterpriseプラン、またはAPI利用を優先する。

- 二段構えのガードレール: Webの設定画面から「学習オプトアウト」を行い、CLI側で「テレメトリ無効化」を設定する。

- エビデンスの準備: 情シス・法務への説明には、設定画面のキャプチャと規約の根拠資料を必ず準備する。

Claude Codeを安全に運用するには、学習への利用を止めるだけでなく、CLIの挙動を個別に制御する「二段構えのガードレール」が不可欠です。この記事の内容を基に、ぜひ自社のセキュリティ要件に合わせた導入計画を策定し、今すぐ安全なAI環境を構築しましょう。