Voxtral TTSの使い方|API連携からローカル環境構築までを完全解説

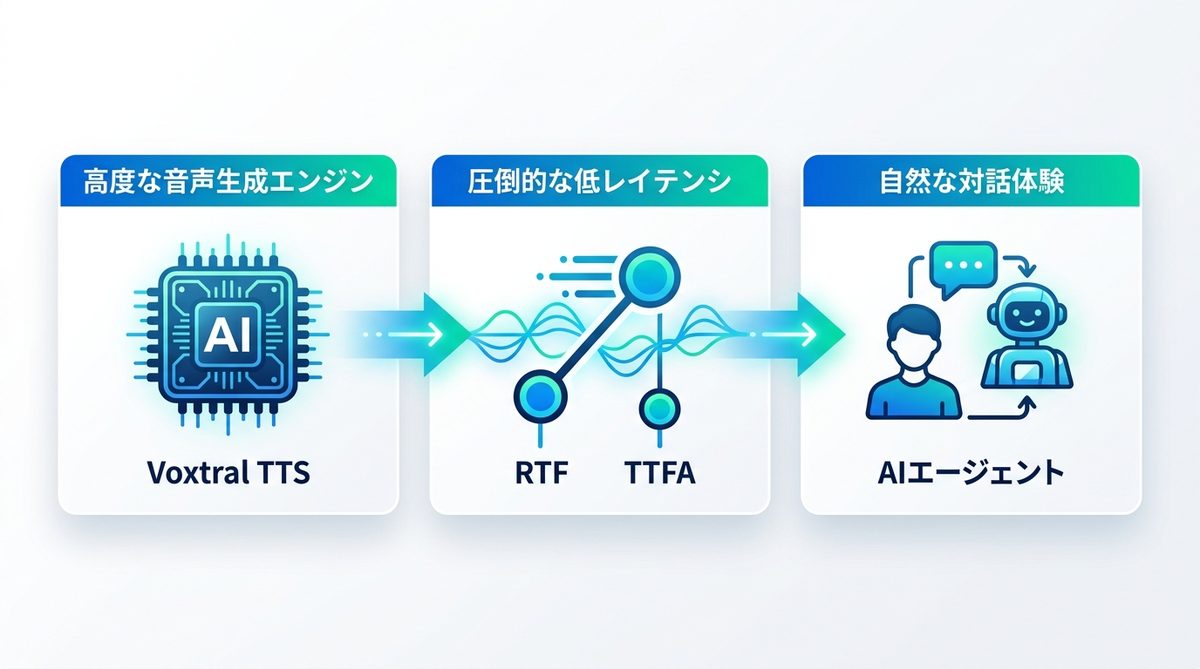

AIエージェントのボイスインターフェースを開発する際、応答の遅延がユーザー体験を損なうことは大きな課題です。Voxtral TTSは、その圧倒的な低レイテンシ(処理の遅延)性能で、自然な対話を実現するための強力な選択肢となります。本記事では、API実装からローカル環境での推論、ボイスクローニングのコツまでを技術的な観点から解説します。

この記事に対する編集部の見解

- OpenAI TTS・Google TTSと比べると3〜4倍の速度差があり、リアルタイム処理での低遅延性能は明確に優位

- ElevenLabsとはクラウドでほぼ互角(70ms対75ms)だが、ローカル実行すれば実質的に速くなる

- 70msの低遅延が必要なのはリアルタイム音声会話AIのみ、コンテンツ制作用途なら300msで十分

目次

Voxtral TTSの低レイテンシ性能

Voxtral TTSは、特にリアルタイム性が求められるAIエージェントとの会話体験において、次世代のスタンダードとなる音声合成技術です。

他モデルとの違い(RTF・TTFA)

Mistralの公式発表によると、VoxtralのRTF(Real-Time Factor:実時間に対する処理時間の比率)は9.7x(10秒の音声を約1秒で生成)、TTFA(Time To First Audio:最初の音声が出力されるまでの時間)は70ms(実測約90〜100ms)です。

| モデル | TTFA(モデルレイテンシ) | 備考 |

|---|---|---|

| Voxtral TTS | 70ms | Mistral公式発表・RTF 9.7x |

| ElevenLabs Flash v2.5 | 約75ms | ElevenLabs公表 |

| OpenAI TTS-1 | 300ms以上 | — |

| Google TTS(Studio) | 200〜250ms | — |

ElevenLabsとはほぼ同等の低遅延ですが、OpenAIやGoogle TTSと比較すると3〜4倍の速度差があります。品質面ではMistral社内の盲検評価でElevenLabs Flash v2.5に対して68.4%の選好率を記録しています。なおRTFは競合他社が非公開のため直接比較はできません。

AI搭載のメリット

AIエージェントとユーザーの対話において、0.5秒の遅延が会話のテンポを崩します。Voxtral TTSの採用により、待機時間の少ないシームレスな体験を実現し、コンバージョン率やユーザー満足度の向上が期待できます。

関連記事:【開発者向け】AIエージェント開発フレームワーク比較と選び方のコツ

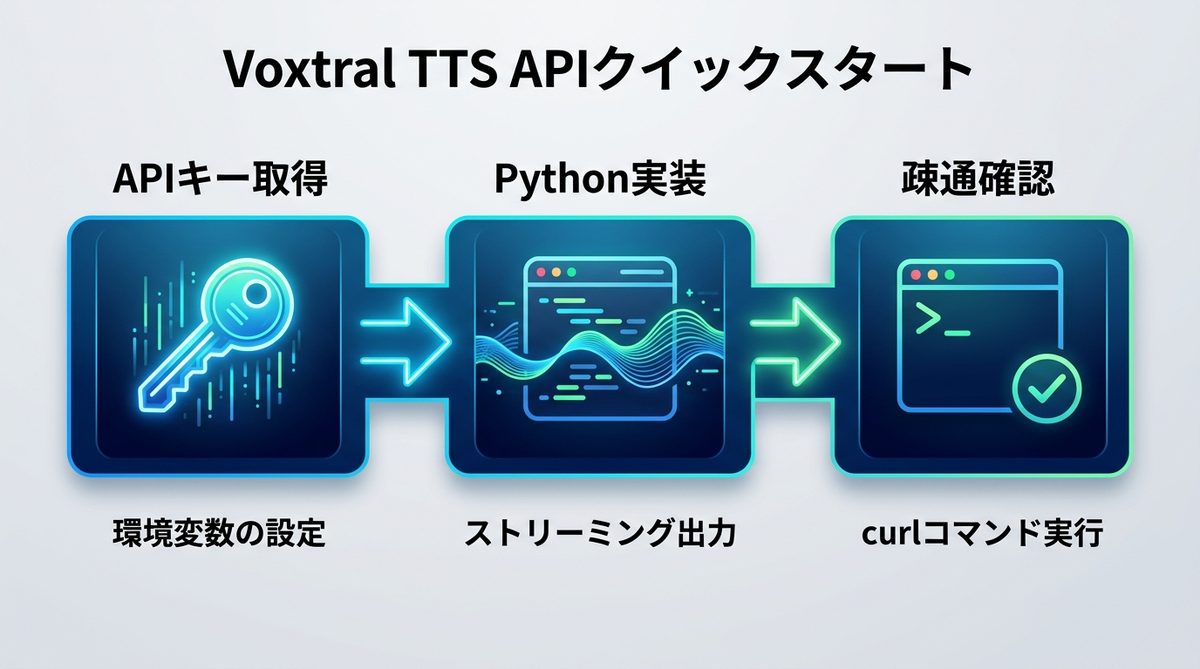

Voxtral TTS API実装

まずは最も手軽なAPI経由での実装手順を紹介します。数行のコードで環境を構築できます。

環境準備とキー取得

公式サイトから取得したAPIキーを環境変数に設定します。

export VOXTRAL_API_KEY="your_api_key_here"

Python実行コード

リアルタイム性を重視し、ストリーミング(逐次データ転送)で音声を取得する実装例です。

import requests url = "https://api.mistral.ai/v1/audio/speech" headers = {"Authorization": f"Bearer {VOXTRAL_API_KEY}"} data = {"text": "こんにちは、今日はどのようなご用件でしょうか?", "stream": True} response = requests.post(url, json=data, stream=True) for chunk in response.iter_content(chunk_size=1024): # 逐次再生処理をここに記述 process_audio_chunk(chunk)

curl疎通確認

ターミナルから直接動作確認を行う場合は以下のコマンドを使用します。

curl -X POST https://api.mistral.ai/v1/audio/speech \ -H "Authorization: Bearer $VOXTRAL_API_KEY" \ -d '{"text": "接続テスト"}' > output.wav

関連記事:AIエージェント API連携の始め方|ノーコードからMCP実装までの最短ルート

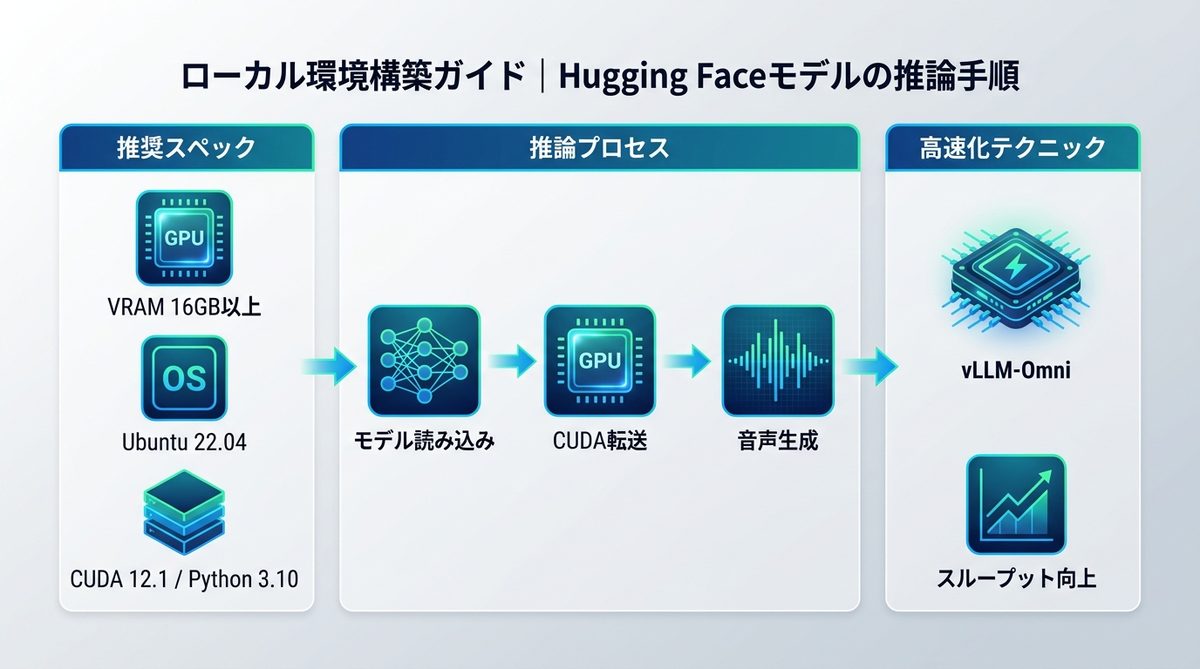

ローカル環境構築と推論

プライバシー要件が厳しいエンタープライズ用途では、ローカル環境での実行が必須です。

推奨スペックと構成

安定した推論には、VRAM(ビデオメモリ)が16GB以上のNVIDIA GPUを推奨します。

- OS: Ubuntu 22.04 LTS

- CUDA: 12.1以上

- Python: 3.10以上

音声生成コード例

from transformers import AutoModelForTTS model = AutoModelForTTS.from_pretrained("mistralai/Voxtral-4B-TTS-2603") model.to("cuda") # 推論実行 audio = model.generate("ローカル環境での音声生成テスト") model.save_audio(audio, "output.wav")

vLLM-Omni活用

vLLM-Omniを活用することで、推論のバッチサイズを最適化し、スループット(単位時間あたりの処理量)を向上させることが可能です。

関連記事:【2026年最新】ローカルAIエージェントの作り方|Ollama×Open WebUIで完全オフライン構築

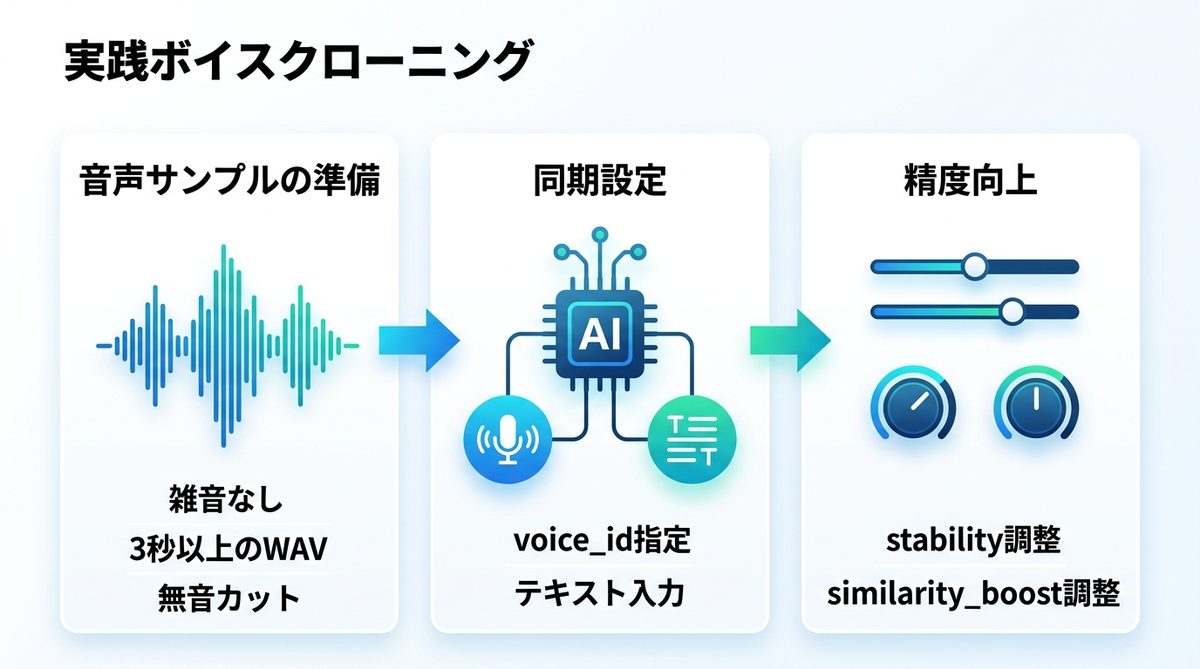

実践ボイスクローニング

特定のキャラクターや個人の声を再現するボイスクローニングは、3秒のサンプルから可能です。

サンプル準備と注意点

- 周囲の雑音が皆無であること

- 3秒以上、かつ明瞭に話している音声ファイル(WAV形式)を用意

- 無音区間を極力カットしたサンプルを使用

データ同期設定

APIのvoice_idパラメータに、アップロードしたサンプルを指定するだけで、その声色を模倣してテキストを読み上げます。

パラメータ調整

stabilityとsimilarity_boostを調整することで、再現性の度合いを制御できます。まずは初期値で試した後、0.1単位で数値を調整してください。

関連記事:【2026年最新】RealtimeのAPI料金は?ビジネス導入で予算超過を防ぐコスト試算ガイド

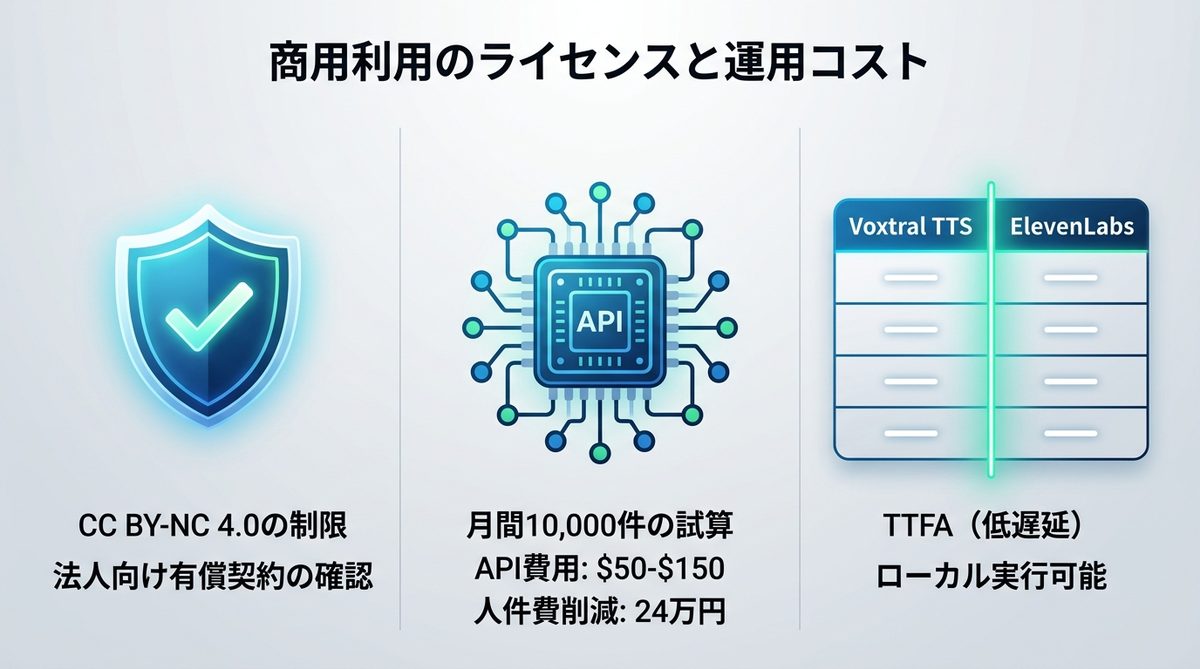

商用利用と運用コスト

ビジネス利用の前に、ライセンス形態と費用感の把握は必須です。

ライセンス解釈

現状、提供されているモデルの多くは「CC BY-NC 4.0(非営利目的)」に該当します。商用サービスへの組み込みには、法人向けの有償ライセンス契約が必要か、または商用利用可能なモデルかを公式サイトの規約で必ず確認してください。

APIコスト計算

以下の表は、一般的なAIエージェント業務(カスタマーサポートの応答生成・月間10,000件)を想定した試算です。

| 項目 | 詳細内容 |

|---|---|

| 月間件数 | 10,000件 |

| 平均文字数 | 200文字 |

| API費用(推算) | 月額 $50〜$150(利用プランによる) |

| 手動作業人件費 | 200時間/月(1,200円/時 = 24万円) |

※削減率は業務の種類・件数・処理の複雑さによって大きく異なります。

他社との比較

| 比較項目 | Voxtral TTS | ElevenLabs |

|---|---|---|

| TTFA(遅延) | 極めて低い | 低い |

| ローカル実行 | 可能 | 不可 |

| 商用ライセンス | 要確認 | 柔軟 |

関連記事:【モデル規模別】AIエージェント開発に必要なPCスペック

トラブルシューティング

現場で遭遇しやすい3つのエラーをまとめました。

音声出力の確認

出力されたファイルが再生できない場合、サンプリングレートがモデル指定(通常24kHzまたは44.1kHz)と一致しているかを確認してください。

仮想環境の管理

condaやvenvを活用し、プロジェクトごとに環境を分離してください。特にtorchとtransformersのバージョン相性によるエラーが多発します。

メモリ不足の解決

CUDA Out of Memoryエラーが発生した場合は、一度に処理するテキストの長さを短くするか、バッチサイズを1に設定して実行してください。

関連記事:【2026年最新】Mamba-3とは?Transformerを超える「推論効率」の仕組みを解説

まとめ

Voxtral TTSを導入することで、AIエージェントの会話体験は劇的に向上します。本記事の要点は以下の通りです。

- API実装なら数行のコードで即座にリアルタイム音声生成が可能

- ローカル環境では16GB VRAM以上のGPU環境を推奨

- 商用利用時はCC BY-NC 4.0のライセンス制限を必ず確認する

- エラー時はサンプリングレートと仮想環境の競合を優先的にチェックする

まずはAPIキーを取得して、簡単なテキスト読み上げテストから始めてみましょう。

AIエージェントナビ編集部の見解

AIエージェントナビでは、各記事のテーマについて編集長が「実際どうなの?」という素朴な疑問を「Nav」と名付けたAIエージェントにぶつけています。エンジニアではなく、経営者・ビジネス視点からの率直な見解をお届けします。

編集長の率直な感想

編集長

Nav

編集長

Nav

編集長

Nav

編集部のまとめ

- OpenAI TTS・Google TTSと比べると3〜4倍の速度差があり、リアルタイム処理での低遅延性能は明確に優位

- ElevenLabsとはクラウドでほぼ互角(70ms対75ms)だが、ローカル実行すれば実質的に速くなる

- 70msの低遅延が必要なのはリアルタイム音声会話AIのみ、コンテンツ制作用途なら300msで十分