【比較検証】Gemma 4とGemma 3の違いを解説|自社専用モデル構築の選定基準と4つのモデルサイズ

機密情報を扱うビジネス現場において、外部のAI APIを利用することによるセキュリティリスクや、利用増に伴うコスト増大に悩んでいませんか。2026年4月にGoogleがリリースしたオープンモデル「Gemma 4」は、AIインフラのあり方を根本から変える可能性を秘めています。

本記事では、Gemma 3との決定的な違いを詳細に解説し、なぜ今、企業が「API依存」を脱却し、自社でAIを「保有」するべきなのか、その戦略的なメリットを紐解きます。

目次

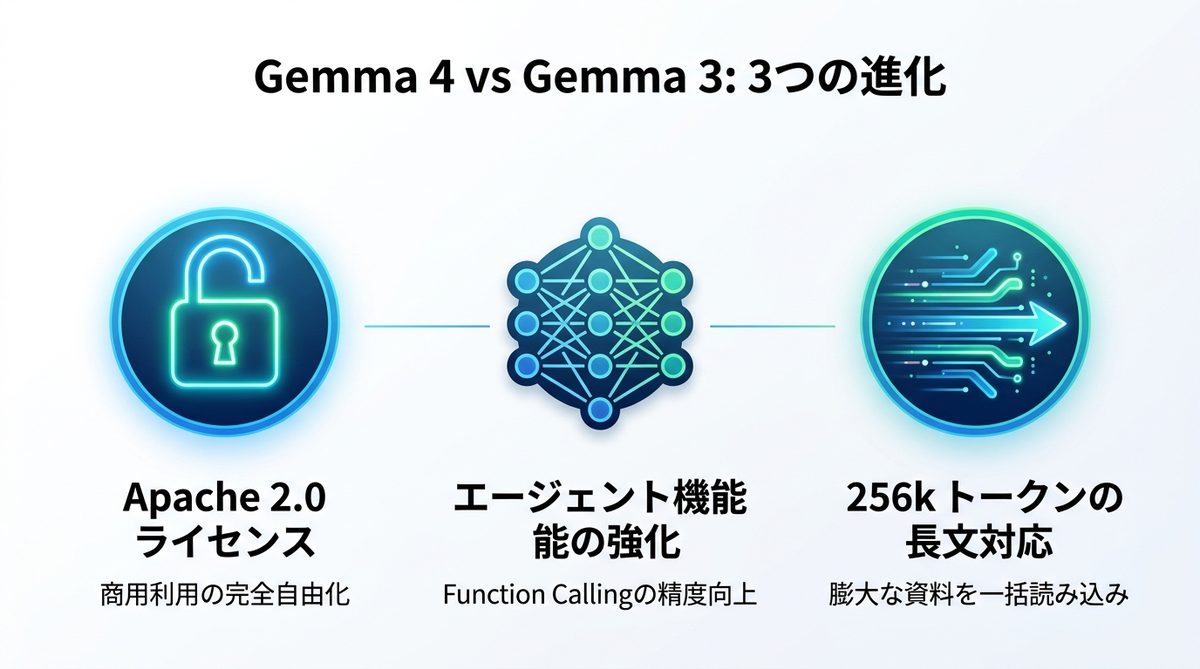

【衝撃の転換】Gemma 4とGemma 3の決定的な違い3選

Gemma 4の登場は、単なる性能向上に留まりません。ビジネス現場での運用を前提とした、実用性の高い進化を遂げました。

ライセンスの壁が消滅!「Apache 2.0」による商用利用の民主化

Gemma 3までは、商用利用において一部制約が存在しましたが、Gemma 4ではついに「Apache 2.0ライセンス」が採用されました。これは、企業が法的な懸念を抱くことなく、モデルの改変・再配布・商用利用が完全に自由であることを意味します。

- 法的リスクの解消: 知的財産権の帰属や、将来的な利用制限に関する不安がゼロになります。

- 自社資産化の加速: モデルを自社の環境に組み込み、独自のビジネスロジックを学習させる「自社専用モデル」としての運用が確約されます。

エージェントワークフローへの最適化(Function Callingの強化)

Gemma 4は、単なる「対話型AI」から、自律的にツールを操作して業務を遂行する「労働力としてのAI」へと進化しました。

- Function Calling(外部ツール呼び出し)の精度向上: APIを叩いたり、社内データベースを検索したりする際のアクション実行能力が格段に向上しています。

- 一貫性のある推論: 複数のタスクを並行処理するエージェント構築において、途中で指示を見失わない堅牢なロジックを維持できます。

256kトークンの衝撃!長文読解能力の飛躍的向上

ビジネス文書や技術マニュアル、法務契約書などを扱う際、情報の分断は大きなストレスでした。Gemma 4は最大256kトークン(約20万語以上のテキスト量)という膨大なコンテキスト(記憶容量)に対応しています。

- 一括読み込み: 膨大な資料を分割することなく一度に読み込ませ、文脈を完全に理解させた上での回答が可能です。

- 精度の維持: 長文を扱っても回答の品質が低下しにくく、複雑な会議録や契約書の照合でも高い信頼性を発揮します。

関連記事:【2026年版】ローカル生成AIの始め方|PCスペック判定表とおすすめソフト徹底解説

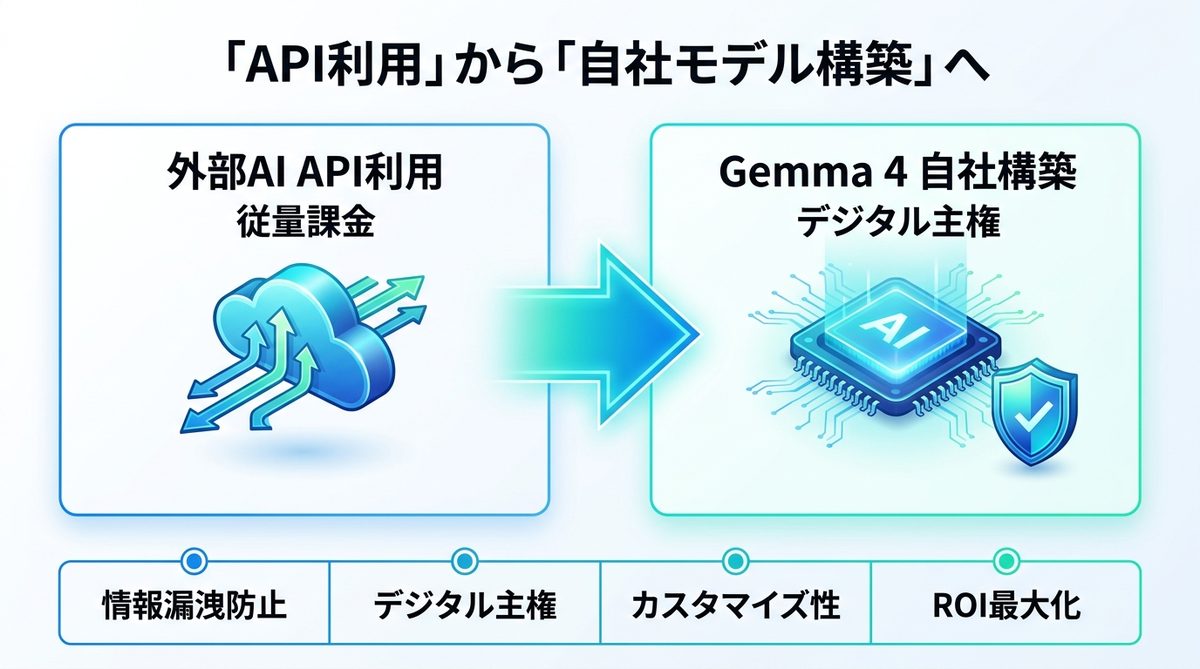

なぜ「API利用」から「自社モデル構築」へシフトすべきなのか?

多くの経営者が「AIを導入したいが、機密データは外部に出したくない」というジレンマを抱えています。Gemma 4はその解決策を提示します。

デジタル主権の確保とセキュリティリスクの低減

外部APIを利用する場合、データは常にベンダーのサーバーを経由します。Gemma 4であれば、自社の社内サーバーや閉域網内で完結させることが可能です。

- 情報漏洩の防止: 学習データが外部に流出するリスクを物理的に遮断できます。

- デジタル主権: AIの判断基準を他社に依存せず、自社のビジネスルールを直接モデルに反映させることが可能です。

中長期的なコスト最適化とROIの最大化

API利用は「使えば使うほどコストが増える」従量課金モデルです。一方、Gemma 4による自社構築は「初期投資+計算リソース」の固定費型モデルです。

| 比較項目 | 外部AI API利用 | Gemma 4 自社構築 |

|---|---|---|

| コスト構造 | 従量課金(利用量に比例) | 固定費(計算リソースのみ) |

| データ制御 | ベンダー管理 | 完全な自社管理 |

| カスタマイズ性 | 限定的 | 制限なし |

| 長期ROI | 規模拡大でコスト増大 | 規模拡大で効率向上 |

関連記事:【2026年最新】生成AI料金比較!目的別おすすめツールとROIを最大化する選び方

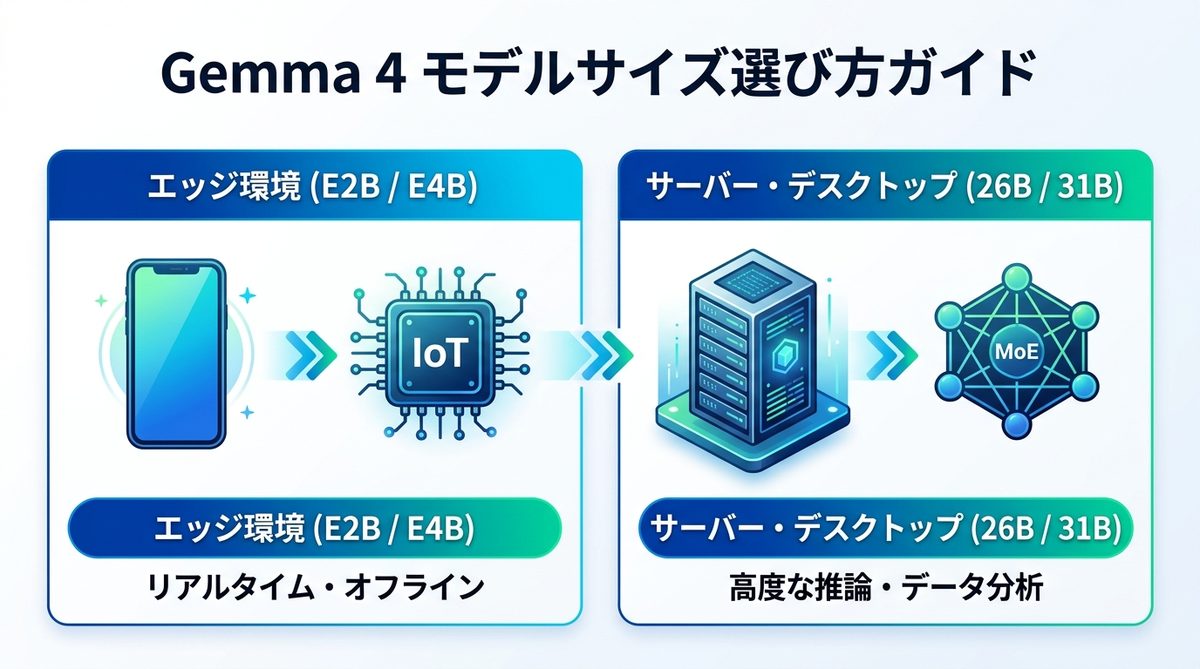

目的別・Gemma 4の4つのモデルサイズ選び方ガイド

Gemma 4は、用途に応じて最適なサイズを選択できる柔軟性を備えています。

エッジ環境で動かす「E2B・E4B」:現場端末でのAI活用事例

E2B(20億パラメータ)とE4B(40億パラメータ)は、軽量かつ高速なモデルです。

- 用途: ネットワーク環境が不安定な現場、モバイルデバイス、IoT機器での動作。

- 利点: クラウドに接続せずとも、端末内でリアルタイムに応答可能です。

サーバー・デスクトップ向けの「26B・31B」:高度な推論が求められる業務

26B(260億パラメータ・MoE構造採用)と31B(310億パラメータ)は、高い知能を要する業務に適しています。

- 26B (MoE): 混合エキスパート技術(MoE)により、効率的に計算リソースを使いながら高い推論能力を発揮します。標準的なサーバー運用に最適です。

- 31B: 複雑なデータ分析、プログラミング支援、高度な論理推論が必要な業務で真価を発揮します。

関連記事:【2026年最新】失敗しないAIエージェント選定・導入ガイド|MCP対応と業務自動化の判断軸

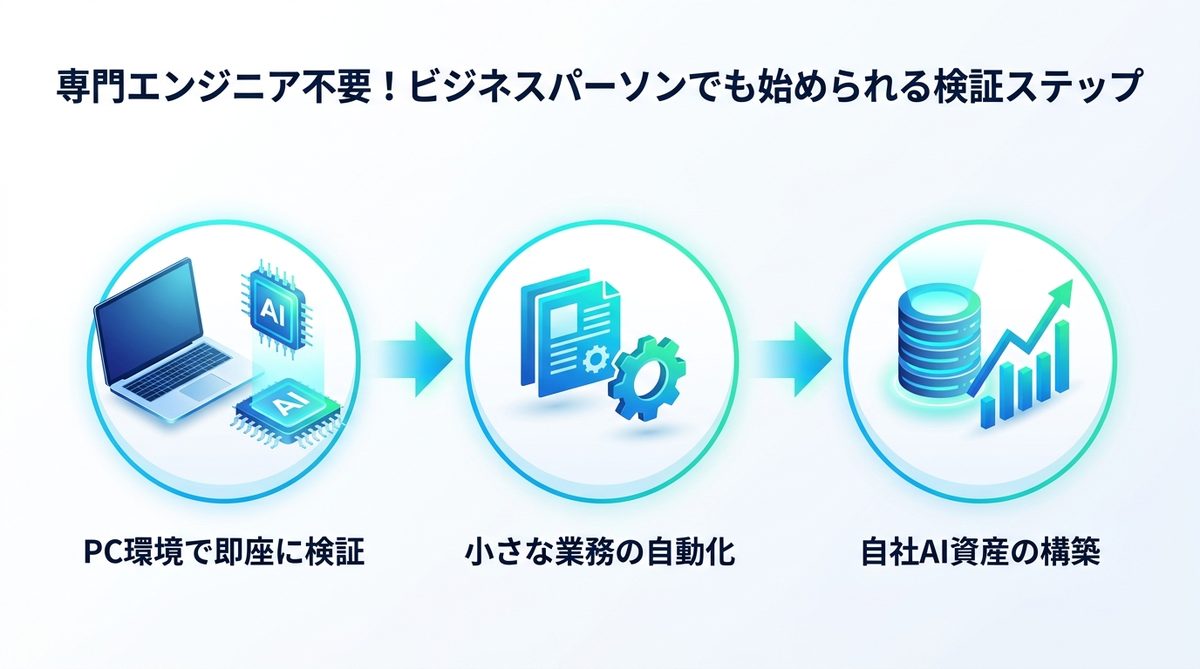

専門エンジニア不要!ビジネスパーソンでも始められる検証ステップ

AIエージェントの構築は、もはやエンジニアだけの特権ではありません。

Ollama等のツールを使えばPC環境で即座に検証可能

「Ollama」などのツールを活用すれば、複雑な環境構築をせずとも、一般的なノートPC上でGemma 4の最新モデルを動かせます。まずは個人の環境で、自社のドキュメントを読み込ませる実験から始めましょう。

まずは小さな業務の自動化から「自社AI資産」を築く

いきなり全社導入を目指すのではなく、まずは「会議の要約」や「社内規定のQ&A」など、リスクの低い小さなタスクから自動化します。成功体験を積み重ね、自社専用モデルを育てることは、中長期的なAI競争力に直結します。

関連記事:【2026年版】AIエージェント比較表付き!おすすめツールと選び方を徹底解説

まとめ

Gemma 4の導入は、外部依存からの脱却と自社インフラの強化を意味する重要な経営判断です。本記事の要点を振り返ります。

- 商用利用の完全自由化: Apache 2.0ライセンスにより、ビジネスで安全に活用可能。

- モデルの適材適所: 用途に合わせて4つのサイズ(E2B/E4B/26B/31B)を柔軟に選択。

- セキュリティの確保: 自社でモデルを抱えることで、データ主権を確実なものにする。

- コスト構造の転換: 従量課金からの脱却により、中長期的なROIを最大化。

まずはOllamaをインストールし、小さな業務から検証を始めてみましょう。自社のAIエージェントを構築するプロジェクトを今すぐ開始し、競合他社に差をつけるAIインフラの土台を築いてください。