【検証】Claude Codeの「YOLOモード」を常用してはいけない3つの理由と安全な代替案

Claude Codeによる開発プロセスの自動化は、エンジニアの生産性を劇的に向上させる一方で、AIエージェントの「権限」に関する議論を避けては通れません。特に、確認プロンプトを全スキップする「YOLOモード」は、効率を最大化する一方で重大なリスクを孕んでいます。本記事では、このモードが秘める技術的リスクと、企業開発において推奨される「安全なサンドボックス(隔離された実行環境)」の活用法を解説します。

目次

Claude Codeの「YOLOモード」とは何か?その正体と仕組み

AIエージェントの操作において、効率性と安全性のトレードオフを象徴する機能が「YOLOモード」です。

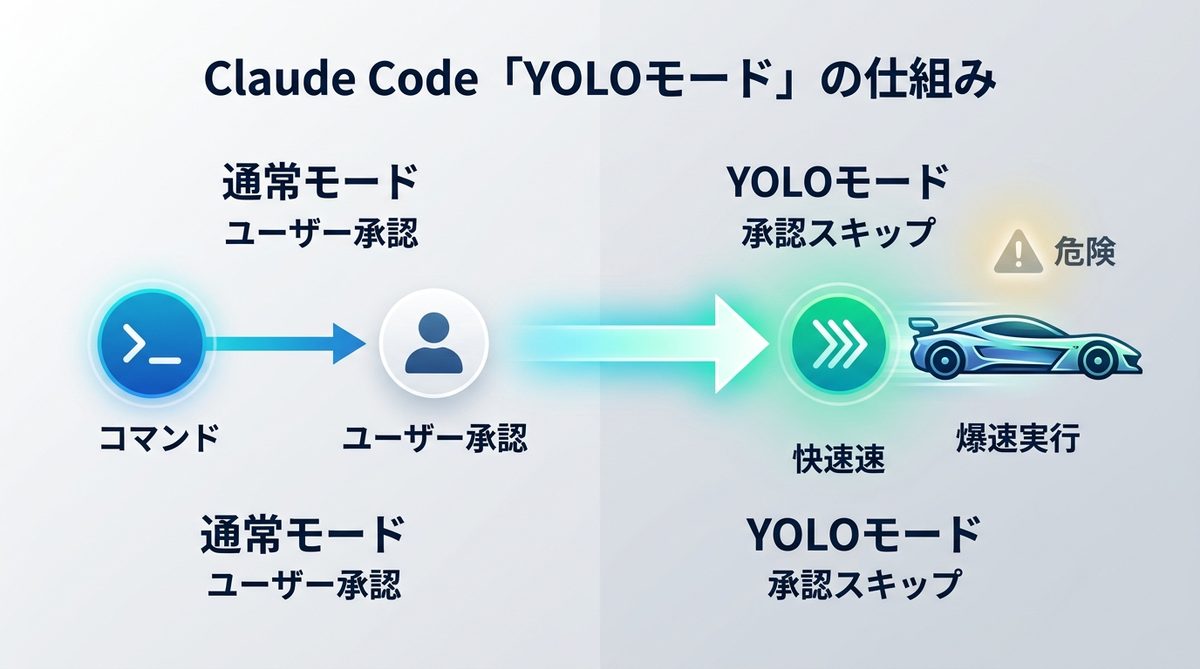

--dangerously-skip-permissions がもたらす「爆速」の仕組み

Claude Codeには、実行時のコマンドやファイル操作に対してユーザーの承認を求めるプロンプト(確認画面)が標準で備わっています。しかし、起動時に --dangerously-skip-permissions フラグを付与することで、この確認プロセスを全スキップし、AIが判断した内容を即座に実行させることが可能です。これにより、人間が都度「Enter」を押す必要がなくなり、開発スピードが飛躍的に向上します。

なぜ公式は「Dangerously(危険)」と名付けたのか?

Anthropicがあえて「危険」と命名した理由は明白です。これは、人間という「ブレーキ」を意図的に取り外す行為だからです。比喩的に言えば、ブレーキのない高速レーシングカーを、免許取り立てのAIに運転させるようなものです。AIが誤った目的地を目指したとしても、止める術(すべ)がありません。

関連記事:【図解で解説】Claude Codeとは?Claude Coworkとの違いと活用事例

ビジネス現場で直面する「YOLOモード」の3つの破壊的リスク

ビジネス現場での利用において、このモードを常用することは、単なる利便性の追求を超えたリスクを招きます。

1. ヒューマンエラー以上の速度で起きる「誤ったファイル操作」

AIは完璧ではありません。文脈の解釈を誤り、重要な設定ファイルやソースコードを「不要なファイル」と見なして削除(rmコマンド)する可能性があります。人間であれば実行直前に気づけるミスも、YOLOモードでは数ミリ秒で完遂され、復旧には多大な工数を要します。

2. 機密情報漏洩と社内インフラへの不正アクセス

AIが環境変数やAPIキーを外部へ送信してしまうリスクは無視できません。不適切なディレクトリに対して「全権限」が許可されている場合、AIが誤って秘匿情報を外部のログやプロンプト内に含めてしまい、情報漏洩を引き起こす可能性がゼロではないのです。

3. 修正不可能なインシデントによる経営インパクトの試算

安易な常用が招く損害を試算すると、以下の通り深刻です。

| 項目 | 損失の内容 |

|---|---|

| 直接コスト | 復旧のためのエンジニア人件費(時給×復旧時間) |

| 間接コスト | リリース遅延による機会損失(顧客信頼度の低下) |

| 経営リスク | セキュリティインシデントに伴うブランドイメージの棄損 |

関連記事:【経営者必見】Claude Code導入の判断基準|APIコストとセキュリティを理解して開発チームに「デジタル社員」を招く方法

なぜAIエージェントには「人間による承認」が必須なのか

効率化を優先するあまり、AIの判断を「丸投げ」することには大きな落とし穴があります。

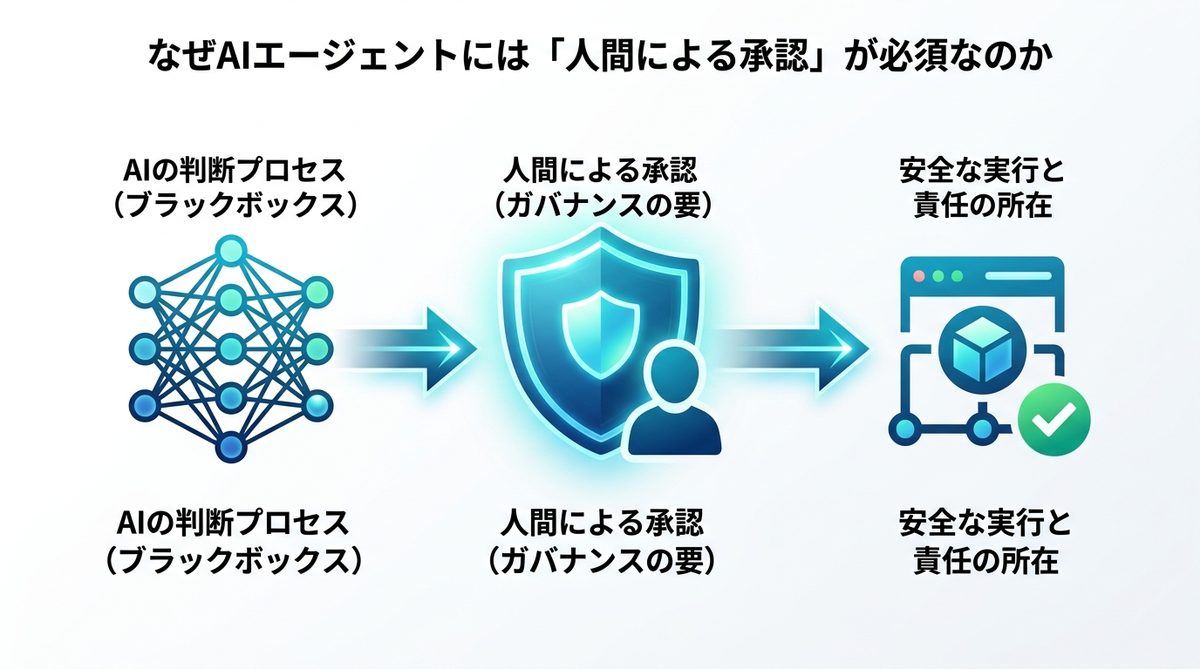

AIの判断プロセスにおける「ブラックボックス」という特性

AIエージェントは非常に高度な推論を行いますが、その内部でなぜそのコマンドを選択したのかという論理構造を人間がリアルタイムで追うことは困難です。AIが「これが最適だ」と判断した操作が、実はシステム全体の依存関係を破壊する行為であるケースも珍しくありません。

AIガバナンスにおける「最後の砦」としての確認プロセス

企業におけるAI活用では、最終的な責任の所在は常に人間にあります。確認プロセスは、単なる手間の発生源ではなく、人間が「AIの出力結果を確認し、責任を負う」というガバナンス(統治)のための防波堤なのです。

関連記事:【エンジニア必見】Claude Code HooksでAIを完全統治する:3つの制御技術と実装レシピ

効率を諦めない!安全な開発環境を構築するための「サンドボックス」活用法

リスクを管理しつつ生産性を高めるためには、隔離された環境(サンドボックス)での運用が不可欠です。

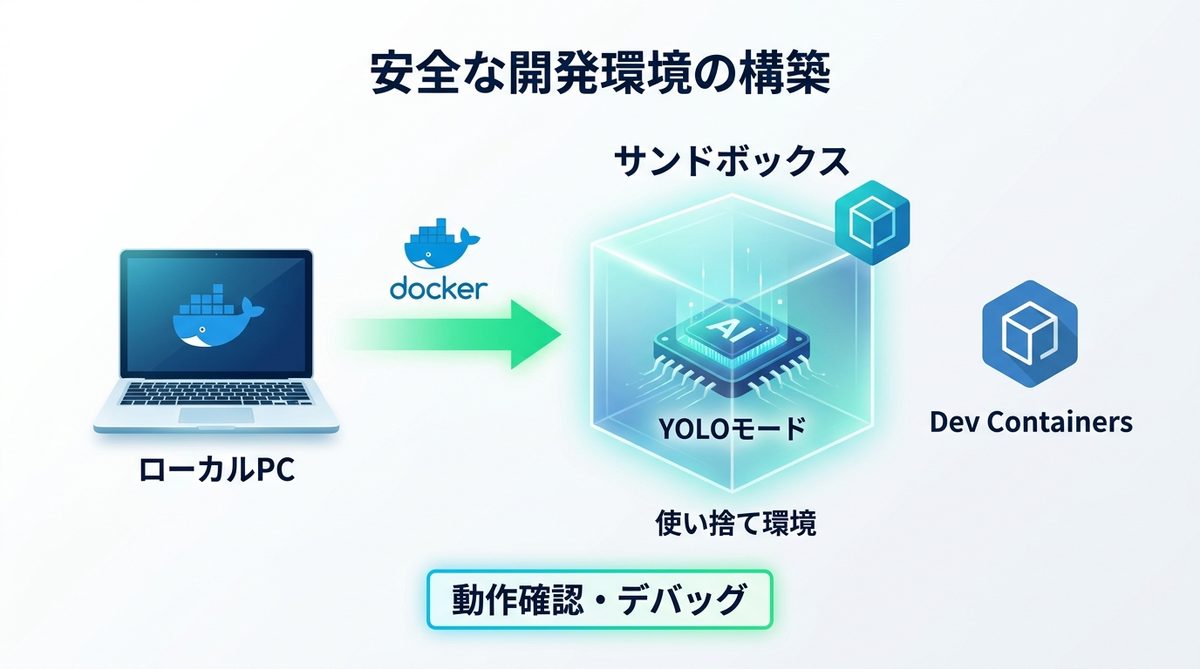

Dev Container / Dockerを活用した「使い捨て」環境の構築

ローカルPCで直接Claude Codeを動かすのではなく、Dev Container(開発用のコンテナ環境)やDocker(コンテナ仮想化ツール)を活用しましょう。万が一AIが破壊的なコマンドを実行しても、影響をコンテナ内に留めることができ、環境を再構築するだけで解決します。

YOLOモードを活用すべき「唯一の条件」とは

このフラグの使用が許されるのは、「破棄前提の隔離された環境で、且つ動作確認(デバッグ)を行っている時」に限るべきです。本番環境や機密情報を含むレポジトリでの常用は、推奨される運用ルールから逸脱しています。

関連記事:【初心者向け】Claude CodeをWSL2で最短構築!Windows環境の生産性を劇的に変える導入ロードマップ

AIエージェントを安全に運用するための組織的ガバナンス策

ツール導入は「爆速」と「防衛」のバランス調整です。組織として以下のルールを徹底しましょう。

チームで共有すべき「AIエージェントの利用ガイドライン」の作り方

エンジニアチーム全体で、以下のルールを策定してください。

* 権限スキップは原則禁止とする

* 利用する場合は管理者の承認を得た隔離環境を使用する

* AIの操作ログを定期的(週次など)にピアレビューする

ツール導入は「利便性」と「リスク許容度」のバランス調整

経営層やテックリードは、AI導入による工数削減(週20時間→ほぼ全自動化など)というメリットと、今回挙げたリスクを天秤にかけ、自社に適したガイドラインを明文化してください。

関連記事:【企業導入ガイド】Claude CodeをAWS Bedrockで安全に動かすための環境構築術

まとめ

Claude CodeのYOLOモードは非常に強力ですが、無防備な利用は企業にとって大きな脅威となります。安全なAI活用に向けた要点は以下の通りです。

- 権限スキップのリスクを直視する: AIの判断ミスは数秒でシステム破壊を招く。

- サンドボックス環境を必須化する: Docker等の隔離環境で影響範囲を限定させる。

- AIガバナンスを組織で定義する: 責任あるAI活用に向けた利用ガイドラインを策定する。

まずは隔離された開発環境を整え、技術的な安全性とスピードの両立を目指しましょう。今すぐ貴社のAI運用ルールを見直し、責任あるAI開発の第一歩を踏み出してください。