【徹底比較】OpenClawとQwen 3.6の組み合わせが「最強の選択肢」と言われる3つの理由

AIエージェントの活用は「検証フェーズ」から「実運用フェーズ」へと急速にシフトしています。しかし、商用APIへの依存によるコストの高騰や、機密情報の流出リスクに頭を悩ませる企業は少なくありません。

本記事では、2026年現在最も注目されている「OpenClaw + Qwen 3.6」という技術スタックを活用し、コストを極限まで抑えつつ安全にAIエージェントを運用する戦略を解説します。

目次

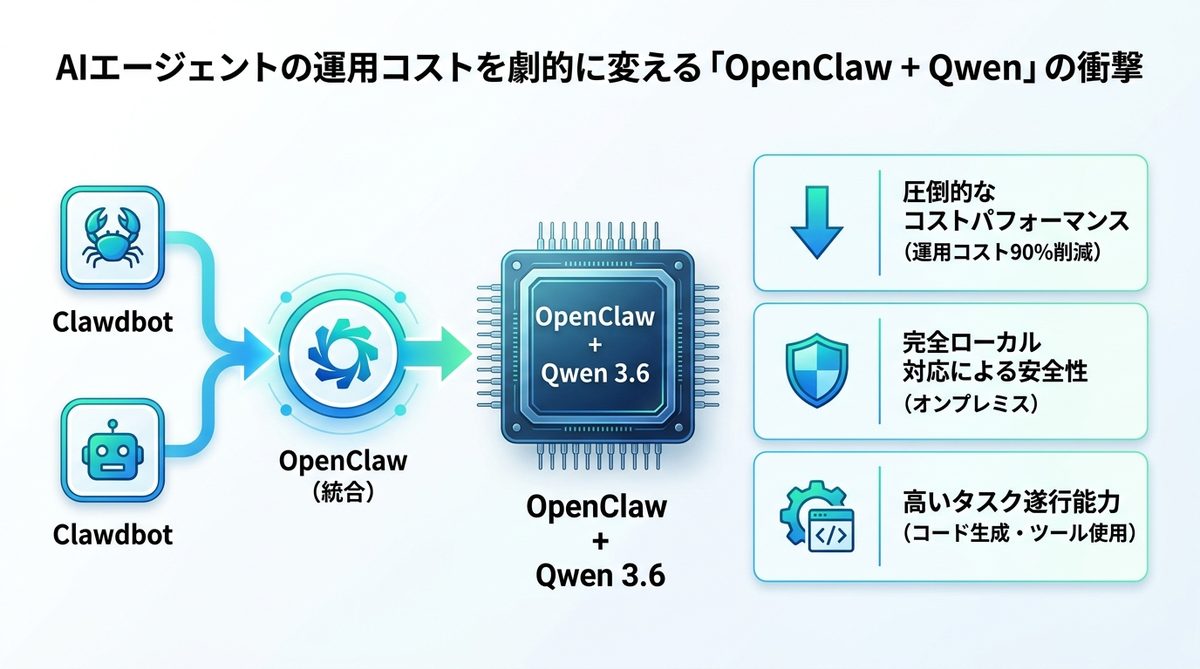

AIエージェントの運用コストを劇的に変える「OpenClaw + Qwen」の衝撃

自律型AIエージェントの運用において、最も大きな壁となるのが「推論コスト」と「環境構築の手間」です。この二つを同時に解決する解として、OpenClawとQwenの組み合わせが注目を集めています。

なぜ「OpenClaw + Qwen 3.6」が2026年の覇権スタックなのか

OpenClawとQwen 3.6の組み合わせが最強と言われる理由は、以下の3点に集約されます。

- 圧倒的なコストパフォーマンス: 商用APIモデルと比較して、運用コストを最大90%削減可能です。

- 完全ローカル対応による安全性: 外部サーバーに情報を送ることなく、自社内の閉じた環境(オンプレミス)でAIを完結させられます。

- 高いタスク遂行能力: Qwen 3.6の最新モデルが、コード生成やツール使用において商用モデルに肉薄する性能を誇ります。

ClawdbotとMoltbotの統合がもたらした開発環境の簡略化

かつてこの分野では「Clawdbot」や「Moltbot」といったツールが乱立し、ユーザーを迷わせていました。しかし、2026年1月にこれらが「OpenClaw」へと統合されたことで、技術的な断片化が解消されました。現在のOpenClawは、OSS(オープンソースソフトウェア)として高い安定性を備えており、導入の迷いは完全に払拭されたと言えるでしょう。

関連記事:【2026年最新】OpenClawとは?AIエージェントの仕組みと、安全に業務導入する「NemoClaw」活用ガイド

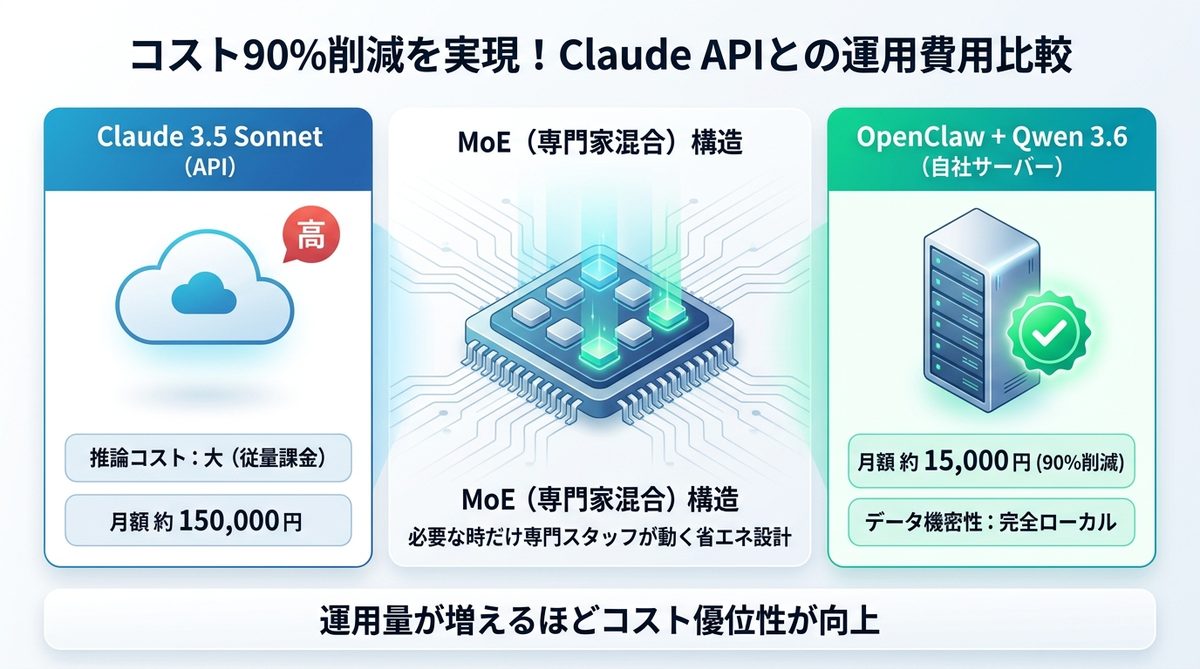

コスト90%削減を実現!Claude APIとの運用費用比較

経営層が最も懸念する「AI導入のROI(投資対効果)」において、この構成は極めて強力な武器となります。

24時間稼働エージェントの月額運用コストを試算する

仮に、開発チームが24時間体制でAIエージェントを稼働させた場合のコストを比較してみます。

| 比較項目 | Claude 3.5 Sonnet (API) | OpenClaw + Qwen 3.6 (自社サーバー) |

|---|---|---|

| 推論コスト | 大 (従量課金) | 小 (電力・サーバー費のみ) |

| 月額概算コスト | 約 150,000円 | 約 15,000円 (90%削減) |

| データ機密性 | クラウド送信 | 完全ローカル (外部遮断可能) |

※試算条件:1日あたりのトークン消費量を一定とした場合の比較。クラウド費用の変動が大きく、運用量が増えるほどローカル実行のコスト優位性はさらに高まります。

なぜQwen 3.6の「MoE 35B-A3B」構造はエージェント運用に最適なのか

Qwen 3.6に採用されている「MoE(Mixture of Experts:専門家混合)」構造は、AIにとって非常に効率的な仕組みです。これを比喩で表すなら、「全知全能の教授を1人雇うのではなく、必要な時だけ専門のスタッフが立ち上がるオフィス」のようなものです。

35B-A3B(350億パラメータのMoEモデル)は、アクティブな頭脳のみを動かすため、推論速度が速く、かつ消費エネルギー(=コスト)を劇的に低減できます。AIエージェントが何度も思考を繰り返すような複雑なタスクにおいて、この「省エネで賢い」構造が大きな利益を生みます。

関連記事:【徹底比較】Qwen3.6 vs Claude Opus 4.7|APIコストを激減させる業務活用ポートフォリオの作り方

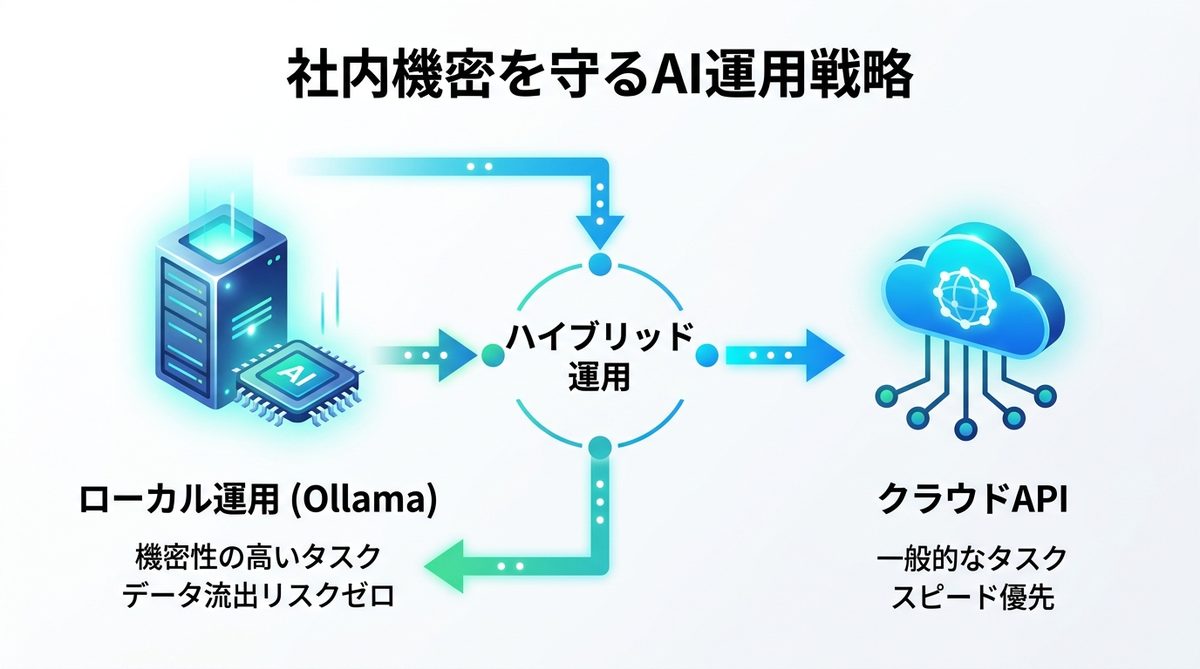

ローカル実行とクラウドAPIの使い分けで守る「社内機密」

AIをビジネスに導入する際、セキュリティは妥協できない領域です。

開発環境を外部に出さない!完全ローカル運用のメリット

OpenClawをOllama(ローカルAI実行ツール)と組み合わせれば、PCや社内サーバーの内部だけでAIを完結させられます。これにより、顧客データや社内の独自ソースコードが外部に送信されるリスクをゼロにすることが可能です。

機密レベルに応じたハイブリッド運用(クラウドAPIとローカルの切替)の手順

すべてをローカルで行う必要はありません。重要度に応じて柔軟に切り替えるのが、賢い運用戦略です。

- 機密性の高いタスク: ローカル環境のQwen 3.6で実行(完全隔離)

- 一般的なコード補完: クラウドAPI(OpenClaw Cloud等)を利用し、推論スピードを優先

このハイブリッド運用により、セキュリティと利便性のバランスを高度に維持できます。

関連記事:【2026年版】ローカル生成AIの始め方|PCスペック判定表とおすすめソフト徹底解説

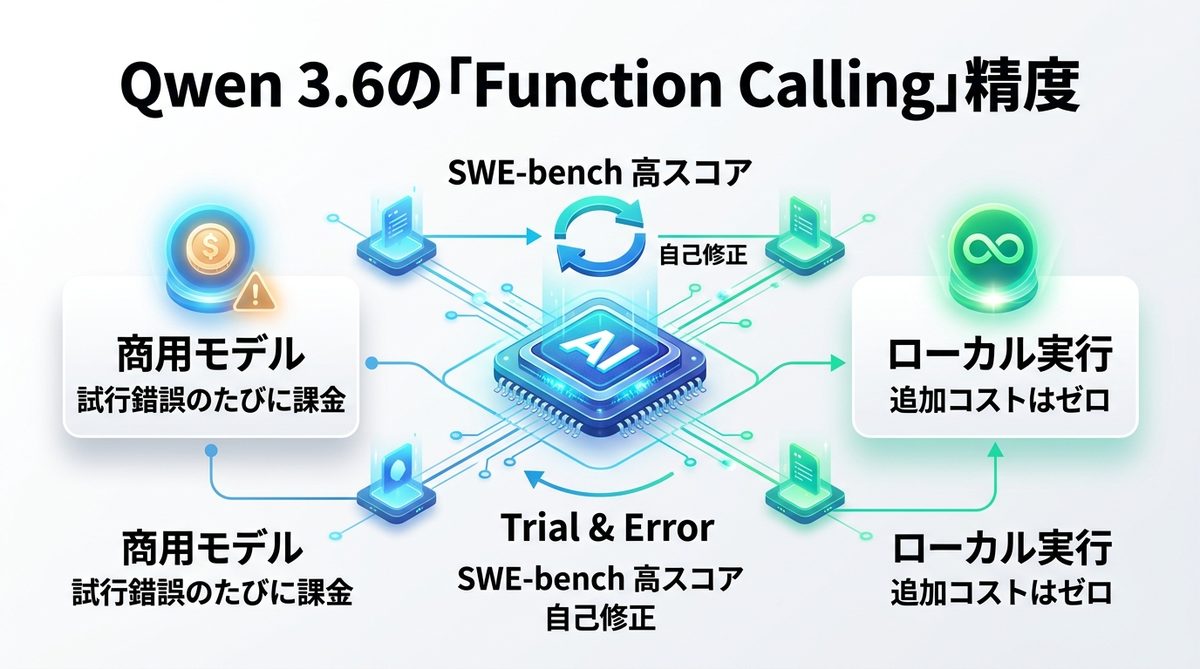

Qwen 3.6の「Function Calling」精度は商用モデルに勝てるのか

「オープンモデルは頭が悪いのでは?」という懸念は、もはや過去のものです。

SWE-benchで証明された実務におけるツール使用能力

Qwen 3.6は、エンジニアリング能力を測定するベンチマーク「SWE-bench」において、商用モデルと遜色のないスコアを叩き出しています。特に、エージェントが自分でファイルを操作し、デバッグを行う「Function Calling(外部ツール呼出)」の精度が高く、指示通りの挙動を期待できるレベルに到達しています。

AIエージェントが「試行錯誤」を繰り返してもコストが跳ね上がらない理由

AIエージェントは、エラーを出すたびに自己修正を繰り返します。商用APIであれば、その試行錯誤のたびに課金が発生します。しかし、ローカル実行であれば、いくら思考を繰り返しても追加コストはゼロ。この「コストを気にせず失敗できる環境」こそが、AIの精度を向上させる一番の近道なのです。

関連記事:【徹底比較】Qwen3.6 vs Qwen3.5の違いを徹底分析|長期自律エージェントに求められる性能向上とは

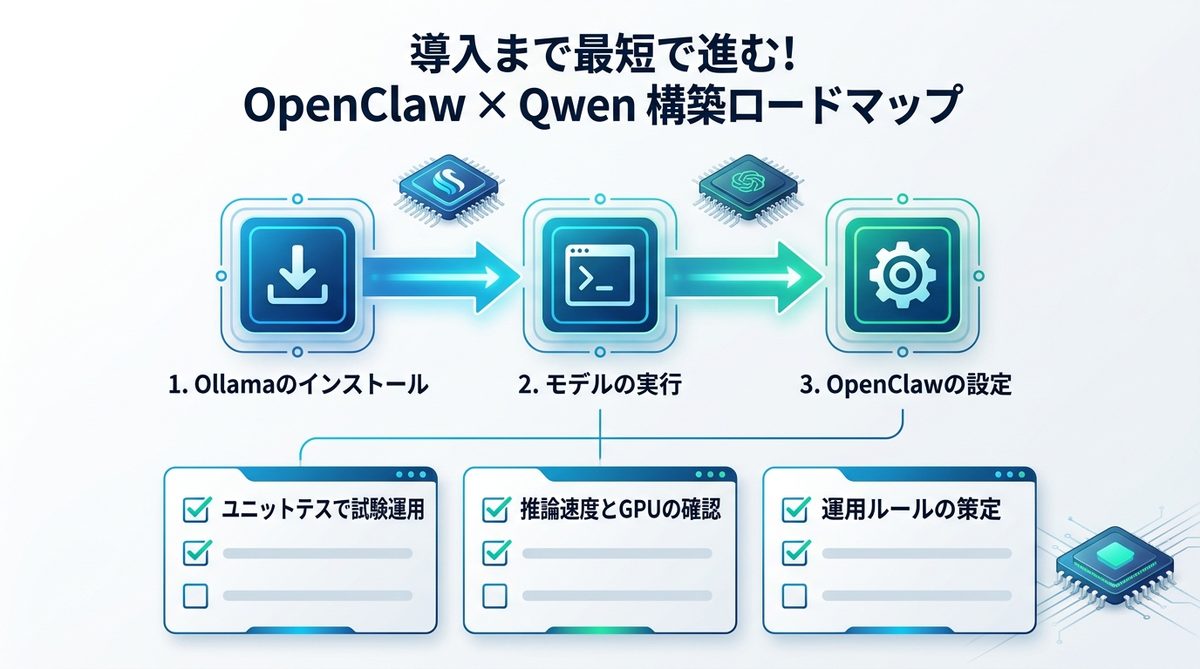

導入まで最短で進む!OpenClaw × Qwen 構築ロードマップ

導入のハードルは驚くほど低くなっています。

コマンド1行で接続完了!Ollama環境を活用した導入手順

- Ollamaのインストール: 公式サイトからツールをダウンロードします。

- モデルの実行: ターミナルで

ollama run qwen3.6を実行します。 - OpenClawの設定: OpenClawの設定ファイルでエンドポイントを

http://localhost:11434に指定するだけです。

PoC(概念実証)から本格運用へ移行するためのチェックリスト

- [ ] 特定の小さなタスク(ユニットテスト作成など)でOpenClawを試験運用する

- [ ] ローカル環境での推論速度を計測し、必要に応じてGPUリソースを増強する

- [ ] チームメンバーへ「機密情報はどこまで入力して良いか」の運用ルールを策定する

関連記事:【2026年最新】OpenClaw導入設定マニュアル|初期構築からチャット連携・エラー解決まで完全網羅

まとめ

OpenClawとQwen 3.6の組み合わせは、2026年時点におけるAIエージェント活用の最適解です。本記事のポイントは以下の通りです。

- コスト90%削減: 従量課金型のAPIから脱却し、圧倒的なコスト効率を実現する

- セキュリティの確保: ローカル環境で実行することで、機密漏洩リスクを最小化する

- 高い性能: Qwen 3.6のMoE構造が、安価かつ高精度なエージェント運用を可能にする

今すぐOllamaをインストールし、まずは小さなタスクからOpenClawの構築を始めてみてください。運用コストを削減しながら、自社独自の強力なAIエージェントチームを構築しましょう。