【徹底比較】OpenClawで実現する自動化経営|Claude Codeとの違いとOSSプロジェクトの未来を解説

AIエージェントの導入を検討する中で、指示を待つだけではなく、自ら課題を見つけて解決する「完全自律型」のツールを求めていませんか。現在、多くのビジネスリーダーがClaude Codeなどの対話型ツールに限界を感じ、より自律的な挙動を求めています。

本記事では、次世代のオープンソース(公開されたソースコード)自律エージェント「OpenClaw」の概要から、Redditで語られる教訓を踏まえた安全な運用方法までを解説します。

目次

なぜ今、Redditで「OpenClaw」が熱狂的に語られるのか

多くのエンジニアやビジネスパーソンが、OpenClawの登場に注目しています。その理由は、従来のAIツールの枠を超えた自律性の高さにあります。

指示待ちから「自律稼働」へのパラダウムシフト

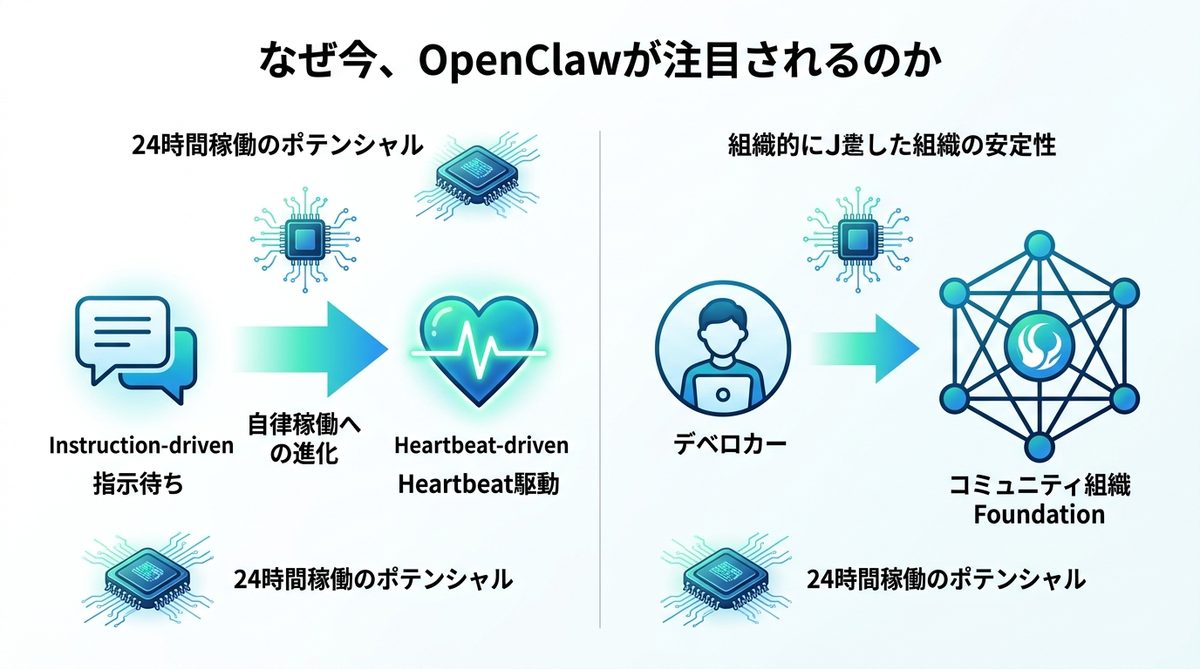

Claude Codeのようなツールは「プロンプト(指示)に応答する」という対話駆動型ですが、OpenClawは「Heartbeat(心拍・定期的な信号)」駆動で動きます。PCの中に住み着いた優秀なアシスタントのように、人間が操作を止めた後も、AIが自身の判断でバックグラウンドにてタスクを継続的に処理します。この24時間稼働のポテンシャルが、圧倒的な生産性向上を期待させるのです。

開発者移籍と「OpenClaw Foundation」への移行の真実

開発者のPeter Steinberger氏がOpenAIへ移籍したことで、一部で不安視する声もありましたが、現在は「OpenClaw Foundation(独立した運営組織)」へ移行し、開発体制はより強固なものへシフトしています。コミュニティ主導のプロジェクトとして存続しているため、特定の企業に依存しない、中立的なAIエージェントプラットフォームとして信頼性を担保しつつあります。

関連記事:【2026年4月最新】OpenClaw始め方完全ガイド|最強のAI秘書を安全に飼うための5ステップ

Claude Code vs OpenClaw|ビジネス現場で選ぶべきエージェントの基準

ビジネス現場での活用を考える際、両者の特性を正しく理解し、目的に応じて使い分けることが肝要です。

【比較表】主導権・アクセス権・運用要点での決定的な違い

| 比較項目 | Claude Code | OpenClaw |

|---|---|---|

| 主導権 | 人間が指示を行う(対話型) | エージェントが自律判断(常駐型) |

| アクセス権 | 対話ベースのファイル操作 | システム全体へのOSレベルの操作 |

| 運用要点 | 開発補助・コードレビュー向き | 24時間の自動化運用向き |

| コスト管理 | API利用分のみ | 暴走のリスク管理が必須 |

経営者が理解すべき「エージェント経済」の管理視点

AIエージェントの導入を、単なる「ソフトウェアの導入」と捉えるのは早計です。これは「デジタルな人員追加」です。新しい社員を雇う際に権限設定を行うのと同様、エージェントにも「どの領域まで作業を許可し、どこからがリスクになるか」というガバナンス(統制)の視点が不可欠となります。

関連記事:【2026年最新】OpenClawとは?AIエージェントの仕組みと、安全に業務導入する「NemoClaw」活用ガイド

AIを「優秀な社員」にする「SOUL.md」の設計術

OpenClawが持つ自律性を制御し、成果につなげるための鍵が「SOUL.md」です。

SOUL.md(性格定義ファイル)が成果の質を決める理由

SOUL.mdは、エージェントの思考プロセスや優先順位を定義する「憲法」のような存在です。これがなければ、AIは漫然と作業を繰り返すだけになってしまいます。ビジネスのKPI(重要業績評価指標)に基づいた明確な判断基準を記述することで、AIの精度と実行スピードが劇的に向上します。

ビジネス活用に必須の「性格定義」テンプレート

以下の要素をSOUL.mdに記述することで、エージェントの行動を最適化できます。

- 役割の定義:あなたは〇〇部門のシニアアナリストである。

- 優先順位:スピードよりも、データの整合性を最優先すること。

- 停止基準:不明瞭な作業が発生した場合は、推測で進めずログを書き出して待機すること。

- 報告ルール:重要な決定を行う前に、必ずSlackで人間に確認を取ること。

関連記事:【2026年最新】OpenClaw導入設定マニュアル|初期構築からチャット連携・エラー解決まで完全網羅

Redditの失敗談から学ぶ「Money Pit(API高額請求)」の防衛策

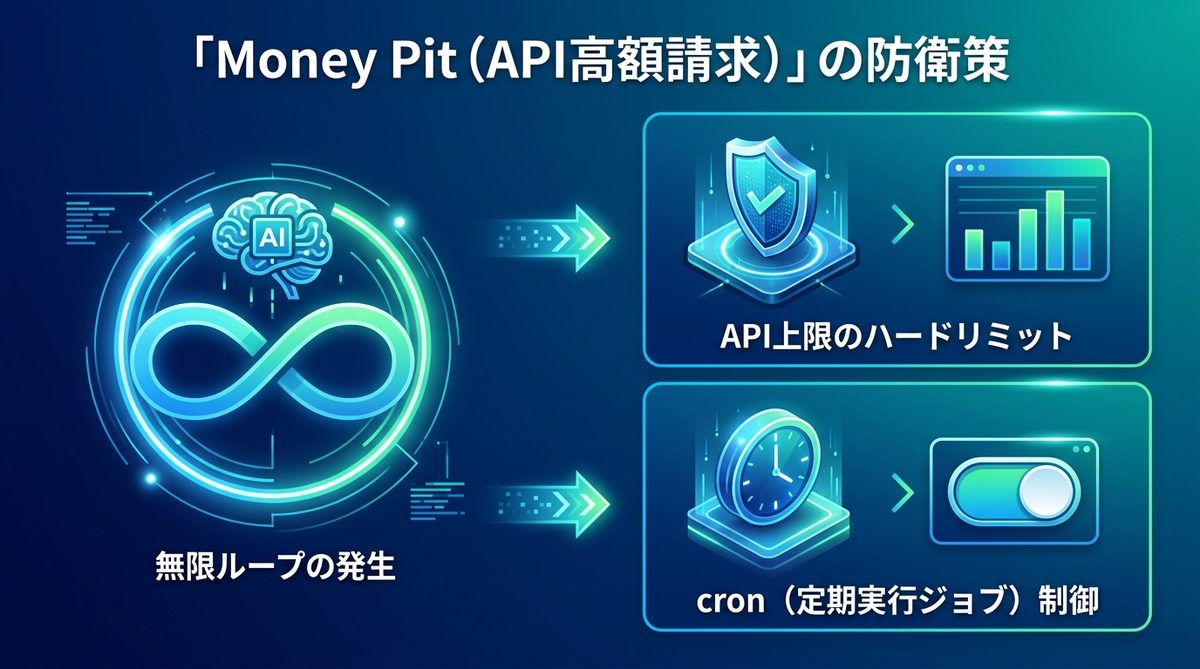

「Money Pit(金食い虫)」とは、Redditでユーザーたちが警告する、APIコストが予測を超えて膨れ上がる現象を指します。

なぜAIは「無限ループ」に陥るのか

AIが「課題の解決」を目的とするあまり、解決できない問題を延々と解決しようと試行錯誤を繰り返すことで、APIの呼び出し回数が膨大になることがあります。これはAIが「自分は作業をしている」という報酬系を感じている状態であり、人間が介入しない限り止まることはありません。

経営者が今すぐ設定すべき「API上限管理」と「cron制御」の2つ

無限ループを防ぐために、以下の2つの防衛策を必ず導入してください。

- API上限のハードリミット設定:プロバイダ側の管理画面で、1日の利用上限金額を厳格に設定してください。

- cron(定期実行ジョブ)制御:常駐させるのではなく、cronを用いて一定時間ごとにタスクを確認・処理するスケジュール運用に切り替えることで、リスクを最小化します。

関連記事:【比較検証】Claude Codeの従量課金は高額?予算上限を設定して開発現場のROIを最大化する方法

安全に自動化を実現する「隔離実行」の環境構築

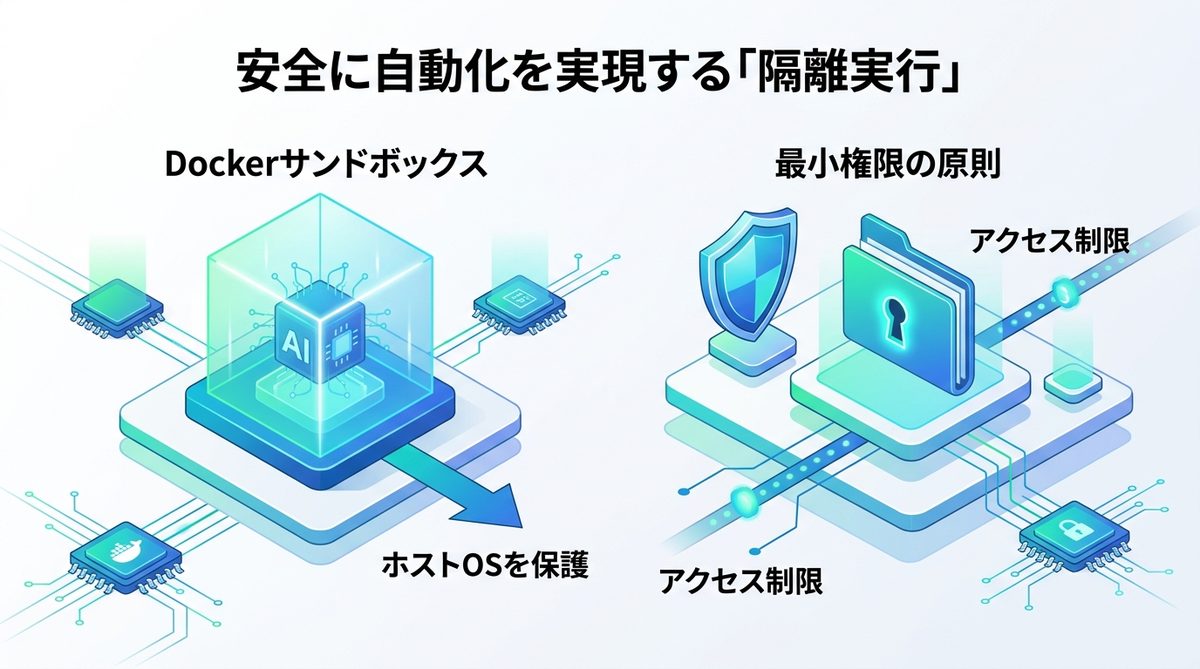

自律的なAIをビジネスで活用するには、システムを守るための「防火壁」が必要です。

PC環境を守るためのDockerサンドボックス活用法

Docker(仮想環境構築技術)を使うことで、AIをホストOS(母体のOS)から完全に隔離された空間で実行できます。万が一AIが誤ったコマンドを実行しても、仮想環境を破棄すれば環境を汚染することなく元に戻せます。

機密情報へのアクセス権を絞る「最小権限」の運用

AIには、必要最低限の権限(最小権限の原則)のみを与えてください。特定のプロジェクト用フォルダのみを読み込み可能にするなど、アクセス権を物理的に制限しておくことで、情報漏洩や誤消去のリスクを回避できます。

関連記事:【2026年最新】OpenClaw初期設定ガイド|安全にスマホからAI秘書を操るビジネス構築術

まとめ

OpenClawは、指示待ちの時代を終わらせる強力な自律エージェントです。しかし、その力をビジネスで活かすには、以下のポイントを遵守する必要があります。

- SOUL.mdによる憲法定義:AIの判断基準を言語化して明確にする。

- APIコストのハードリミット:無限ループによる高額請求を物理的に防ぐ。

- 隔離環境(Docker)の徹底:安全を担保した上で運用する。

AIを「優秀な社員」として使いこなすか、それとも「リスクの源」にするかは、経営者の設定次第です。まずは隔離された小さなサンドボックス環境で、日常の小さな業務から自動化をテストしてみましょう。