【ローカルAI入門】Gemma 4の使い方|PC環境で高性能モデルを動かす4ステップ

社内の機密情報を扱いたいけれど、クラウド上のAIサービスにデータを送信することには強い抵抗がある――。そんなビジネスパーソンの悩みを解決するのが、Googleが提供するオープンモデル「Gemma 4」です。

本記事では、プログラミングや複雑なコマンド操作を必要とせず、誰でも自分のPC環境に高性能なAIを導入し、商用活用するための具体的な手順を解説します。

目次

なぜ今、ビジネス現場で「Gemma 4」のローカル実行が必要なのか

AI活用の波が押し寄せる中、多くの企業が直面しているのが「セキュリティ」と「コスト」の壁です。これらを打破する手段が、外部サーバーを介さない「ローカルAI(自分のPC内で完結するAI)」の活用なのです。

APIコストゼロ・情報漏洩リスクゼロの圧倒的メリット

クラウド型のAIサービスを利用する場合、入力データが外部サーバーへ送信されることが一般的です。しかし、Gemma 4であれば、インターネットから切り離された環境でも動作するため、以下のようなビジネス上のメリットが得られます。

- 機密保持の最大化: 顧客データや未公開の企画書など、外部に出せない情報を安全に処理できます。

- ランニングコストの削減: API(アプリケーション・プログラミング・インターフェース)利用料を気にすることなく、何度でも無制限にAIを稼働させられます。

- 商用利用が可能: Googleが提供するGemma 4はライセンス条項に従うことで商用活用が認められています。

PCの中に「優秀な専属アシスタント」を住まわせる感覚

ローカルAIは、いわばPCの中に極めて優秀な「専属の知識労働者」が住み着いている状態です。会議の議事録作成から複雑な契約書のドラフト作成まで、PCが起動している限り、専属アシスタントがいつでもあなたの指示を待っているのです。この環境構築は、将来的に自社独自のAIエージェントチームを組成するための最初の登竜門となります。

関連記事:【2026年版】生成AI導入の決定版:自社PC vs クラウドGPU 失敗しない選び方と投資基準

Gemma 4を導入する前に!4つのサイズとPCスペックの目安

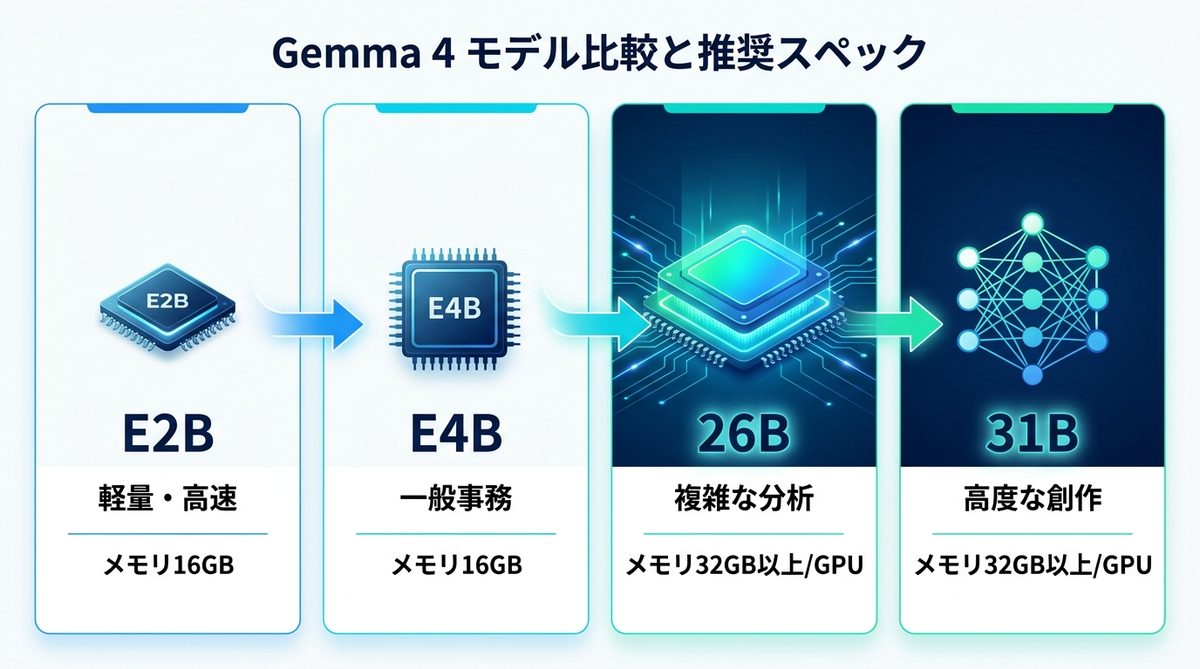

Gemma 4は、用途やハードウェアの性能に合わせて選べる4つのモデルサイズを展開しています。まずは自身の環境に最適なモデルを見極めましょう。

【比較表】E2Bから31Bまで、業務に合わせて選ぶモデルの基準

モデル名の「B」は「Billion(10億)」の略で、パラメータ数(AIの頭の良さ)を示します。

| モデルサイズ | 推奨用途 | 特徴 |

|---|---|---|

| E2B | 軽量・高速なタスク | メモ作成や要約などの簡易業務に最適 |

| E4B | 一般事務・チャット | 汎用的な回答精度と速度のバランスが良い |

| 26B | 複雑なデータ分析 | 専門的な推論や論理的思考が必要な業務に |

| 31B | 高度な創作・分析 | 最高峰の賢さを求めるクリエイティブワーク |

あなたのPCで動く?快適に動作させるためのハードウェア要件

ローカルAIはPCの「メモリ(RAM)」と「GPU(画像処理装置)」の性能を強く求めます。

- ビジネスノートPC(メモリ16GB程度): E2BまたはE4Bを快適に動作可能です。

- クリエイティブ用PC(GPU搭載・メモリ32GB以上): 26Bや31Bモデルをスムーズに実行でき、より複雑な推論をこなせます。

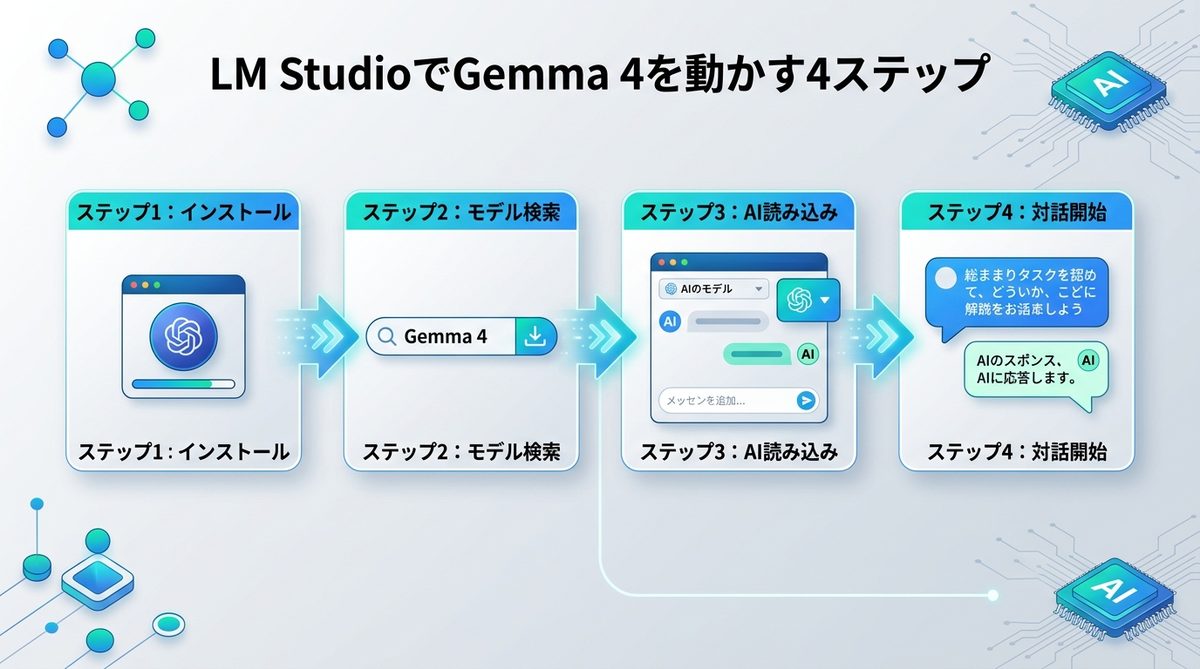

【完全ガイド】エンジニア不要!LM StudioでGemma 4を動かす4ステップ

ここでは、最も直感的に操作できるGUI(グラフィカル・ユーザー・インターフェース)ツール「LM Studio」を使った導入手順を解説します。

ステップ1:LM Studioのインストール

公式サイト(lmstudio.ai)へアクセスし、お使いのOS(Windows/Mac)に合わせたインストーラーをダウンロード・実行します。特別なコード入力は不要です。

ステップ2:モデルの検索とダウンロード

アプリ内の検索窓に「Gemma 4」と入力します。表示されたリストの中から、自身のPCスペックに合わせたサイズを選択し「Download」ボタンをクリックするだけです。

ステップ3:AIの読み込みと実行

左側のアイコンから「AI Chat(チャット)」画面を開き、上部のモデル選択プルダウンから先ほどダウンロードしたGemma 4を指定します。

ステップ4:プロンプトによる対話開始

チャット欄に「昨日の会議議事録を要約して」のように入力すれば、即座にAIが回答を開始します。これだけでPC内でのプライベートなAI環境が完成しました。

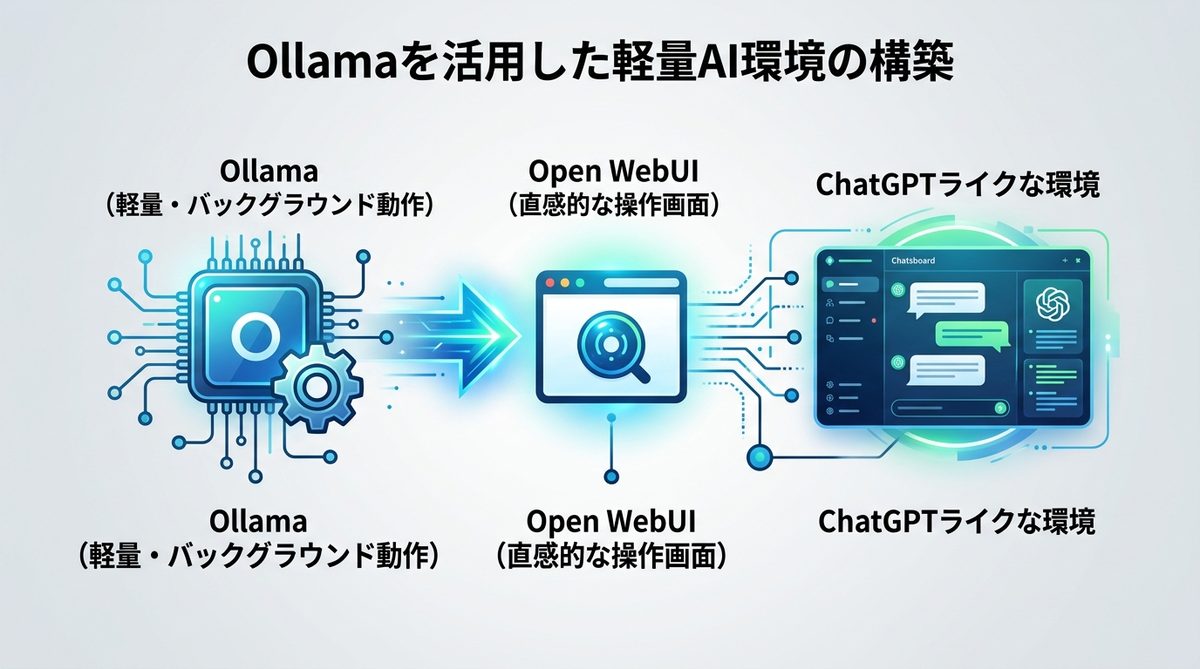

もう一つの選択肢!Ollamaを活用した軽量AI環境の構築

LM Studioよりもさらに軽量で、他のアプリとの連携に長けたツールが「Ollama」です。

なぜOllamaが選ばれるのか?シンプルさを追求した導入法

Ollamaはバックグラウンドで静かに動作するツールです。PCのリソース消費が極めて少なく、常駐させておいてもPCが重くなりにくいという特徴があります。シンプルさを追求し、AIを「OSの一部」のように使いたい方に最適です。

UIツールと連携させて「ChatGPTライク」な環境を作る

Ollama自体には画面がないため、「Open WebUI」のようなブラウザベースのUIと組み合わせることで、ChatGPTと瓜二つの洗練された操作環境を構築できます。これにより、社内で複数のメンバーが利用する環境への発展も容易になります。

ビジネス活用を加速させる!Gemma 4の実践的な使い方

導入したGemma 4を使って、実務の効率を飛躍的に高める2つの活用術を紹介します。

社内PDFの読み込みと分析をローカルで完結させる方法

機密資料である「社内規定」や「過去のプロジェクト報告書」をAIに読み込ませることで、瞬時に特定の情報を検索・分析させることが可能です。外部にデータを出さないため、セキュリティ規定を厳守したまま、劇的な時短効果が見込めます。

定型業務の自動化に向けたエージェント開発の第一歩

Gemma 4を核に、特定のタスク(メール返信や月次報告書のドラフト作成など)を自動実行する仕組みを組みましょう。まずは手動でのプロンプト入力から始め、将来的に自動処理スクリプトと連携させることで、AIエージェントチームの構築へとステップアップできます。

関連記事:【2026年最新】生成AIとは何か?AIエージェント時代に乗り遅れないためのビジネス活用ガイド

まとめ

Gemma 4を活用したローカルAI環境の構築は、ビジネスのセキュリティレベルと生産性を同時に高める強力な選択肢です。今回のポイントを振り返ります。

- 機密保持: データを外部送信しないため、情報漏洩リスクがゼロ。

- コスト削減: API利用料不要で、高性能なモデルを無制限に利用可能。

- 選べる性能: E2Bから31Bまで、PCスペックと業務内容に合わせて最適なサイズを選択。

- 簡単導入: LM Studioを使えば、エンジニアでなくても数分でAI環境が完成。

今すぐLM Studioをインストールして、あなた専用のローカルAIを立ち上げ、日々の業務に革新をもたらしましょう。