【2026年最新】FLUX.2でエラーが出る原因と対処法|VRAM不足を即解決する3ステップ

FLUX.2を導入したものの、起動時にOOM(メモリ不足)エラーが発生したり、プロンプトの内容が無視されたりして作業が止まってはいませんか。その悩み、あなたのPC性能が悪いのではなく、モデルの選定や記述方法が環境に合っていないだけかもしれません。

本記事では、FLUX.2が抱える物理的制約を整理し、ローカル環境での最適解からビジネス現場で即戦力となるAPI活用法まで、エラーを回避して生成ワークフローを安定させるための具体的な3ステップを解説します。

FLUX.2のエラー原因「32Bの壁」

最新モデルであるFLUX.2は革命的な性能を誇りますが、同時に非常に高いハードウェア要件を求めてきます。まずは、なぜこれほどエラーが頻発するのか、その構造的な理由を理解しましょう。

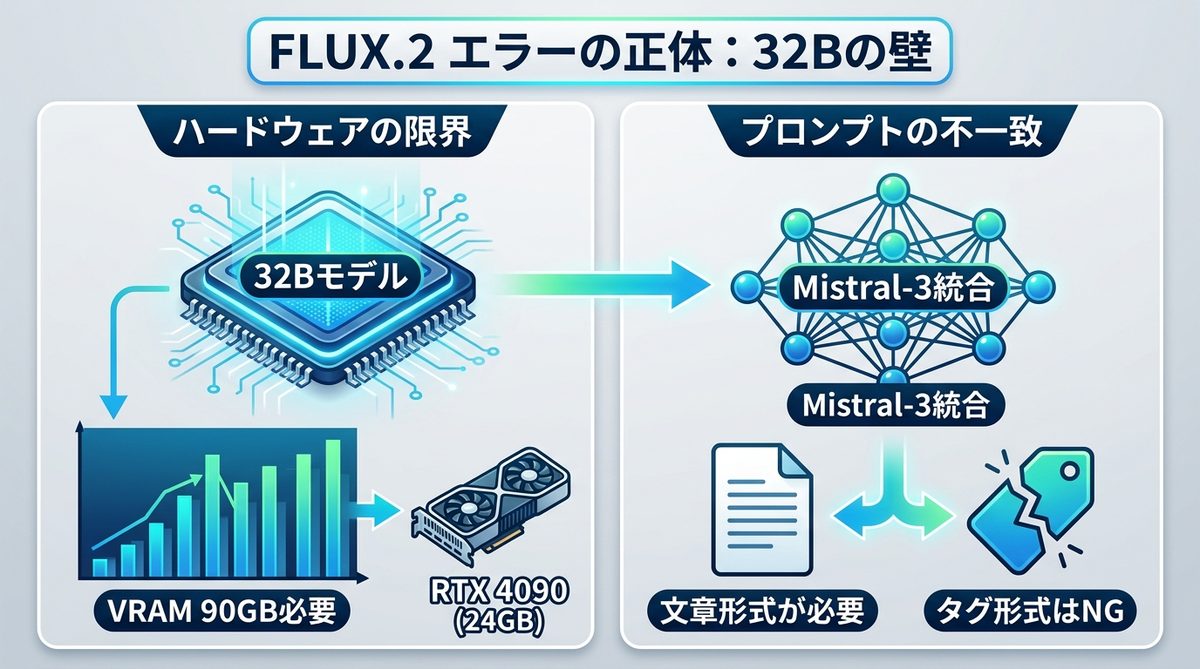

RTX4090でも不足?VRAM90GBの理由

FLUX.2の最高品質モデルである「[dev]」は、32B(320億パラメータ)という超巨大なモデルです。このモデルをFP16(半精度浮動小数点数)でロードする場合、単純計算で90GB以上のVRAM(ビデオメモリ)が必要です。現行の最高峰グラフィックボードであるRTX 4090ですら24GBしか搭載していないため、工夫なしでは起動すらできません。

- [dev]モデル: プロ品質の生成が可能だが、VRAM 90GBが必須。

- 従来の常識: ローカルで動かせていたAIモデルの前提が、FLUX.2では通用しません。

Mistral-3統合による罠

FLUX.2は「Mistral-3」という言語モデルを統合しています。これまでの画像生成AIでは、キーワードをカンマで区切る「タグ形式プロンプト」が一般的でしたが、FLUX.2で同様のことを行うと精度が極端に低下し、プロンプトが無視されるエラーが発生します。これはMistral-3が文章としての文脈理解を前提としているためであり、過去の記述習慣が技術的なミスマッチを引き起こしているのです。

関連記事:【DX最前線】Mistral AIとは?企業が選ぶべき「安全で高コスパ」なAIインフラの正体

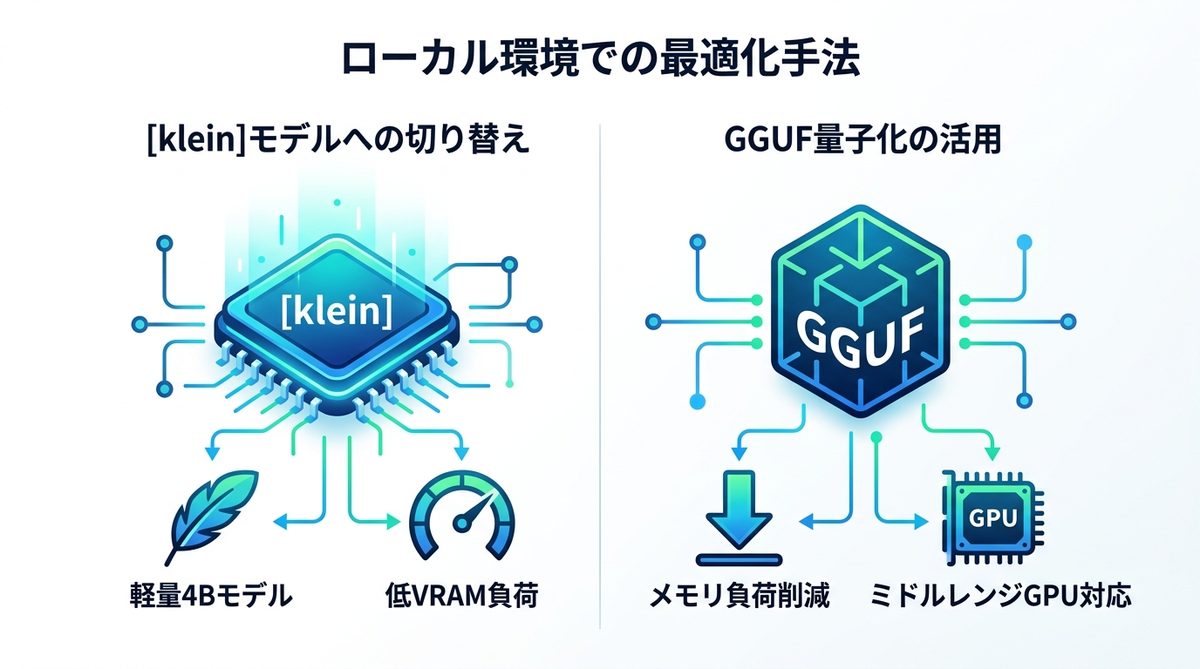

解決策1:ローカル環境の最適化手法

ローカル環境での実行にこだわりたい場合、モデルの軽量化が不可欠です。ビジネス現場で現実的に採用できる最適化手法を解説します。

最適解[klein]モデルへの切替

「[klein]」は、4B(40億パラメータ)の軽量モデルで、Apache 2.0ライセンスで提供されています。8GBから12GB程度のVRAMがあれば十分に動作するため、一般的なクリエイター向けPCでも安定した生成が可能です。

- 導入メリット: VRAM負荷が劇的に低下し、生成時間が短縮される。

- 注意点: [dev]モデルと比較すると細部の書き込みは控えめになりますが、ビジネス現場でのラフ作成やプロトタイピングには十分な性能です。

GGUF量子化による負荷削減

ローカル派のエンジニアやクリエイターには、モデルを「GGUF(量子化ファイル形式)」に変換・利用する方法を推奨します。モデルを圧縮することで、RTX 3060から4070といったミドルレンジGPUでもFLUX.2の挙動を再現できます。メモリ使用量を抑えつつ、モデルの論理的な性能を最大限に引き出すための必須技術です。

関連記事:【2026年最新】生成AI向けGPUおすすめスペック比較:失敗しないPC選びの決定版

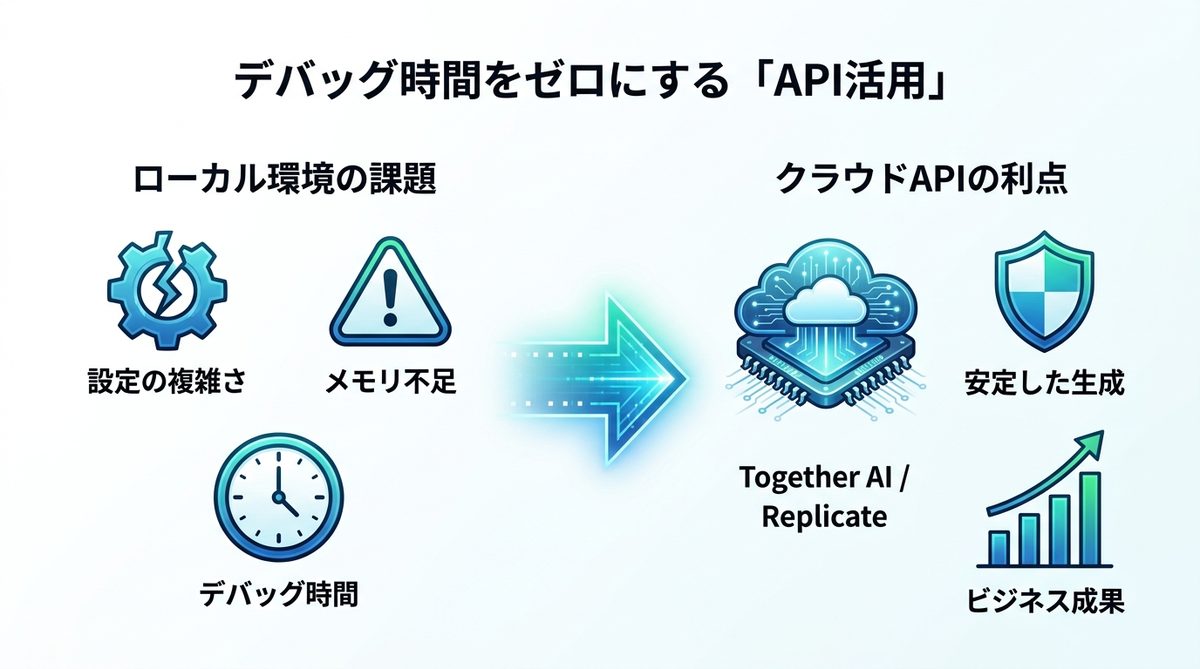

解決策2:API活用による安定化

ローカル環境の構築やデバッグに時間を溶かすことは、ビジネスにおいて大きな機会損失です。なぜ今、多くのプロがクラウド環境へ移行しているのかを解説します。

ローカル環境のデバッグは損失

ハードウェアの設定やライブラリの互換性、メモリ不足の解消に週に何時間も費やしていませんか。もし画像生成が業務の一部であるなら、環境構築にこだわるよりも、安定した環境で「結果」を出すことにリソースを割くべきです。APIを活用すれば、設定作業は不要になり、即座に生成プロセスを開始できます。

クラウドによる安定ワークフロー

Together AIやReplicateといったクラウドプラットフォームを利用すれば、ローカル環境で発生していたOOMエラーとは無縁です。特にマルチリファレンス(複数の画像参照)を伴う複雑な生成では、クラウドの潤沢なVRAMが安定した一貫性を保証します。

関連記事:【2026年最新】生成AI API導入の実戦ガイド|コスト・リスク・運用を最適化する実装戦略

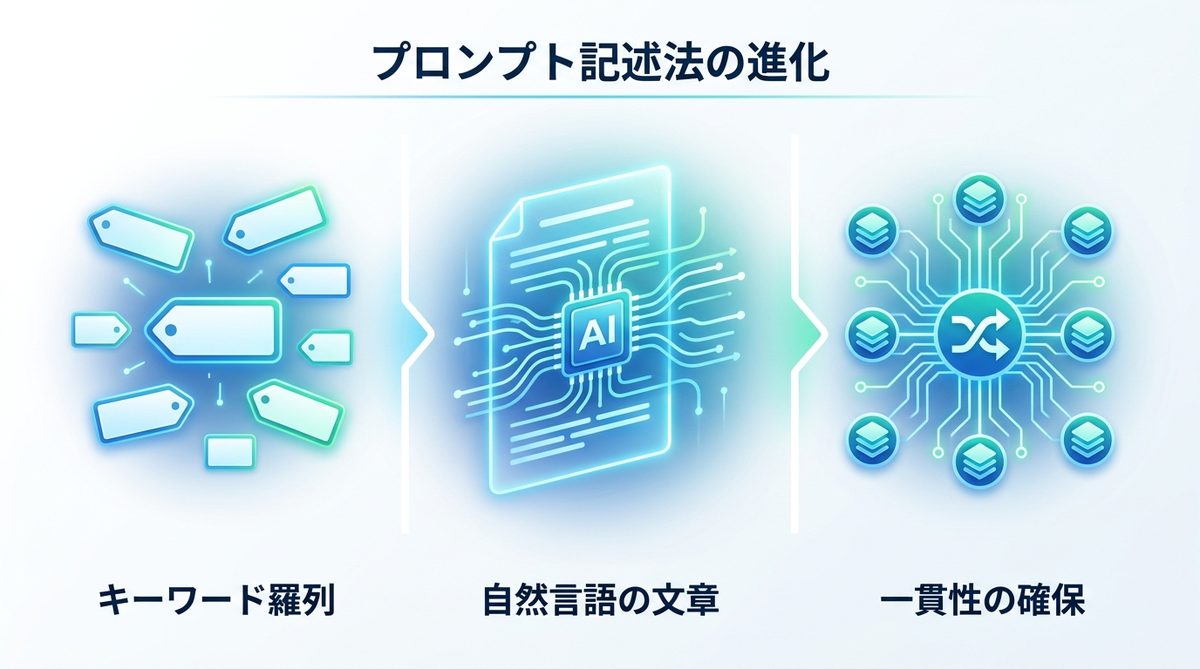

FLUX.2の自然言語プロンプト記述法

FLUX.2の実力を発揮させるには、AIに対する指示出し(プロンプト)のスタイルを変える必要があります。

文章プロンプトへの移行

Mistral-3の言語能力を活かすために、これまでのタグ形式を捨て、自然な文章で状況を記述してください。「高品質、写実的、夜の街」と書くのではなく、「夜の東京の街角、雨に濡れたアスファルトに街灯の光が反射している、映画のようなシネマティックな構図」というように、詳細な文章を入力することで、AIの理解度は劇的に向上します。

マルチリファレンスの活用

ビジネスに耐えうる一貫性のある生成を行うには、マルチリファレンス機能を使いこなす必要があります。一貫性を損なう原因の多くは、AIが意図を汲み取れない曖昧なプロンプトです。画像の内容を文章で補足しながら、生成の核となる要素を固定する記述を意識してください。

関連記事:【生成速度が最大10倍】「Nano Banana 2」徹底解説|“高速性と“高品質"を両立した次世代画像生成AI

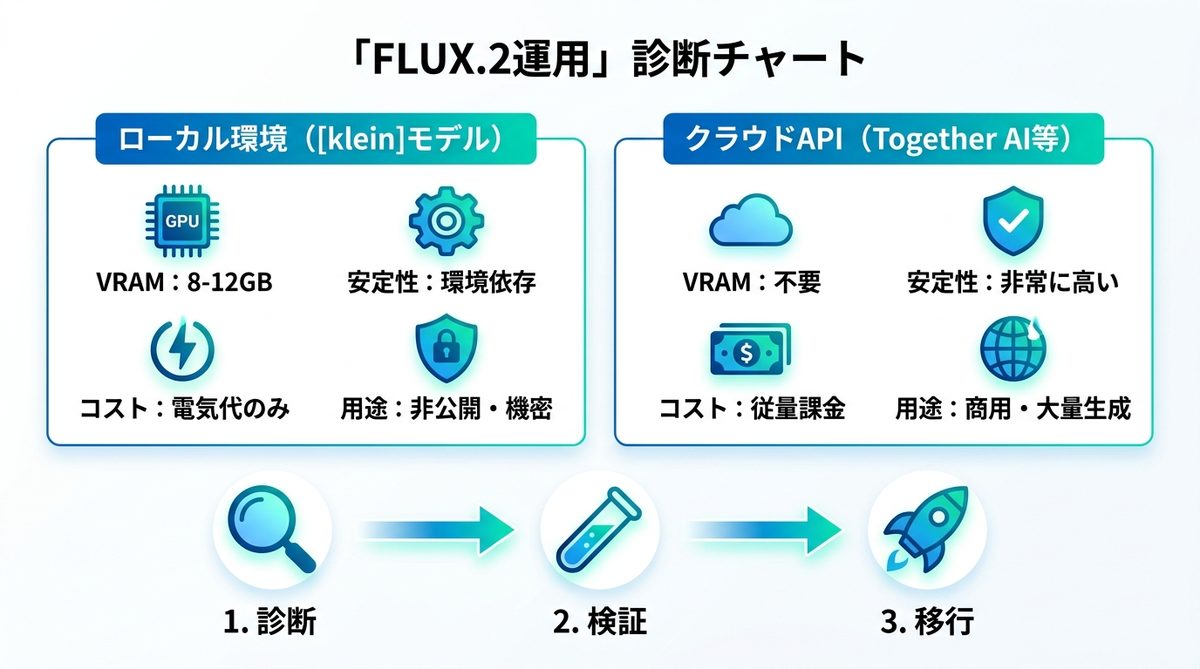

環境別FLUX.2運用診断チャート

自身のPC環境と用途に合わせて、最適な導入先を選びましょう。

| 比較項目 | ローカル環境([klein]モデル) | クラウドAPI(Together AI等) |

|---|---|---|

| VRAM要件 | 8-12GBで動作可能 | 不要(クラウド) |

| 安定性 | 環境依存で不安定 | 非常に高い |

| コスト | 電気代のみ | 生成ごとの従量課金 |

| 適した用途 | 非公開の機密画像生成 | 商用利用・大量生成 |

環境構築のステップ

- 診断: 自宅のGPUスペックがVRAM 12GB以下なら、迷わずAPI環境を検討してください。

- 検証: [klein]モデルを導入し、自然言語によるプロンプトで生成テストを繰り返す。

- 移行: 量産フェーズに入ったら、API環境(Together AI等)へ移行し、環境構築のストレスから解放される。

関連記事:【2026年最新】生成AIとは何か?AIエージェント時代に乗り遅れないためのビジネス活用ガイド

まとめ

FLUX.2のエラーを克服し、安定した業務ワークフローを構築するためのポイントは以下の通りです。

- 物理的制限を理解する: [dev]モデルには90GBのVRAMが必要であり、ローカルでの運用には限界があることを認める。

- モデル選択を最適化する: ローカルなら[klein]モデルやGGUF化を行い、スペックに合わせたモデルを選ぶ。

- プロンプトを刷新する: タグ形式をやめ、Mistral-3が理解しやすい「自然言語」で文章を書く。

- APIという合理性: 環境構築のデバッグに時間を費やすより、API環境を活用して即座に成果物を出す経済合理性を優先する。

ローカルでの試行錯誤を卒業し、まずはクラウド環境でFLUX.2の圧倒的なパワーを体感してください。安定した生成環境が、あなたのクリエイティブを劇的に加速させます。